A IA está na mente de todos. E isso sempre leva a uma pergunta: quão segura é essa nova ferramenta de IA?

Se você está pensando em implementar um chatbot para uma empresa, a segurança do chatbot deve ser uma das suas principais preocupações.

Neste artigo, vou te mostrar todos os principais riscos de segurança em chatbots, além das precauções que sua organização precisa tomar ao implementar um chatbot de IA ou agente de IA.

Chatbots são seguros?

Nem todos os chatbots são seguros – você nunca sabe quais precauções foram tomadas durante o desenvolvimento. Porém, é possível criar e implantar um chatbot seguro com as ferramentas certas.

A segurança em chatbots é um tema amplo, já que existem diversas formas de construir um chatbot ou agentes de IA, além de infinitos casos de uso. Cada diferença traz um aspecto de segurança único que você precisa considerar.

O que posso fazer para evitar riscos com chatbots?

A segurança é uma parte fundamental do seu projeto de chatbot – sua estratégia de proteção não pode ser feita pela metade.

Se você não domina o assunto, conte com um especialista. A maioria das organizações que desenvolvem e implantam chatbots contam com parceiros de IA: empresas com experiência em projetos específicos de IA. Se você está criando um chatbot, confira nossa lista de especialistas certificados, com freelancers e agências experientes em criar, implantar e monitorar chatbots seguros.

Caso contrário, informe-se sobre os riscos relevantes para o seu chatbot e tome todas as medidas necessárias para evitar resultados indesejados.

Para facilitar, reuni os riscos de segurança mais comuns em chatbots e informações sobre como combater cada um deles.

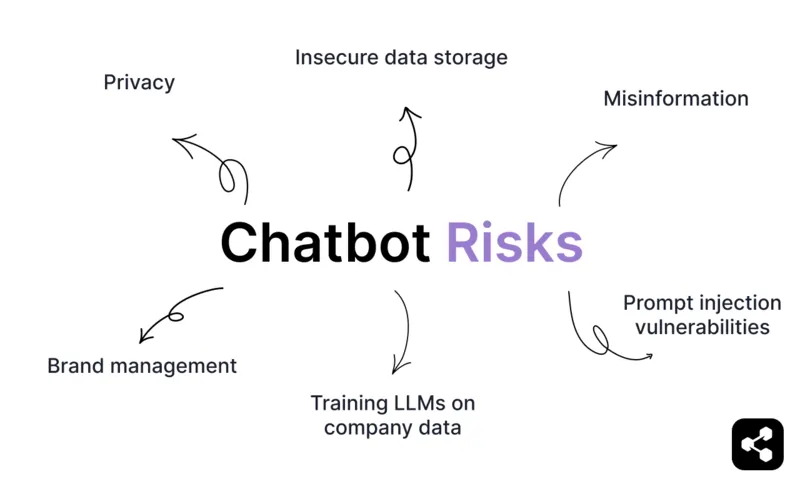

Riscos de Chatbots

Privacidade e Informações Confidenciais

Chatbots geralmente lidam com dados pessoais, como nomes, e-mails ou informações financeiras. Isso significa que eles se tornam um risco à privacidade quando tratam dados sensíveis sem proteções robustas.

Isso é ainda mais importante em chatbots médicos, chatbots que processam pagamentos, chatbots financeiros, chatbots bancários ou qualquer chatbot corporativo que lide com dados sensíveis.

Se esses dados forem armazenados de forma insegura ou transmitidos sem criptografia, ficam vulneráveis a vazamentos – expondo empresas a riscos legais, financeiros e de reputação.

Desinformação e Alucinações

Chatbots baseados em LLMs – se mal construídos – correm o risco de espalhar informações falsas.

Veja o famoso caso do chatbot da Air Canada. Um passageiro foi informado pelo chatbot do site da empresa que poderia solicitar tarifas de luto após o falecimento da avó.

Ao tentar receber o reembolso, o cliente foi informado de que a política não se aplicava a viagens já realizadas. A empresa admitiu que o chatbot usou 'palavras enganosas', e o caso foi parar na justiça.

Esse tipo de alucinação não só causa constrangimento para as marcas – mas também prejuízos.

Mas é possível criar chatbots que mantêm o foco e seguem o tom da marca. Um de nossos clientes, uma plataforma de coaching de saúde, conseguiu reduzir o suporte manual em 65% com um chatbot. Em mais de 100.000 conversas, a empresa não encontrou nenhuma alucinação.

Como? Geração aumentada por recuperação (RAG) é fundamental na maioria dos chatbots corporativos. Em vez de gerar respostas livres, o RAG combina a capacidade generativa do chatbot com um banco de dados de informações verificadas e atualizadas. Isso garante que as respostas sejam baseadas em fatos, não em suposições.

Chatbots corporativos incluem outras barreiras de segurança necessárias antes de serem lançados ao público – falaremos delas a seguir.

Armazenamento de Dados Inseguro

Se o seu chatbot armazena dados em servidores ou na nuvem, protocolos de segurança inadequados podem deixá-lo exposto a vazamentos.

Softwares desatualizados, servidores mal configurados ou dados sem criptografia podem ser explorados por invasores para acessar informações sensíveis dos usuários.

Por exemplo, alguns chatbots armazenam backups de dados sem a devida criptografia, tornando-os vulneráveis à interceptação durante a transferência ou ao acesso não autorizado.

Vulnerabilidades de Injeção de Prompt e Saída Maliciosa

Se você implantar um chatbot fraco, ele pode ser sensível a comandos destrutivos.

Por exemplo, se seu chatbot ajuda a vender veículos da sua concessionária, você não quer que ele venda um caminhão por $ 1. (Veja o famoso caso do Chevy Tahoe.)

Chatbots podem gerar respostas prejudiciais ou sem sentido se suas saídas não forem devidamente controladas. Esses erros podem ocorrer por falta de barreiras, ausência de validações ou manipulação por usuários.

No entanto, esse é um dos riscos de segurança mais fáceis de evitar. Chatbots robustos usam barreiras de conversa para impedir conversas fora do tema ou do padrão da marca antes mesmo que aconteçam.

Treinamento de LLMs com Dados da Empresa

Treinar chatbots com dados da empresa pode trazer riscos de privacidade e segurança, especialmente em plataformas de uso geral como o ChatGPT. Ao usar informações da empresa em chatbots genéricos, sempre existe o risco de vazamento de dados.

Já os chatbots personalizados facilitam muito a proteção dos seus dados. Plataformas de chatbot de nível corporativo geralmente são projetadas com isolamento e segurança de dados. Esses chatbots são treinados em ambientes controlados, reduzindo significativamente o risco de vazamento de informações.

Gestão de Marca

Os maiores escândalos públicos com chatbots envolvem a gestão da marca. O quanto seu chatbot representa bem sua marca? Isso está no centro da segurança dos chatbots.

Chatbots costumam ser o primeiro contato dos clientes com sua empresa, e se as respostas forem imprecisas, inadequadas ou fora do tom, podem prejudicar a reputação da marca.

Mais uma vez, esse risco pode ser evitado com barreiras de conversa e um bom design de conversação.

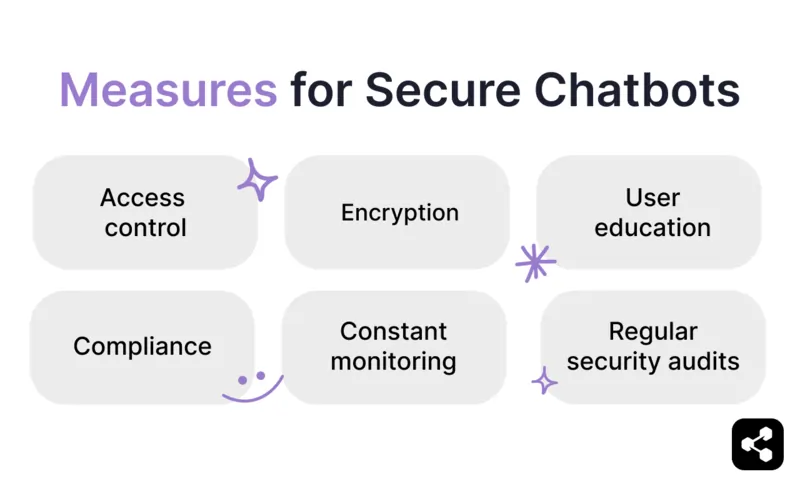

Medidas de Segurança Necessárias para Chatbots Seguros

Controle de Acesso e Acesso Seguro de Usuários

Se for uma ferramenta de uso amplo, nem sempre você quer que todos tenham o mesmo nível de acesso.

Após a autenticação, a autorização determina o que cada usuário está autorizado a fazer, com base em seu papel ou permissões.

Uma parte fundamental disso é o controle de acesso baseado em papéis (RBAC), que garante que os usuários acessem apenas as informações e funções necessárias para exercerem suas funções. Isso significa:

- Limitar o acesso a dados sensíveis somente a pessoas autorizadas.

- Restringir a capacidade de edição do chatbot apenas aos administradores.

- Definir funções de usuário com permissões claras e exequíveis.

Ao implementar RBAC junto com protocolos seguros de autenticação e autorização, você minimiza riscos como acessos não autorizados, vazamento de dados e uso indevido acidental. É uma barreira simples, mas essencial para a implantação segura de chatbots.

Auditorias de Segurança Regulares

Assim como qualquer software de alto desempenho, o software de chatbot deve passar por auditorias de segurança regulares.

Auditorias de segurança regulares são revisões completas da arquitetura, configurações e processos do seu chatbot para garantir que atendam aos padrões de segurança e melhores práticas do setor.

Essas auditorias geralmente envolvem testes de vulnerabilidades – como protocolos de autenticação fracos, servidores mal configurados ou APIs expostas – além de avaliar a eficácia das medidas de segurança existentes, como criptografia e controles de acesso.

As auditorias também verificam a conformidade com regulamentos de proteção de dados, garantindo que seu chatbot siga normas como GDPR ou SOC 2.

Esse processo geralmente inclui:

- Testes de invasão para simular possíveis ataques

- Revisão de código para identificar falhas ocultas

- Monitoramento de atividades suspeitas

Auditorias de segurança são uma medida proativa para avaliar a resistência do seu chatbot contra ameaças e garantir que ele possa lidar com informações sensíveis de forma segura.

Criptografia

Criptografia é o processo de converter dados em um formato seguro para evitar acessos não autorizados. Para dados sensíveis, isso inclui dois tipos principais: criptografia de dados em repouso, que protege informações armazenadas, e criptografia de dados em trânsito, que protege os dados enquanto estão sendo transmitidos.

O uso de protocolos de criptografia robustos, como o AES (Padrão de Criptografia Avançado), garante que mesmo que os dados sejam interceptados, permaneçam ilegíveis.

Para chatbots que lidam com informações sensíveis, a criptografia é uma proteção indispensável para garantir a privacidade dos usuários e manter a conformidade com padrões de segurança.

Monitoramento Contínuo

Nossa plataforma como serviço sugere 3 etapas para a implementação de chatbots: construção, implantação e monitoramento.

Os clientes costumam esquecer a etapa final ao planejar seus projetos iniciais, mas o monitoramento é o passo mais importante de todos.

Isso inclui:

- Acompanhamento de métricas de desempenho

- Identificação de vulnerabilidades

- Correção de problemas como alucinações ou vazamento de dados

Atualizações e testes regulares ajudam a garantir que seu chatbot se adapte a novas ameaças e permaneça em conformidade com as normas do setor.

Sem o monitoramento adequado, até mesmo o chatbot mais bem construído pode se tornar um risco com o tempo.

Conformidade

Se o seu chatbot vai lidar com dados sensíveis, é necessário escolher uma plataforma que esteja em conformidade com os principais frameworks regulatórios.

Os frameworks de conformidade mais comuns e relevantes incluem:

- GDPR: Regulamento Geral de Proteção de Dados

- CCPA: Lei de Privacidade do Consumidor da Califórnia

- HIPAA: Lei de Portabilidade e Responsabilidade de Seguros de Saúde

- SOC 2: Controles de Sistema e Organização 2

Se você vai processar dados de pessoas da União Europeia, precisará de um chatbot compatível com o GDPR.

Para estar totalmente em conformidade, será necessário tanto a) uma plataforma que siga as medidas corretas de conformidade quanto b) algum trabalho dos desenvolvedores do chatbot (como o tratamento dos dados após serem recebidos pelo chatbot).

Educação do Usuário

Às vezes, o problema não está na tecnologia – mas sim na falta de entendimento dos usuários.

Uma parte importante da implementação de tecnologia de chatbot é preparar adequadamente seus colaboradores para novos riscos e desafios (além dos inúmeros benefícios).

Instrua seus colaboradores sobre como incorporar o chatbot no trabalho sem colocar em risco a reputação da empresa. O ideal é que seu chatbot seja desenvolvido com proteções suficientes para que seja praticamente impossível usá-lo de forma inadequada.

Implemente o Chatbot Mais Seguro do Mercado

A segurança deve ser prioridade máxima no investimento em chatbots da sua empresa.

A Botpress é uma plataforma de agentes de IA e chatbots utilizada por 35% das empresas da Fortune 500. Nossa suíte de segurança de última geração permite controle máximo sobre suas ferramentas de IA.

Nosso gateway privado de LLM, escudo de privacidade, agente de segurança integrado e estrutura de proteção de marca garantem que nossos clientes tenham a experiência de chatbot mais segura do mercado.

Comece a construir hoje mesmo. É grátis.

Ou agende uma conversa com nossa equipe para começar.

Perguntas frequentes

1. Como os chatbots armazenam dados?

Os chatbots armazenam dados em bancos de dados seguros – normalmente na nuvem – usando criptografia tanto em repouso quanto em trânsito. Os dados armazenados podem incluir registros de conversas e metadados, e geralmente são estruturados para permitir personalização ou atender exigências regulatórias.

2. Como posso garantir um chatbot seguro?

Para garantir a segurança do chatbot, implemente HTTPS em todas as comunicações, criptografe os dados armazenados, autentique chamadas de API e restrinja o acesso usando permissões baseadas em funções. Também é importante auditar o sistema regularmente e cumprir leis de privacidade de dados como GDPR ou HIPAA.

3. O que é segurança em chatbots?

A segurança em chatbots é o conjunto de práticas que protegem usuários e sistemas contra riscos como vazamento de dados, desinformação, ataques de engenharia social ou interações abusivas. Isso inclui aplicar filtros de conteúdo, proteger canais de dados, validar entradas e permitir intervenção humana quando necessário.

4. Qual é o chatbot mais seguro?

O chatbot mais seguro é aquele implantado com criptografia de ponta a ponta, controles de acesso rigorosos, opções de hospedagem local ou em nuvem privada e conformidade com certificações como SOC 2, ISO 27001 ou HIPAA.