L'IA est dans tous les esprits. Et cela conduit toujours à une question complémentaire : quel est le niveau de sécurité de ce nouvel outil d'IA ?

Si vous souhaitez mettre en place un chatbot pour une entreprise, la sécurité du chatbot doit être une priorité.

Dans cet article, je vais vous présenter les principaux risques liés à la sécurité des chatbots, ainsi que les précautions que votre organisation doit prendre lors de la mise en œuvre d'un chatbot ou d'un agent d'intelligence artificielle.

Les chatbots sont-ils sûrs ?

Tous les chatbots ne sont pas sécurisés - on ne sait jamais quelles précautions de sécurité ont été prises lors de leur développement. Cependant, il est possible de construire et de déployer un chatbot sécurisé avec les bons outils.

La sécurité des chatbots est un sujet très vaste, car il existe une myriade de façons de construire un chatbot ou un agent d'intelligence artificielle, ainsi qu'une infinité de cas d'utilisation. Chacune de ces différences apportera un aspect de sécurité unique que vous devrez prendre en compte.

Que puis-je faire pour éviter les risques liés aux chatbots ?

La sécurité est un élément important de votre projet de chatbot - votre stratégie de sécurité ne peut pas être bâclée.

Si vous n'êtes pas à la hauteur, faites appel à un expert. La plupart des organisations qui construisent et déploient un chatbot sont guidées par des partenaires en IA : des organisations qui possèdent une expertise dans un type spécifique de projet d'IA. Si vous créez un chatbot, vous pouvez consulter notre liste d'experts certifiés, une liste d'indépendants et d'agences qui connaissent bien la création, le déploiement et la surveillance de chatbots sécurisés.

Sinon, informez-vous sur les risques liés à votre chatbot et prenez toutes les mesures nécessaires pour éviter les résultats indésirables.

Je vous ai facilité la tâche en compilant les risques de sécurité les plus courants des chatbots et en fournissant des informations sur la manière de combattre chaque risque.

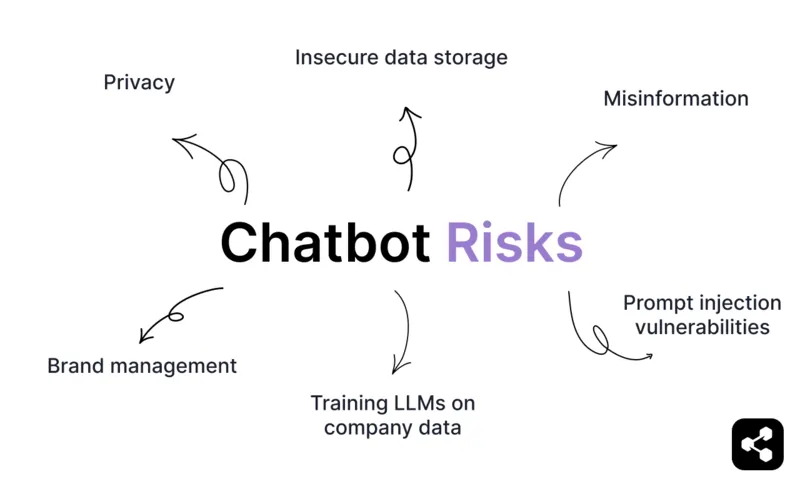

Risques liés aux chatbots

Vie privée et informations confidentielles

Les chatbots manipulent souvent des données personnelles, telles que des noms, des adresses électroniques ou des informations financières. Cela signifie qu'ils présentent un risque pour la vie privée lorsqu'ils traitent des données sensibles des utilisateurs sans garanties solides.

Cela est particulièrement important pour les chatbots médicaux, les chatbots qui traitent les paiements de toute nature, les chatbots financiers, les chatbots bancaires ou les chatbots d'entreprise qui traitent des données sensibles.

Si ces données sont stockées de manière non sécurisée ou transmises sans cryptage, elles deviennent vulnérables aux violations, exposant ainsi les entreprises à des risques juridiques, financiers et de réputation importants.

Désinformation et hallucinations

Les chatbots alimentés par des LLMs - s'ils sont mal construits - risquent de diffuser des informations erronées.

Prenons l'exemple du fameux fiasco du chatbot d'Air Canada. Un passager a été informé par le chatbot du site web de la compagnie qu'il pouvait demander des tarifs de deuil pour un vol après le décès de sa grand-mère.

Après avoir demandé le remboursement, le client s'est vu répondre que la politique ne s'appliquait pas aux voyages effectués. L'entreprise a admis que le chatbot avait utilisé des "mots trompeurs" et l'affaire a été portée devant les tribunaux.

Ce type d'hallucinations ne fait pas qu'embarrasser les marques, il leur coûte cher.

Mais il est possible de créer des chatbots qui restent en phase avec le sujet et la marque. L'un de nos clients, une plateforme de coaching santé, a pu réduire de 65 % le nombre de tickets de support manuel grâce à un chatbot. Sur ses 100 000 conversations, l'entreprise n'a constaté aucune hallucination.

Comment ? La génération augmentée par récupération (RAG) joue un rôle important dans la plupart des chatbots d'entreprise. Au lieu de générer des réponses libres, la RAG combine les capacités de génération du chatbot avec une base de données d'informations vérifiées et actualisées. Cela permet de s'assurer que les réponses sont fondées sur la réalité, et non sur des hypothèses ou des suppositions.

Les chatbots d'entreprise comportent d'autres garde-fous de sécurité qui sont nécessaires avant un déploiement public - nous y reviendrons plus loin.

Stockage de données non sécurisé

Si votre chatbot stocke des données sur des serveurs ou dans un environnement en nuage, des protocoles de sécurité inadéquats peuvent l'exposer à des violations.

Des logiciels obsolètes, des serveurs mal configurés ou des données non cryptées peuvent être exploités par des pirates pour accéder aux informations sensibles des utilisateurs.

Par exemple, certains chatbots stockent des sauvegardes de données sans cryptage approprié, ce qui les rend vulnérables à l'interception pendant le transfert ou à l'accès non autorisé.

Vulnérabilités d'injection d'invite et sortie malveillante

Si vous déployez un chatbot faible, il peut être sensible aux messages destructeurs.

Par exemple, si votre chatbot aide à vendre les véhicules de votre concession, vous ne voulez pas qu'il vende un camion à 1 $ (voir le tristement célèbre incident du Chevrolet Tahoe).

Les chatbots peuvent produire des réponses nuisibles ou absurdes si leurs résultats ne sont pas correctement contrôlés. Ces erreurs peuvent résulter de garde-fous inadéquats, de l'absence de contrôles de validation ou de manipulations par les utilisateurs.

Il s'agit toutefois de l'un des risques de sécurité les plus faciles à éviter. Les chatbots solides utiliseront des garde-fous pour empêcher les conversations hors sujet ou hors marque avant qu'elles n'aient lieu.

Formation aux données d'entreprise pour les LLMs

L'utilisation des données de l'entreprise par les chatbots peut présenter des risques pour la vie privée et la sécurité, en particulier avec des plateformes généralistes telles que ChatGPT. L'utilisation d'informations d'entreprise par des chatbots à usage général présente toujours un risque de fuite de données.

Les chatbots personnalisés, en revanche, facilitent grandement la protection de vos données. Les plateformes de chatbot d'entreprise sont généralement conçues en tenant compte de l'isolation et de la sécurité des données. Ces chatbots sont formés dans des environnements contrôlés, ce qui réduit considérablement le risque de fuite de données.

Gestion de la marque

Les plus grands fiascos publics de chatbots se sont concentrés sur la gestion de la marque. Dans quelle mesure votre chatbot représente-t-il votre marque ? Cette question est au cœur de la sécurité des chatbots.

Les chatbots sont souvent le premier point de contact des clients avec votre entreprise, et si leurs réponses sont inexactes, inappropriées ou décalées, elles peuvent nuire à la réputation de votre marque.

Là encore, il s'agit d'un risque qui peut être évité grâce à des garde-corps et à une conception de la conversation.

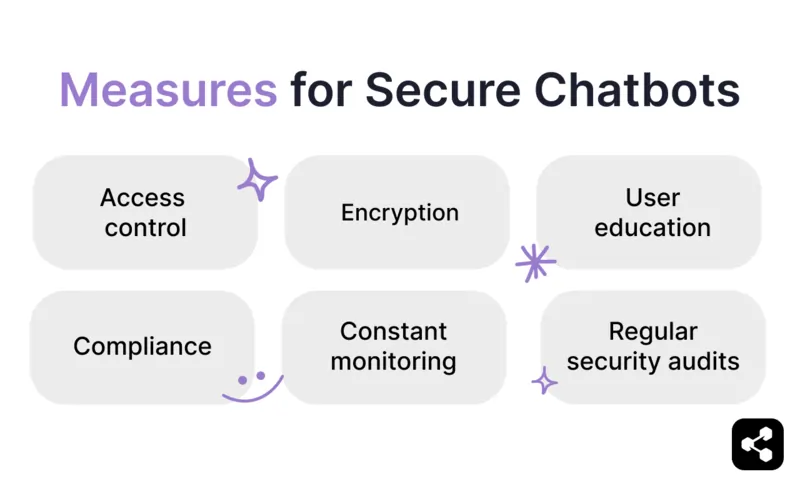

Mesures de sécurité nécessaires pour des chatbots sécurisés

Contrôle d'accès et accès sécurisé des utilisateurs

S'il s'agit d'un outil utilisé par le plus grand nombre, il n'est pas toujours souhaitable que tout le monde ait le même niveau d'accès.

L'authentification vérifie l'identité de l'utilisateur et garantit que seuls les utilisateurs légitimes peuvent se connecter. Une fois l'utilisateur authentifié, l'autorisation détermine ce qu'il est autorisé à faire, en fonction de son rôle ou de ses permissions.

Un élément clé est le contrôle d'accès basé sur les rôles (RBAC), qui garantit que les utilisateurs n'accèdent qu'aux informations et aux fonctions dont ils ont besoin pour remplir leur rôle. Cela signifie que :

- Limiter l'accès aux données sensibles au personnel autorisé.

- Limiter les capacités d'édition des chatbots aux administrateurs.

- Définir les rôles des utilisateurs avec des autorisations claires et applicables.

En mettant en œuvre le RBAC avec des protocoles d'authentification et d'autorisation sécurisés, vous pouvez minimiser les risques tels que l'accès non autorisé, les fuites de données et l'utilisation abusive accidentelle. Il s'agit d'un garde-fou simple mais essentiel pour un déploiement sécurisé des chatbots.

Audits de sécurité réguliers

Comme tout autre logiciel performant, les logiciels de chatbot doivent faire l'objet d'audits de sécurité réguliers.

Les audits de sécurité réguliers sont des examens complets de l'architecture, des configurations et des processus de votre chatbot afin de s'assurer qu'ils respectent les normes de sécurité et les meilleures pratiques du secteur.

Ces audits consistent généralement à tester les vulnérabilités ( protocoles d'authentification faibles, serveurs mal configurés ou API exposées ) et à évaluer l'efficacité des mesures de sécurité existantes, telles que le cryptage et les contrôles d'accès.

Les audits permettent également d'évaluer la conformité avec les réglementations en matière de protection des données, en s'assurant que votre chatbot respecte des cadres tels que GDPR ou SOC 2.

Ce processus comprend souvent

- Tests de pénétration pour simuler des attaques potentielles

- Les revues de code pour repérer les failles cachées

- Surveillance des activités inhabituelles

Les audits de sécurité sont une mesure proactive qui permet d'évaluer la résistance de votre chatbot aux menaces et de vérifier sa capacité à traiter des informations sensibles en toute sécurité.

Cryptage

Le cryptage est le processus de conversion des données dans un format sécurisé afin d'empêcher tout accès non autorisé. Pour les données sensibles, il existe deux types principaux : le cryptage des données au repos, qui protège les informations stockées, et le cryptage des données en transit, qui sécurise les données pendant leur transmission.

L'utilisation de protocoles de cryptage puissants tels que l'AES (Advanced Encryption Standard) garantit que même si les données sont interceptées, elles restent illisibles.

Pour les chatbots qui traitent des informations sensibles, le chiffrement est un garde-fou non négociable pour protéger la vie privée des utilisateurs et maintenir la conformité avec les normes de sécurité.

Surveillance constante

Notre plateforme en tant que service propose 3 étapes de mise en œuvre d'un chatbot : construction, déploiement et suivi.

Les clients ont tendance à oublier la dernière étape lorsqu'ils élaborent leurs plans initiaux, mais le suivi est l'étape la plus importante de toutes.

Il s'agit notamment de

- Suivi des indicateurs de performance

- Identifier les vulnérabilités

- Aborder des questions telles que les hallucinations ou les fuites de données

Des mises à jour et des tests réguliers permettent de s'assurer que votre chatbot s'adapte à l'évolution des menaces et reste conforme aux réglementations sectorielles.

Sans un suivi approprié, même le chatbot le mieux construit peut devenir un handicap au fil du temps.

Conformité

Si votre chatbot est amené à traiter des données sensibles, vous devez opter pour une plateforme qui respecte les principaux cadres de conformité.

Les cadres de conformité les plus courants et les plus pertinents sont les suivants :

- GDPR : Règlement général sur la protection des données

- CCPA : Loi californienne sur la protection de la vie privée des consommateurs

- HIPAA : Loi sur la portabilité et la responsabilité en matière d'assurance maladie

- SOC 2 : Contrôles des systèmes et de l'organisation 2

Si vous êtes amené à traiter des données provenant de personnes résidant dans l'UE, vous devez disposer d'un chatbot conforme au GDPR.

Pour être pleinement conforme, il faudra à la fois a) une plateforme qui respecte les mesures de conformité appropriées et b) un certain travail de la part des concepteurs de votre chatbot (comme la manière dont vous traitez les données une fois qu'elles ont été reçues par votre chatbot).

Formation des utilisateurs

Parfois, ce n'est pas la technologie qui est en cause, mais un manque de compréhension de la part des utilisateurs.

Une partie importante de l'instauration de la technologie des chatbots consiste à préparer correctement vos employés aux nouveaux risques et défis (ainsi qu'à la myriade d'avantages).

Expliquez à vos employés comment intégrer le chatbot dans leur travail sans risquer de nuire à la réputation de votre entreprise. Idéalement, votre chatbot sera conçu avec suffisamment de garde-fous pour qu'il soit pratiquement impossible de l'utiliser à mauvais escient.

Déployer le Chatbot le plus sûr du marché

La sécurité doit être au cœur de l'investissement de votre entreprise dans les chatbots.

Botpress est un agent d'IA et une plateforme de chatbot utilisée par 35% des entreprises du Fortune 500. Notre suite de sécurité à la pointe de la technologie permet un contrôle maximal sur vos outils d'IA.

Notre passerelle LLM privée, notre bouclier de protection de la vie privée, notre agent de sécurité intégré et notre cadre de protection de la marque garantissent à nos clients l'expérience de chatbot la plus sûre du marché.

Commencez à construire dès aujourd'hui. C'est gratuit.

Ou prenez rendez-vous avec notre équipe pour commencer.

FAQ

1. Comment les chatbots stockent-ils les données ?

Les chatbots stockent les données dans des bases de données sécurisées - généralement basées sur le cloud - en utilisant le cryptage à la fois au repos et en transit. Les données stockées peuvent inclure des journaux de conversation et des métadonnées, et sont souvent structurées de manière à prendre en charge la personnalisation ou la conformité réglementaire.

2. Comment assurer la sécurité du chatbot ?

Pour un chatbot sécurisé, mettez en œuvre le protocole HTTPS pour toutes les communications, cryptez les données stockées, authentifiez les appels d'API et limitez l'accès à l'aide d'autorisations basées sur les rôles. Vous devez également auditer régulièrement le système et vous conformer aux lois sur la confidentialité des données telles que GDPR ou HIPAA.

3. Qu'est-ce que la sécurité des chatbots ?

La sécurité des chatbots est l'ensemble des pratiques qui protègent les utilisateurs et les systèmes contre les risques tels que les violations de données, la désinformation, les attaques d'ingénierie sociale ou les interactions abusives. Il s'agit notamment d'appliquer des filtres de contenu, de sécuriser les canaux de données, de valider les entrées et de permettre un repli humain en cas de besoin.

4. Quel est le chatbot le plus sûr ?

Le chatbot le plus sûr est celui qui est déployé avec un chiffrement de bout en bout, des contrôles d'accès stricts, des options sur site ou en nuage privé, et une conformité avec des certifications telles que SOC 2, ISO 27001 ou HIPAA.

.webp)