AI is overal onderwerp van gesprek. En dat roept altijd de vervolgvraag op: hoe veilig is deze nieuwe AI-tool eigenlijk?

Als je overweegt een chatbot voor een bedrijf te implementeren, moet chatbotbeveiliging bovenaan je lijstje staan.

In dit artikel neem ik je mee langs alle belangrijke beveiligingsrisico's van chatbots en de voorzorgsmaatregelen die je organisatie moet nemen bij het implementeren van een AI-chatbot of AI-agent.

Zijn chatbots veilig?

Niet alle chatbots zijn veilig – je weet nooit precies welke veiligheidsmaatregelen er zijn genomen tijdens de ontwikkeling. Maar met de juiste tools kun je wel degelijk een veilige chatbot bouwen en inzetten.

Chatbotbeveiliging is een breed onderwerp, omdat er talloze manieren zijn om een chatbot of AI-agent te bouwen, en eindeloze toepassingen. Elk verschil brengt unieke beveiligingsaspecten met zich mee waar je rekening mee moet houden.

Wat kan ik doen om chatbotrisico's te vermijden?

Beveiliging is een essentieel onderdeel van je chatbotproject – je veiligheidsstrategie mag geen half werk zijn.

Als je er zelf niet uitkomt, schakel een expert in. De meeste organisaties die een chatbot bouwen en inzetten, laten zich begeleiden door AI-partners: organisaties met ervaring in een specifiek type AI-project. Ben je bezig met een chatbot, bekijk dan onze lijst van gecertificeerde experts, met freelancers en bureaus die veel ervaring hebben met het bouwen, implementeren en monitoren van veilige chatbots.

Of verdiep je in de relevante risico's voor jouw chatbot en neem alle noodzakelijke maatregelen om ongewenste gevolgen te voorkomen.

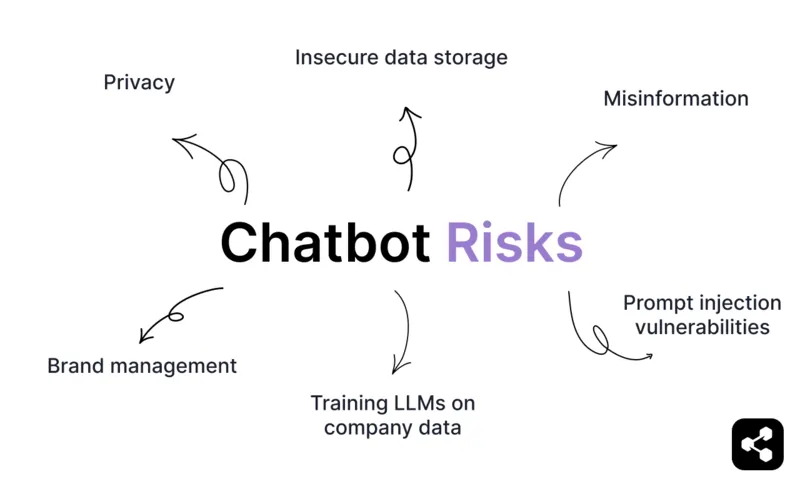

Ik heb het je wat makkelijker gemaakt door de meest voorkomende beveiligingsrisico's van chatbots op een rij te zetten en informatie te geven over hoe je elk risico kunt aanpakken.

Chatbotrisico's

Privacy & Vertrouwelijke Informatie

Chatbots verwerken vaak persoonsgegevens, zoals namen, e-mailadressen of financiële gegevens. Daarmee vormen ze een privacyrisico als ze gevoelige gebruikersdata verwerken zonder goede beveiliging.

Dit is vooral belangrijk bij medische chatbots, chatbots die betalingen verwerken, financiële chatbots, bankchatbots of elke zakelijke chatbot die met gevoelige gegevens werkt.

Als deze gegevens onveilig worden opgeslagen of zonder encryptie worden verzonden, zijn ze kwetsbaar voor datalekken – en lopen bedrijven aanzienlijke juridische, financiële en reputatierisico's.

Misleiding en Hallucinaties

Chatbots die werken met LLM's – als ze niet goed zijn gebouwd – lopen het risico om onjuiste informatie te verspreiden.

Neem het beruchte Air Canada chatbot-incident. Een passagier kreeg van de chatbot op de website te horen dat hij na het overlijden van zijn grootmoeder in aanmerking kon komen voor rouwtarieven voor een vlucht.

Toen hij contact opnam voor de vergoeding, kreeg hij te horen dat het beleid alleen gold voor nog niet afgeronde reizen. Het bedrijf gaf toe dat de chatbot 'misleidende woorden' had gebruikt, en de zaak kwam voor de rechter.

Dit soort hallucinaties zijn niet alleen gênant voor merken – ze kosten ook geld.

Maar het is mogelijk om chatbots te bouwen die bij het onderwerp en de merkidentiteit blijven. Een van onze klanten, een gezondheidscoachingplatform, wist het aantal handmatige supporttickets met 65% te verminderen dankzij een chatbot. Bij meer dan 100.000 gesprekken werden geen hallucinaties gevonden.

Hoe dat kan? Retrieval-augmented generation (RAG) speelt een grote rol bij de meeste zakelijke chatbots. In plaats van vrij te genereren, combineert RAG de generatieve mogelijkheden van de chatbot met een database met geverifieerde, actuele informatie. Zo zijn de antwoorden gebaseerd op feiten, niet op aannames of giswerk.

Zakelijke chatbots bevatten daarnaast andere beveiligingsmaatregelen die nodig zijn voordat ze publiek worden ingezet – daar komen we zo op terug.

Onveilige Dataopslag

Als je chatbot gegevens opslaat op servers of in de cloud, kunnen gebrekkige beveiligingsprotocollen leiden tot datalekken.

Verouderde software, verkeerd ingestelde servers of niet-versleutelde data kunnen door aanvallers worden misbruikt om toegang te krijgen tot gevoelige gebruikersinformatie.

Sommige chatbots slaan bijvoorbeeld back-ups op zonder goede encryptie, waardoor ze kwetsbaar zijn voor onderschepping tijdens overdracht of ongeautoriseerde toegang.

Prompt-injectie & Schadelijke Output

Als je een zwakke chatbot inzet, kan deze gevoelig zijn voor destructieve prompts.

Stel dat je chatbot voertuigen verkoopt voor je autodealer, dan wil je niet dat hij een truck voor $1 verkoopt. (Zie het beruchte Chevy Tahoe-incident.)

Chatbots kunnen schadelijke of onzinnige antwoorden geven als hun output niet goed wordt gecontroleerd. Dit kan komen door gebrekkige beveiligingsmaatregelen, het ontbreken van validatie, of door manipulatie door gebruikers.

Toch is dit een van de makkelijkere risico's om te voorkomen. Sterke chatbots gebruiken gespreksmaatregelen om te voorkomen dat gesprekken ontsporen of niet bij het merk passen.

LLM's trainen op bedrijfsdata

Chatbots trainen op bedrijfsdata brengt privacy- en beveiligingsrisico's met zich mee, vooral bij algemene platforms zoals ChatGPT. Gebruik je bedrijfsinformatie met algemene chatbots, dan loop je altijd het risico op datalekken.

Maatwerkchatbots maken het daarentegen veel eenvoudiger om je data te beschermen. Zakelijke chatbotplatforms zijn doorgaans ontworpen met datasegregatie en beveiliging als uitgangspunt. Deze chatbots worden getraind in gecontroleerde omgevingen, waardoor het risico op datalekken aanzienlijk kleiner is.

Merkbeheer

De grootste publieke chatbot-incidenten draaiden om merkbeheer. Hoe goed vertegenwoordigt jouw chatbot je merk? Dat is de kern van chatbotbeveiliging.

Chatbots zijn vaak het eerste contactpunt voor klanten met je bedrijf, en als hun antwoorden onjuist, ongepast of niet in de juiste toon zijn, kan dat je reputatie schaden.

Ook dit risico kun je voorkomen met gespreksmaatregelen en gespreksontwerp.

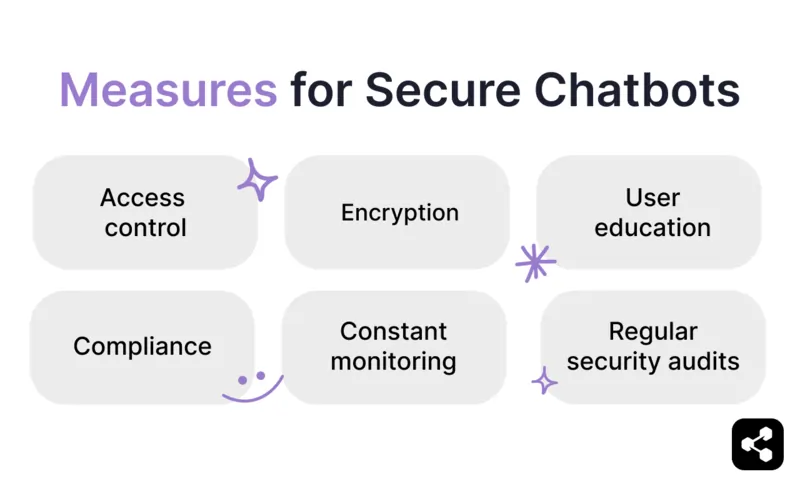

Noodzakelijke Veiligheidsmaatregelen voor Veilige Chatbots

Toegangsbeheer & Veilige Gebruikerstoegang

Als het een tool is voor veel gebruikers, wil je niet dat iedereen overal bij kan.

Authenticatie verifieert wie de gebruiker is — zodat alleen legitieme gebruikers kunnen inloggen. Na authenticatie bepaalt autorisatie wat elke gebruiker mag doen, afhankelijk van zijn of haar rol of rechten.

Een belangrijk onderdeel hiervan is rolgebaseerde toegangscontrole (RBAC), waarmee gebruikers alleen toegang krijgen tot de informatie en functies die ze nodig hebben voor hun rol. Dit betekent:

- Toegang tot gevoelige data beperken tot geautoriseerd personeel.

- Alleen beheerders mogen de chatbot aanpassen.

- Gebruikersrollen vastleggen met duidelijke, afdwingbare rechten.

Door RBAC te combineren met veilige authenticatie- en autorisatieprotocollen, minimaliseer je risico's zoals ongeautoriseerde toegang, datalekken en onbedoeld misbruik. Het is een eenvoudige maar essentiële maatregel voor veilige chatbotimplementatie.

Regelmatige Beveiligingsaudits

Net als andere hoogwaardige software moet chatbotsoftware regelmatig worden gecontroleerd op beveiliging.

Regelmatige beveiligingsaudits zijn grondige beoordelingen van de architectuur, configuraties en processen van je chatbot om te controleren of ze voldoen aan de beveiligingsnormen en best practices uit de sector.

Deze audits omvatten meestal het testen op kwetsbaarheden – zoals zwakke authenticatieprotocollen, verkeerd ingestelde servers of openstaande API's – en het beoordelen van de effectiviteit van bestaande beveiligingsmaatregelen zoals encryptie en toegangsbeheer.

Audits beoordelen ook of je chatbot voldoet aan regelgeving voor gegevensbescherming, zoals GDPR of SOC 2.

Dit proces bestaat vaak uit:

- Penetratietests om mogelijke aanvallen te simuleren

- Code reviews om verborgen fouten op te sporen

- Monitoring op ongebruikelijke activiteiten

Beveiligingsaudits zijn een proactieve manier om te beoordelen hoe goed je chatbot bestand is tegen bedreigingen en of gevoelige informatie veilig wordt verwerkt.

Encryptie

Encryptie is het proces waarbij gegevens worden omgezet in een beveiligd formaat om ongeautoriseerde toegang te voorkomen. Voor gevoelige gegevens zijn er twee hoofdtypen: encryptie van data in rust, die opgeslagen informatie beschermt, en encryptie van data tijdens verzending, die gegevens beveiligt terwijl ze worden verstuurd.

Het gebruik van sterke encryptieprotocollen zoals AES (Advanced Encryption Standard) zorgt ervoor dat zelfs als gegevens worden onderschept, ze onleesbaar blijven.

Voor chatbots die met gevoelige informatie werken, is encryptie een onmisbare maatregel om de privacy van gebruikers te waarborgen en te voldoen aan beveiligingsnormen.

Continue monitoring

Ons Platform-as-a-Service raadt 3 fasen aan voor de implementatie van chatbots: bouwen, uitrollen en monitoren.

Klanten vergeten vaak de laatste fase bij het opstellen van hun initiële plannen, maar monitoring is de belangrijkste stap van allemaal.

Dit omvat:

- Het bijhouden van prestatiecijfers

- Het identificeren van kwetsbaarheden

- Het aanpakken van problemen zoals hallucinaties of datalekken

Regelmatige updates en tests zorgen ervoor dat je chatbot zich aanpast aan nieuwe dreigingen en blijft voldoen aan de geldende regelgeving.

Zonder goede monitoring kan zelfs de best gebouwde chatbot na verloop van tijd een risico vormen.

Compliance

Als je chatbot met gevoelige gegevens werkt, moet je kiezen voor een platform dat voldoet aan belangrijke compliance-raamwerken.

De meest gangbare en relevante compliance-raamwerken zijn:

- GDPR: Algemene Verordening Gegevensbescherming

- CCPA: California Consumer Privacy Act

- HIPAA: Health Insurance Portability and Accountability Act

- SOC 2: System and Organization Controls 2

Als je gegevens verwerkt van personen in de EU, heb je een GDPR-conforme chatbot nodig.

Om volledig te voldoen, heb je zowel a) een platform nodig dat de juiste compliance-maatregelen volgt als b) inzet van je chatbotbouwers (zoals hoe je omgaat met gegevens nadat deze door je chatbot zijn ontvangen).

Gebruikersvoorlichting

Soms ligt het probleem niet bij de technologie, maar bij een gebrek aan kennis bij de gebruikers.

Een belangrijk onderdeel van het invoeren van chatbottechnologie is je medewerkers goed voorbereiden op nieuwe risico's en uitdagingen (naast de vele voordelen).

Leer je medewerkers hoe ze de chatbot kunnen inzetten in hun werk zonder het imago van je bedrijf in gevaar te brengen. Idealiter is je chatbot zo gebouwd dat misbruik vrijwel onmogelijk is.

Implementeer de veiligste chatbot op de markt

Beveiliging moet een topprioriteit zijn bij de investering in een chatbot voor je bedrijf.

Botpress is een AI-agent en chatbotplatform dat wordt gebruikt door 35% van de Fortune 500-bedrijven. Onze geavanceerde beveiligingssuite biedt maximale controle over je AI-tools.

Onze private LLM-gateway, privacy shield, ingebouwde veiligheidsagent en merkbeschermingsframework zorgen ervoor dat onze klanten de veiligste chatbotervaring op de markt hebben.

Begin vandaag nog met bouwen. Het is gratis.

Of plan een gesprek met ons team om aan de slag te gaan.

Veelgestelde vragen

1. Hoe slaan chatbots gegevens op?

Chatbots slaan gegevens op in beveiligde databases – meestal in de cloud – waarbij encryptie wordt gebruikt voor zowel data in rust als tijdens verzending. De opgeslagen gegevens kunnen gesprekslogs en metadata bevatten en zijn vaak gestructureerd om personalisatie of naleving van regelgeving te ondersteunen.

2. Hoe zorg ik voor een veilige chatbot?

Voor een veilige chatbot implementeer je HTTPS voor alle communicatie, versleutel je opgeslagen gegevens, verifieer je API-aanroepen en beperk je toegang met rolgebaseerde rechten. Je moet het systeem ook regelmatig auditen en voldoen aan privacywetgeving zoals GDPR of HIPAA.

3. Wat is chatbotveiligheid?

Chatbotveiligheid omvat alle maatregelen die gebruikers en systemen beschermen tegen risico's zoals datalekken, desinformatie, social engineering-aanvallen of misbruik. Dit houdt onder meer in: het afdwingen van contentfilters, het beveiligen van gegevenskanalen, het valideren van invoer en het inschakelen van menselijke tussenkomst waar nodig.

4. Wat is de veiligste chatbot?

De veiligste chatbot is er een die wordt ingezet met end-to-end encryptie, strikte toegangscontroles, on-premise of private cloud-opties en voldoet aan certificeringen zoals SOC 2, ISO 27001 of HIPAA.