L’IA è sulla bocca di tutti. E porta sempre a una domanda successiva: quanto è sicuro questo nuovo strumento di IA?

Se vuoi implementare un chatbot per un’azienda, la sicurezza del chatbot deve essere una priorità.

In questo articolo ti guiderò attraverso tutti i principali rischi per la sicurezza dei chatbot, oltre alle precauzioni che la tua organizzazione deve adottare quando implementa un chatbot IA o un agente IA.

I chatbot sono sicuri?

Non tutti i chatbot sono sicuri: non puoi mai sapere quali precauzioni sono state adottate durante lo sviluppo. Tuttavia, è possibile creare e distribuire un chatbot sicuro con gli strumenti giusti.

La sicurezza dei chatbot è un tema molto ampio, poiché esistono moltissimi modi per costruire un chatbot o agenti IA, oltre a infiniti casi d’uso. Ognuna di queste differenze comporta aspetti di sicurezza specifici da considerare.

Cosa posso fare per evitare i rischi dei chatbot?

La sicurezza è una parte fondamentale del tuo progetto chatbot – la tua strategia di protezione non può essere approssimativa.

Se ti senti fuori dalla tua portata, coinvolgi un esperto. La maggior parte delle organizzazioni che sviluppano e implementano un chatbot si affida a partner AI: realtà specializzate in progetti AI specifici. Se stai creando un chatbot, puoi consultare la nostra lista di esperti certificati, un elenco di freelance e agenzie esperte nella creazione, implementazione e monitoraggio di chatbot sicuri.

Altrimenti, informati sui rischi legati al tuo chatbot e adotta tutte le misure necessarie per prevenire risultati indesiderati.

Ho semplificato il compito raccogliendo i rischi di sicurezza più comuni dei chatbot e fornendo informazioni su come affrontarli.

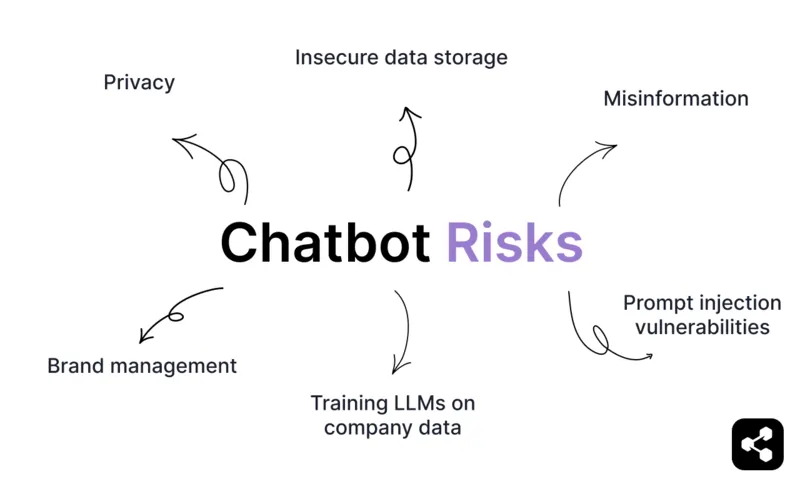

Rischi dei chatbot

Privacy e informazioni riservate

I chatbot spesso gestiscono dati personali, come nomi, email o dettagli finanziari. Questo significa che diventano un rischio per la privacy se trattano dati sensibili degli utenti senza adeguate protezioni.

Questo è particolarmente importante nei chatbot medici, chatbot che gestiscono pagamenti di qualsiasi tipo, chatbot finanziari, chatbot bancari o qualsiasi chatbot aziendale che tratta dati sensibili.

Se questi dati vengono archiviati in modo non sicuro o trasmessi senza crittografia, diventano vulnerabili a violazioni, esponendo così le aziende a rischi legali, finanziari e reputazionali significativi.

Disinformazione e allucinazioni

I chatbot alimentati da LLM – se costruiti male – rischiano di diffondere informazioni errate.

Prendiamo il famigerato caso del chatbot di Air Canada. Un passeggero è stato informato dal chatbot sul sito della compagnia che poteva richiedere tariffe per lutto per un volo dopo la morte della nonna.

Dopo aver richiesto il rimborso, al cliente è stato detto che la polizza si applicava solo ai viaggi non ancora completati. L’azienda ha ammesso che il chatbot aveva usato ‘parole fuorvianti’ e il caso è finito in tribunale.

Questi tipi di allucinazioni non solo mettono in imbarazzo i brand, ma hanno anche un costo.

Ma è possibile creare chatbot che restano sul tema e rispettano il brand. Uno dei nostri clienti, una piattaforma di coaching sulla salute, ha ridotto del 65% le richieste di supporto manuale grazie a un chatbot. Su oltre 100.000 conversazioni, l’azienda non ha riscontrato alcuna allucinazione.

Come? Retrieval-augmented generation (RAG) gioca un ruolo fondamentale nella maggior parte dei chatbot aziendali. Invece di generare risposte libere, RAG combina le capacità generative del chatbot con un database di informazioni verificate e aggiornate. Questo assicura che le risposte siano basate su dati reali, non su supposizioni.

I chatbot aziendali includono altre misure di sicurezza necessarie prima della distribuzione pubblica – ne parleremo più avanti.

Archiviazione dati non sicura

Se il tuo chatbot archivia dati su server o in cloud, protocolli di sicurezza inadeguati possono esporlo a violazioni.

Software obsoleti, server mal configurati o dati non criptati possono essere sfruttati dagli attaccanti per accedere a informazioni sensibili degli utenti.

Ad esempio, alcuni chatbot archiviano backup dei dati senza una corretta crittografia, rendendoli vulnerabili a intercettazioni durante il trasferimento o ad accessi non autorizzati.

Vulnerabilità da Prompt Injection e Output Malevoli

Se implementi un chatbot poco efficace, potrebbe essere vulnerabile a prompt dannosi.

Ad esempio, se il tuo chatbot aiuta a vendere i veicoli della concessionaria, non vuoi che venda un camion a 1 dollaro. (Vedi il famoso caso Chevy Tahoe.)

I chatbot possono generare risposte dannose o prive di senso se le loro uscite non sono adeguatamente controllate. Questi errori possono derivare da barriere insufficienti, mancanza di controlli di validazione o manipolazione da parte degli utenti.

Tuttavia, questo è uno dei rischi di sicurezza più facili da evitare. I chatbot robusti utilizzano paletti conversazionali per prevenire conversazioni fuori tema o non in linea con il brand prima che avvengano.

Addestramento degli LLM sui dati aziendali

Addestrare chatbot sui dati aziendali può comportare rischi per la privacy e la sicurezza, soprattutto con piattaforme generiche come ChatGPT. Quando si usano informazioni aziendali con chatbot generici, c’è sempre il rischio di perdita di dati.

I chatbot personalizzati, invece, rendono molto più semplice proteggere i tuoi dati. Le piattaforme chatbot di livello enterprise sono di solito progettate con isolamento e sicurezza dei dati in mente. Questi chatbot vengono addestrati in ambienti controllati, riducendo notevolmente il rischio di fuga di dati.

Gestione del brand

I più grandi fiaschi pubblici dei chatbot hanno riguardato la gestione del brand. Quanto bene il tuo chatbot rappresenta il tuo marchio? Questo è il cuore della sicurezza dei chatbot.

I chatbot sono spesso il primo punto di contatto dei clienti con la tua azienda e, se le loro risposte sono inaccurate, inadeguate o fuori tono, possono danneggiare la reputazione del tuo brand.

Anche in questo caso, è un rischio che si può evitare con regole di conversazione e una buona progettazione dei dialoghi.

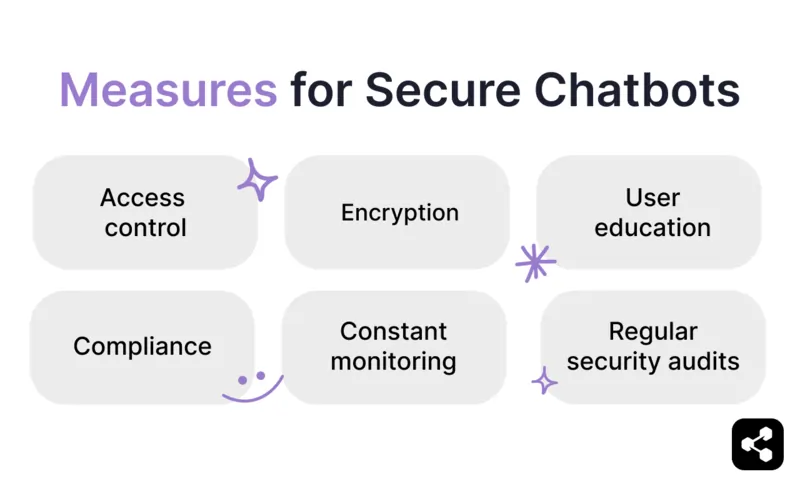

Misure di sicurezza necessarie per chatbot sicuri

Controllo degli accessi e accesso sicuro degli utenti

Se è uno strumento usato da molti, non vuoi necessariamente che tutti abbiano lo stesso livello di accesso.

Autenticazione verifica l’identità dell’utente — assicurando che solo utenti legittimi possano accedere. Una volta autenticato, l’autorizzazione determina cosa può fare ogni utente, in base al suo ruolo o ai permessi.

Un aspetto chiave è il controllo degli accessi basato sui ruoli (RBAC), che garantisce che gli utenti accedano solo alle informazioni e alle funzioni necessarie per il loro ruolo. Questo significa:

- Limitare l’accesso ai dati sensibili solo al personale autorizzato.

- Limitare la modifica dei chatbot agli amministratori.

- Definizione dei ruoli utente con permessi chiari e applicabili.

Implementando il RBAC insieme a protocolli sicuri di autenticazione e autorizzazione, puoi ridurre al minimo rischi come accessi non autorizzati, fughe di dati e usi impropri accidentali. È una misura semplice ma fondamentale per il deployment sicuro dei chatbot.

Audit di sicurezza regolari

Come qualsiasi altro software ad alte prestazioni, anche i chatbot devono essere sottoposti a regolari audit di sicurezza.

Le verifiche di sicurezza regolari sono revisioni approfondite dell’architettura, delle configurazioni e dei processi del tuo chatbot per assicurarsi che rispettino gli standard di sicurezza e le migliori pratiche del settore.

Questi audit di solito prevedono test per vulnerabilità – come protocolli di autenticazione deboli, server mal configurati o API esposte – oltre a valutare l’efficacia delle misure di sicurezza esistenti come crittografia e controlli di accesso.

Gli audit valutano anche la conformità alle normative sulla protezione dei dati, assicurando che il tuo chatbot rispetti framework come GDPR o SOC 2.

Questo processo spesso include:

- Test di penetrazione per simulare potenziali attacchi

- Revisioni del codice per individuare difetti nascosti

- Monitoraggio di attività insolite

Gli audit di sicurezza sono una misura preventiva per valutare la resistenza del tuo chatbot alle minacce e verificare la sua capacità di gestire in modo sicuro le informazioni sensibili.

Crittografia

La crittografia è il processo di trasformazione dei dati in un formato sicuro per impedirne l’accesso non autorizzato. Per i dati sensibili, si distinguono due tipi principali: crittografia dei dati a riposo, che protegge le informazioni archiviate, e crittografia dei dati in transito, che protegge i dati durante la trasmissione.

L’uso di protocolli di crittografia robusti come AES (Advanced Encryption Standard) garantisce che, anche se i dati vengono intercettati, restino illeggibili.

Per i chatbot che gestiscono informazioni sensibili, la crittografia è una misura indispensabile per proteggere la privacy degli utenti e garantire la conformità agli standard di sicurezza.

Monitoraggio costante

La nostra piattaforma come servizio suggerisce 3 fasi per l’implementazione di un chatbot: costruzione, distribuzione e monitoraggio.

I clienti tendono a dimenticare la fase finale quando costruiscono i loro piani iniziali, ma il monitoraggio è il passaggio più importante di tutti.

Questo include:

- Monitoraggio delle metriche di performance

- Individuazione delle vulnerabilità

- Gestione di problemi come allucinazioni o fughe di dati

Aggiornamenti e test regolari aiutano a garantire che il tuo chatbot si adatti alle nuove minacce e rimanga conforme alle normative di settore.

Senza un monitoraggio adeguato, anche il chatbot meglio progettato può diventare un rischio nel tempo.

Conformità

Se il tuo chatbot gestirà dati sensibili, devi scegliere una piattaforma conforme ai principali framework di conformità.

I framework di conformità più comuni e rilevanti includono:

- GDPR: Regolamento Generale sulla Protezione dei Dati

- CCPA: California Consumer Privacy Act

- HIPAA: Health insurance Portability and Accountability Act

- SOC 2: System and Organization Controls 2

Se dovrai trattare dati di persone nell’UE, avrai bisogno di un chatbot conforme al GDPR.

Per essere pienamente conformi, servono sia a) una piattaforma che segua le corrette misure di conformità sia b) un lavoro da parte dei costruttori di chatbot (ad esempio, su come vengono gestiti i dati una volta ricevuti dal chatbot).

Formazione utenti

A volte non è colpa della tecnologia, ma della mancanza di comprensione da parte degli utenti.

Una parte importante nell’introduzione della tecnologia chatbot è preparare adeguatamente i dipendenti ai nuovi rischi e sfide (oltre ai numerosi vantaggi).

Forma i tuoi dipendenti su come integrare il chatbot nel loro lavoro senza rischiare la reputazione aziendale. Idealmente, il tuo chatbot sarà costruito con sufficienti barriere di sicurezza da renderne quasi impossibile l'uso improprio.

Distribuisci il chatbot più sicuro sul mercato

La sicurezza dovrebbe essere una priorità nell’investimento della tua azienda in chatbot.

Botpress è una piattaforma per agenti IA e chatbot utilizzata dal 35% delle aziende Fortune 500. La nostra suite di sicurezza all’avanguardia consente il massimo controllo sui tuoi strumenti IA.

Il nostro gateway LLM privato, privacy shield, agente di sicurezza integrato e framework di protezione del marchio garantiscono ai nostri clienti la massima sicurezza nell’esperienza chatbot sul mercato.

Inizia a costruire oggi. È gratis.

Oppure prenota una chiamata con il nostro team per iniziare.

Domande frequenti

1. Come memorizzano i dati i chatbot?

I chatbot archiviano i dati in database sicuri – tipicamente cloud – utilizzando la crittografia sia a riposo che in transito. I dati memorizzati possono includere log delle conversazioni e metadati, spesso strutturati per supportare la personalizzazione o la conformità normativa.

2. Come posso garantire la sicurezza di un chatbot?

Per un chatbot sicuro, implementa HTTPS per tutte le comunicazioni, cripta i dati archiviati, autentica le chiamate API e limita l'accesso tramite permessi basati sui ruoli. È inoltre consigliato eseguire audit regolari del sistema e rispettare le normative sulla privacy come GDPR o HIPAA.

3. Cos’è la sicurezza dei chatbot?

La sicurezza dei chatbot è l'insieme delle pratiche che proteggono utenti e sistemi da rischi come violazioni dei dati, disinformazione, attacchi di ingegneria sociale o interazioni abusive. Comprende l'applicazione di filtri sui contenuti, la protezione dei canali dati, la validazione degli input e l'attivazione di un intervento umano quando necessario.

4. Qual è il chatbot più sicuro?

Il chatbot più sicuro è quello distribuito con crittografia end-to-end, controlli di accesso rigorosi, opzioni on-premise o cloud privato e conformità a certificazioni come SOC 2, ISO 27001 o HIPAA.