AI jest na ustach wszystkich. I zawsze pojawia się pytanie: jak bezpieczne jest to nowe narzędzie AI?

Jeśli rozważasz wdrożenie chatbota w firmie, bezpieczeństwo chatbota powinno być dla Ciebie priorytetem.

W tym artykule omówię najważniejsze zagrożenia związane z bezpieczeństwem chatbotów oraz środki ostrożności, które Twoja organizacja powinna wdrożyć przy implementacji chatbota AI lub agenta AI.

Czy chatboty są bezpieczne?

Nie wszystkie chatboty są bezpieczne – nigdy nie masz pewności, jakie środki bezpieczeństwa zostały zastosowane podczas ich tworzenia. Jednak przy odpowiednich narzędziach można zbudować i wdrożyć bezpiecznego chatbota.

Bezpieczeństwo chatbotów to szeroki temat, ponieważ istnieje wiele sposobów budowy chatbotów i agentów AI oraz niezliczone scenariusze użycia. Każda z tych różnic wiąże się z unikalnymi aspektami bezpieczeństwa, które należy wziąć pod uwagę.

Jak mogę uniknąć zagrożeń związanych z chatbotami?

Bezpieczeństwo to kluczowy element projektu chatbota – nie można go traktować po macoszemu.

Jeśli nie czujesz się na siłach, skorzystaj z pomocy eksperta. Większość organizacji wdrażających chatboty współpracuje z partnerami AI: firmami specjalizującymi się w określonych projektach AI. Jeśli tworzysz chatbota, sprawdź naszą listę certyfikowanych ekspertów – znajdziesz tam freelancerów i agencje doświadczone w budowie, wdrażaniu i monitorowaniu bezpiecznych chatbotów.

W przeciwnym razie zdobądź wiedzę na temat zagrożeń dotyczących Twojego chatbota i podejmij wszelkie niezbędne kroki, by zapobiec niepożądanym skutkom.

Aby Ci to ułatwić, zebrałem najczęstsze zagrożenia związane z bezpieczeństwem chatbotów oraz informacje, jak sobie z nimi radzić.

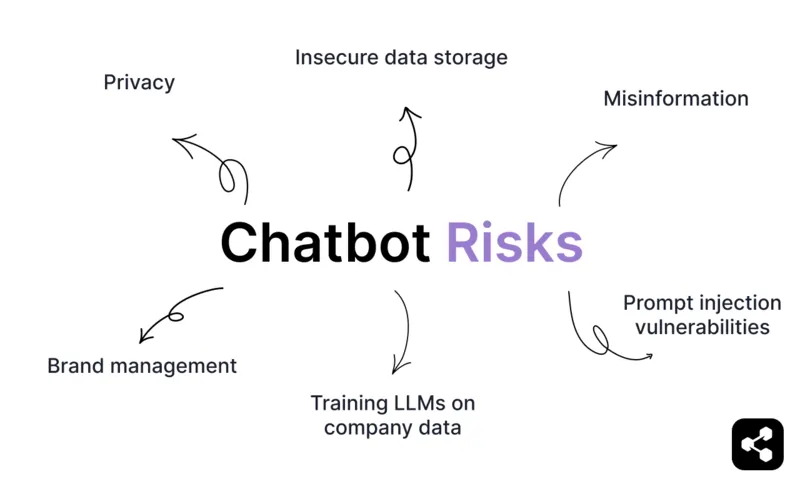

Zagrożenia związane z chatbotami

Prywatność i informacje poufne

Chatboty często przetwarzają dane osobowe, takie jak imiona, adresy e-mail czy dane finansowe. Oznacza to, że stanowią zagrożenie dla prywatności, jeśli obsługują wrażliwe dane użytkowników bez odpowiednich zabezpieczeń.

Ma to szczególne znaczenie w przypadku chatbotów medycznych, chatbotów obsługujących płatności, chatbotów finansowych, chatbotów bankowych lub każdego chatbota korporacyjnego przetwarzającego dane wrażliwe.

Jeśli te dane są przechowywane w nieodpowiedni sposób lub przesyłane bez szyfrowania, stają się podatne na wycieki – co naraża firmy na poważne konsekwencje prawne, finansowe i wizerunkowe.

Dezinformacja i halucynacje

Chatboty oparte na LLM – jeśli są źle zbudowane – mogą rozpowszechniać nieprawdziwe informacje.

Przykładem jest słynna afera z chatbotem Air Canada. Pasażer otrzymał od chatbota na stronie firmy informację, że może ubiegać się o zniżkę na lot po śmierci babci.

Gdy klient zwrócił się o zwrot kosztów, dowiedział się, że polityka nie obejmuje już zrealizowanych podróży. Firma przyznała, że chatbot użył „wprowadzających w błąd sformułowań”, a sprawa trafiła do sądu.

Takie halucynacje nie tylko kompromitują markę – mogą ją też sporo kosztować.

Można jednak zbudować chatboty, które trzymają się tematu i są zgodne z wizerunkiem marki. Jeden z naszych klientów, platforma coachingowa w zakresie zdrowia, dzięki chatbotowi zredukował liczbę zgłoszeń do wsparcia o 65%. W trakcie 100 000 rozmów firma nie odnotowała żadnych halucynacji.

Jak to możliwe? Generowanie wspomagane wyszukiwaniem (RAG) odgrywa kluczową rolę w większości chatbotów korporacyjnych. Zamiast generować swobodne odpowiedzi, RAG łączy możliwości generatywne chatbota z bazą zweryfikowanych, aktualnych informacji. Dzięki temu odpowiedzi są oparte na faktach, a nie domysłach.

Chatboty korporacyjne mają też inne zabezpieczenia, które są niezbędne przed udostępnieniem ich publicznie – omówimy je poniżej.

Niebezpieczne przechowywanie danych

Jeśli chatbot przechowuje dane na serwerach lub w chmurze, niewystarczające zabezpieczenia mogą narazić je na wyciek.

Nieaktualne oprogramowanie, źle skonfigurowane serwery czy brak szyfrowania mogą zostać wykorzystane przez atakujących do uzyskania dostępu do wrażliwych danych użytkowników.

Na przykład niektóre chatboty przechowują kopie zapasowe danych bez odpowiedniego szyfrowania, co naraża je na przechwycenie podczas transferu lub nieautoryzowany dostęp.

Podatność na wstrzykiwanie promptów i szkodliwe odpowiedzi

Jeśli wdrożysz słabego chatbota, może on być podatny na destrukcyjne polecenia.

Na przykład, jeśli Twój chatbot pomaga sprzedawać samochody w salonie, nie chcesz, by sprzedawał ciężarówkę za 1 dolara. (Patrz: słynny incydent z Chevy Tahoe.)

Chatboty mogą generować szkodliwe lub bezsensowne odpowiedzi, jeśli ich działanie nie jest odpowiednio kontrolowane. Takie błędy wynikają z braku zabezpieczeń, walidacji lub manipulacji ze strony użytkowników.

Na szczęście to jedno z łatwiejszych do uniknięcia zagrożeń. Solidne chatboty stosują zabezpieczenia konwersacji, które zapobiegają rozmowom nie na temat lub niezgodnym z marką, zanim do nich dojdzie.

Uczenie LLM na danych firmowych

Szkolenie chatbotów na danych firmowych może wiązać się z ryzykiem dla prywatności i bezpieczeństwa, szczególnie przy korzystaniu z platform ogólnego przeznaczenia, takich jak ChatGPT. Wykorzystując firmowe informacje w takich chatbotach, zawsze istnieje ryzyko wycieku danych.

Dedykowane chatboty znacznie ułatwiają ochronę danych. Platformy chatbotów korporacyjnych są zazwyczaj projektowane z myślą o izolacji danych i bezpieczeństwie. Takie chatboty są trenowane w kontrolowanych środowiskach, co znacząco ogranicza ryzyko wycieku informacji.

Zarządzanie marką

Największe publiczne wpadki chatbotów dotyczyły zarządzania marką. Jak dobrze Twój chatbot reprezentuje Twoją firmę? To kluczowy aspekt bezpieczeństwa chatbota.

Chatboty są często pierwszym punktem kontaktu klientów z Twoją firmą, a jeśli ich odpowiedzi są nieprecyzyjne, nieodpowiednie lub niezgodne z tonem marki, mogą zaszkodzić jej reputacji.

To ryzyko również można ograniczyć dzięki zabezpieczeniom konwersacji i odpowiedniemu projektowi rozmów.

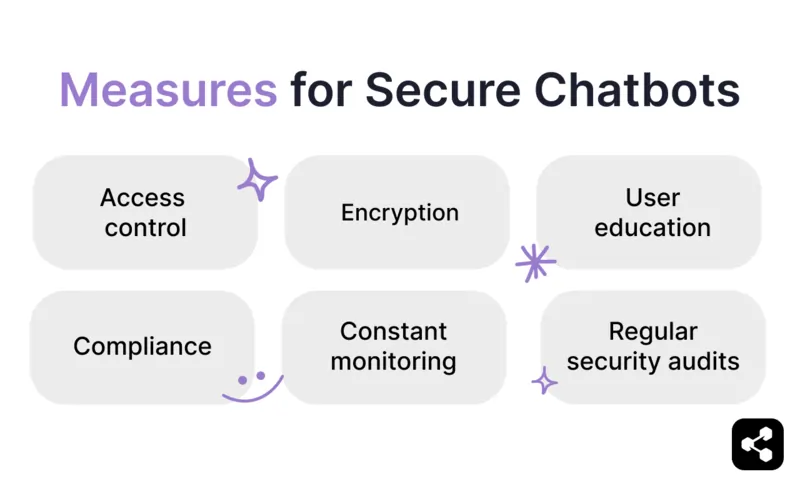

Niezbędne środki bezpieczeństwa dla bezpiecznych chatbotów

Kontrola dostępu i bezpieczny dostęp użytkowników

Jeśli to narzędzie dla szerokiego grona użytkowników, nie zawsze chcesz, by każdy miał taki sam poziom dostępu.

Uwierzytelnianie pozwala zweryfikować tożsamość użytkownika – dzięki temu tylko uprawnione osoby mogą się zalogować. Po uwierzytelnieniu autoryzacja określa, do jakich funkcji i danych użytkownik ma dostęp, w zależności od swojej roli lub uprawnień.

Kluczowym elementem jest kontrola dostępu oparta na rolach (RBAC), która zapewnia, że użytkownicy mają dostęp tylko do tych informacji i funkcji, które są im potrzebne do pracy. Oznacza to:

- Ograniczenie dostępu do wrażliwych danych tylko dla upoważnionych osób.

- Możliwość edycji chatbota wyłącznie dla administratorów.

- Definiowanie ról użytkowników z jasno określonymi, egzekwowalnymi uprawnieniami.

Wdrażając RBAC wraz z bezpiecznymi protokołami uwierzytelniania i autoryzacji, minimalizujesz ryzyko nieautoryzowanego dostępu, wycieku danych i przypadkowego nadużycia. To proste, ale kluczowe zabezpieczenie przy wdrażaniu bezpiecznych chatbotów.

Regularne audyty bezpieczeństwa

Podobnie jak każde inne zaawansowane oprogramowanie, chatboty powinny być regularnie poddawane audytom bezpieczeństwa.

Regularne audyty bezpieczeństwa to kompleksowa analiza architektury, konfiguracji i procesów Twojego chatbota, aby upewnić się, że spełniają one standardy bezpieczeństwa i branżowe dobre praktyki.

Audyty obejmują zwykle testowanie podatności – takich jak słabe protokoły uwierzytelniania, źle skonfigurowane serwery czy otwarte API – oraz ocenę skuteczności istniejących zabezpieczeń, takich jak szyfrowanie i kontrola dostępu.

Audyty sprawdzają także zgodność z przepisami o ochronie danych, upewniając się, że chatbot spełnia wymagania takich regulacji jak RODO czy SOC 2.

Proces ten obejmuje często:

- Testy penetracyjne, które symulują potencjalne ataki

- Przeglądy kodu w celu wykrycia ukrytych błędów

- Monitorowanie nietypowej aktywności

Audyty bezpieczeństwa to działanie prewencyjne, które pozwala ocenić odporność chatbota na zagrożenia i potwierdzić, że potrafi on bezpiecznie przetwarzać wrażliwe informacje.

Szyfrowanie

Szyfrowanie to proces przekształcania danych w bezpieczny format, aby zapobiec nieautoryzowanemu dostępowi. W przypadku danych wrażliwych obejmuje to dwa główne rodzaje: szyfrowanie danych w spoczynku, które chroni informacje przechowywane, oraz szyfrowanie danych w tranzycie, które zabezpiecza dane podczas przesyłania.

Stosowanie silnych protokołów szyfrowania, takich jak AES (Advanced Encryption Standard), gwarantuje, że nawet jeśli dane zostaną przechwycone, pozostaną nieczytelne.

Dla chatbotów obsługujących wrażliwe informacje szyfrowanie jest niezbędnym zabezpieczeniem chroniącym prywatność użytkowników i zapewniającym zgodność z normami bezpieczeństwa.

Stały monitoring

Nasza Platforma jako Usługa proponuje 3 etapy wdrożenia chatbota: budowanie, wdrażanie i monitorowanie.

Klienci często zapominają o ostatnim etapie podczas planowania, ale to właśnie monitorowanie jest najważniejsze.

Obejmuje to:

- Śledzenie wskaźników wydajności

- Identyfikowanie podatności

- Rozwiązywanie problemów, takich jak halucynacje lub wycieki danych

Regularne aktualizacje i testy pomagają zapewnić, że Twój chatbot dostosowuje się do nowych zagrożeń i pozostaje zgodny z branżowymi regulacjami.

Bez odpowiedniego monitorowania nawet najlepiej zaprojektowany chatbot z czasem może stać się zagrożeniem.

Zgodność

Jeśli Twój chatbot będzie przetwarzał dane wrażliwe, musisz wybrać platformę zgodną z kluczowymi ramami zgodności.

Najczęściej stosowane i istotne ramy zgodności to:

- GDPR: Ogólne Rozporządzenie o Ochronie Danych

- CCPA: Kalifornijska Ustawa o Ochronie Prywatności Konsumentów

- HIPAA: Ustawa o przenośności i odpowiedzialności w ubezpieczeniach zdrowotnych

- SOC 2: Kontrole Systemów i Organizacji 2

Jeśli będziesz przetwarzać dane osób z UE, potrzebujesz chatbota zgodnego z GDPR.

Aby w pełni spełnić wymagania, potrzebujesz zarówno a) platformy stosującej odpowiednie środki zgodności, jak i b) działań ze strony twórców chatbota (np. odpowiedniego zarządzania danymi po ich otrzymaniu przez chatbota).

Edukacja użytkowników

Czasami problemem nie jest technologia, lecz brak wiedzy użytkowników.

Ważnym elementem wdrażania technologii chatbotów jest odpowiednie przygotowanie pracowników na nowe zagrożenia i wyzwania (oraz liczne korzyści).

Przeszkol swoich pracowników, jak korzystać z chatbota w pracy bez ryzyka dla reputacji firmy. Idealnie, jeśli Twój chatbot będzie miał wystarczające zabezpieczenia, by praktycznie uniemożliwić jego niewłaściwe użycie.

Wdrażaj najbezpieczniejszego chatbota na rynku

Bezpieczeństwo powinno być priorytetem przy inwestycji w chatbota dla firmy.

Botpress to platforma AI i chatbotów używana przez 35% firm z listy Fortune 500. Nasz zaawansowany pakiet zabezpieczeń zapewnia maksymalną kontrolę nad narzędziami AI.

Nasz prywatny gateway LLM, tarcza prywatności, wbudowany agent bezpieczeństwa oraz system ochrony marki gwarantują naszym klientom najbezpieczniejsze doświadczenie z chatbotem na rynku.

Rozpocznij budowę już dziś. To nic nie kosztuje.

Lub umów się na rozmowę z naszym zespołem, aby rozpocząć.

Najczęstsze pytania

1. Jak chatboty przechowują dane?

Chatboty przechowują dane w bezpiecznych bazach danych – zazwyczaj w chmurze – stosując szyfrowanie zarówno w spoczynku, jak i podczas przesyłania. Przechowywane dane mogą obejmować logi rozmów i metadane, a ich struktura często wspiera personalizację lub zgodność z przepisami.

2. Jak zapewnić bezpieczeństwo chatbota?

Aby zapewnić bezpieczeństwo chatbota, wdrażaj HTTPS dla wszystkich połączeń, szyfruj przechowywane dane, uwierzytelniaj wywołania API i ograniczaj dostęp za pomocą uprawnień opartych na rolach. Regularnie audytuj system i przestrzegaj przepisów o ochronie danych, takich jak GDPR czy HIPAA.

3. Czym jest bezpieczeństwo chatbota?

Bezpieczeństwo chatbota to zbiór praktyk chroniących użytkowników i systemy przed zagrożeniami, takimi jak wycieki danych, dezinformacja, ataki socjotechniczne czy nadużycia. Obejmuje stosowanie filtrów treści, zabezpieczanie kanałów danych, walidację danych wejściowych oraz możliwość przekazania rozmowy człowiekowi w razie potrzeby.

4. Jaki chatbot jest najbezpieczniejszy?

Najbezpieczniejszy chatbot to taki, który działa z szyfrowaniem end-to-end, ścisłą kontrolą dostępu, opcją wdrożenia lokalnie lub w prywatnej chmurze oraz zgodnością z certyfikatami takimi jak SOC 2, ISO 27001 czy HIPAA.