AI sedang menjadi perbincangan semua orang. Dan selalu muncul pertanyaan lanjutan: seberapa aman alat AI baru ini?

Jika Anda tertarik menerapkan chatbot untuk perusahaan, maka keamanan chatbot harus menjadi prioritas utama.

Pada artikel ini, saya akan membahas semua risiko keamanan utama pada chatbot, serta langkah-langkah pencegahan yang perlu diambil organisasi Anda saat mengimplementasikan chatbot AI atau agen AI.

Apakah chatbot aman?

Tidak semua chatbot itu aman – Anda tidak pernah tahu langkah keamanan apa saja yang diterapkan saat pengembangannya. Namun, membangun dan menjalankan chatbot yang aman sangat mungkin dilakukan dengan alat yang tepat.

Keamanan chatbot adalah topik yang luas, karena ada banyak cara membangun chatbot atau agen AI, serta berbagai macam kasus penggunaan. Setiap perbedaan ini membawa aspek keamanan tersendiri yang perlu Anda pertimbangkan.

Apa yang bisa saya lakukan untuk menghindari risiko chatbot?

Keamanan adalah bagian penting dari proyek chatbot Anda – strategi keamanan Anda tidak boleh setengah-setengah.

Jika Anda merasa kurang paham, libatkan ahli. Sebagian besar organisasi yang membangun dan menjalankan chatbot dibantu oleh mitra AI: organisasi yang ahli dalam proyek AI tertentu. Jika Anda sedang membangun chatbot, Anda bisa melihat daftar ahli bersertifikat kami, yaitu daftar freelancer dan agensi yang berpengalaman dalam membangun, menjalankan, dan memantau chatbot yang aman.

Jika tidak, pelajari risiko yang relevan dengan chatbot Anda dan ambil semua langkah yang diperlukan untuk mencegah hasil yang tidak diinginkan.

Saya sudah mempermudah Anda dengan merangkum risiko keamanan chatbot yang paling umum dan memberikan informasi cara mengatasinya.

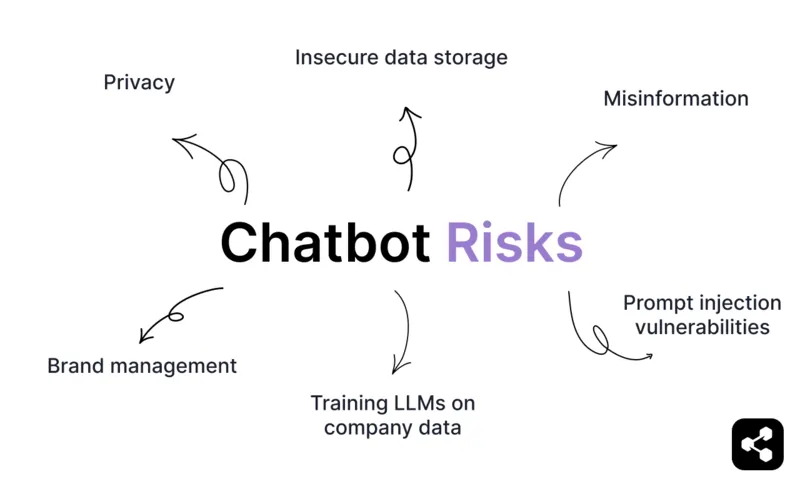

Risiko Chatbot

Privasi & Informasi Rahasia

Chatbot sering menangani data pribadi, seperti nama, alamat email, atau detail keuangan. Artinya, chatbot menjadi risiko privasi jika menangani data sensitif pengguna tanpa perlindungan yang kuat.

Hal ini sangat penting pada chatbot medis, chatbot yang memproses pembayaran apa pun, chatbot keuangan, chatbot perbankan, atau chatbot perusahaan yang menangani data sensitif.

Jika data ini disimpan secara tidak aman atau dikirim tanpa enkripsi, data tersebut rentan terhadap pelanggaran – sehingga bisnis terpapar risiko hukum, finansial, dan reputasi yang besar.

Misinformasi dan Halusinasi

Chatbot yang didukung LLM – jika dibangun dengan buruk – berisiko menyebarkan informasi yang salah.

Lihat saja kasus chatbot Air Canada yang terkenal. Seorang penumpang diberi tahu oleh chatbot di situs web perusahaan bahwa ia bisa mengajukan tarif belasungkawa untuk penerbangan setelah neneknya meninggal.

Setelah mengajukan permohonan pengembalian dana, pelanggan diberi tahu bahwa kebijakan tersebut hanya berlaku untuk perjalanan yang belum dilakukan. Perusahaan mengakui bahwa chatbot telah menggunakan 'kata-kata menyesatkan', dan kasus ini dibawa ke pengadilan.

Halusinasi semacam ini tidak hanya mempermalukan merek – tapi juga merugikan mereka.

Namun, membangun chatbot yang tetap fokus dan sesuai merek itu memungkinkan. Salah satu klien kami, sebuah platform pelatihan kesehatan, berhasil mengurangi tiket dukungan manual hingga 65% dengan chatbot. Selama 100.000 percakapan, perusahaan tidak menemukan satu pun halusinasi.

Bagaimana caranya? Retrieval-augmented generation (RAG) sangat berperan dalam kebanyakan chatbot perusahaan. Alih-alih menghasilkan jawaban bebas, RAG menggabungkan kemampuan generatif chatbot dengan basis data informasi yang terverifikasi dan terbaru. Ini memastikan jawaban yang diberikan didasarkan pada fakta, bukan asumsi atau dugaan.

Chatbot perusahaan juga memiliki tindakan pengaman lain yang wajib diterapkan sebelum digunakan secara publik – akan dibahas di bawah.

Penyimpanan Data yang Tidak Aman

Jika chatbot Anda menyimpan data di server atau lingkungan cloud, protokol keamanan yang kurang memadai dapat membuatnya rentan terhadap pelanggaran.

Perangkat lunak yang usang, server yang salah konfigurasi, atau data yang tidak dienkripsi dapat dimanfaatkan penyerang untuk mengakses informasi sensitif pengguna.

Misalnya, beberapa chatbot menyimpan cadangan data tanpa enkripsi yang memadai, sehingga rentan disadap saat transfer atau diakses tanpa izin.

Kerentanan Prompt Injection & Output Berbahaya

Jika Anda menjalankan chatbot yang lemah, chatbot tersebut bisa saja mudah dipengaruhi prompt yang merusak.

Misalnya, jika chatbot Anda membantu menjual kendaraan dealer Anda, Anda tentu tidak ingin chatbot menjual truk seharga $1. (Lihat insiden Chevy Tahoe yang terkenal.)

Chatbot dapat menghasilkan jawaban yang berbahaya atau tidak masuk akal jika output-nya tidak dikendalikan dengan baik. Kesalahan ini bisa terjadi karena kurangnya pengaman, tidak ada validasi, atau manipulasi oleh pengguna.

Namun, ini adalah salah satu risiko keamanan yang paling mudah dihindari. Chatbot yang kuat akan menggunakan tindakan pengaman percakapan untuk mencegah percakapan yang tidak sesuai topik atau tidak sesuai merek sebelum terjadi.

Melatih LLM dengan Data Perusahaan

Melatih chatbot dengan data perusahaan dapat menimbulkan risiko privasi dan keamanan, terutama pada platform umum seperti ChatGPT. Saat menggunakan informasi perusahaan pada chatbot umum, selalu ada risiko kebocoran data.

Sebaliknya, chatbot kustom jauh lebih mudah untuk melindungi data Anda. Platform chatbot kelas perusahaan biasanya dirancang dengan isolasi data dan keamanan sebagai prioritas. Chatbot ini dilatih dalam lingkungan yang terkontrol, sehingga risiko kebocoran data jauh lebih kecil.

Manajemen Merek

Kasus chatbot publik terbesar biasanya berkaitan dengan manajemen merek. Seberapa baik chatbot Anda mewakili merek Anda? Inilah inti dari keamanan chatbot.

Chatbot sering menjadi kontak pertama pelanggan dengan bisnis Anda, dan jika jawaban mereka tidak akurat, tidak pantas, atau tidak sesuai nada, reputasi merek Anda bisa tercoreng.

Sekali lagi, risiko ini bisa dihindari dengan tindakan pengaman percakapan dan desain percakapan yang baik.

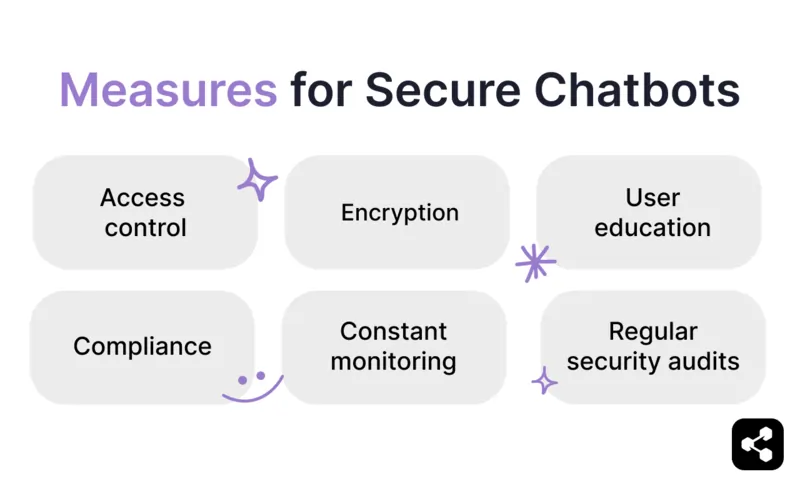

Langkah Keamanan Penting untuk Chatbot yang Aman

Kontrol Akses & Akses Pengguna yang Aman

Jika ini adalah alat yang digunakan banyak orang, Anda tidak selalu ingin semua orang memiliki tingkat akses yang sama.

Autentikasi memverifikasi siapa pengguna — memastikan hanya pengguna yang sah yang dapat masuk. Setelah terautentikasi, otorisasi menentukan apa saja yang boleh dilakukan setiap pengguna, sesuai peran atau izin mereka.

Bagian penting dari ini adalah kontrol akses berbasis peran (RBAC), yang memastikan pengguna hanya dapat mengakses informasi dan fitur yang mereka butuhkan untuk menjalankan perannya. Artinya:

- Membatasi akses data sensitif hanya untuk personel yang berwenang.

- Membatasi kemampuan mengedit chatbot hanya untuk admin.

- Menetapkan peran pengguna dengan izin yang jelas dan dapat ditegakkan.

Dengan menerapkan RBAC bersama protokol autentikasi dan otorisasi yang aman, Anda dapat meminimalkan risiko seperti akses tidak sah, kebocoran data, dan penyalahgunaan yang tidak disengaja. Ini adalah pengaman sederhana namun penting untuk penerapan chatbot yang aman.

Audit Keamanan Berkala

Seperti perangkat lunak berkinerja tinggi lainnya, perangkat lunak chatbot juga harus menjalani audit keamanan secara berkala.

Audit keamanan berkala adalah tinjauan menyeluruh terhadap arsitektur, konfigurasi, dan proses chatbot Anda untuk memastikan bahwa semuanya memenuhi standar keamanan dan praktik terbaik industri.

Audit ini biasanya mencakup pengujian kerentanan—seperti protokol autentikasi yang lemah, server yang salah konfigurasi, atau API yang terekspos—serta penilaian efektivitas langkah-langkah keamanan yang ada seperti enkripsi dan kontrol akses.

Audit juga menilai kepatuhan terhadap regulasi perlindungan data, memastikan chatbot Anda mematuhi kerangka kerja seperti GDPR atau SOC 2.

Proses ini biasanya meliputi:

- Pengujian penetrasi untuk mensimulasikan potensi serangan

- Tinjauan kode untuk menemukan celah tersembunyi

- Pemantauan aktivitas yang tidak biasa

Audit keamanan adalah langkah proaktif untuk menilai ketahanan chatbot Anda terhadap ancaman dan memastikan kemampuannya menangani informasi sensitif dengan aman.

Enkripsi

Enkripsi adalah proses mengubah data menjadi format yang aman untuk mencegah akses tidak sah. Untuk data sensitif, ini mencakup dua jenis utama: enkripsi data-at-rest, yang melindungi informasi yang disimpan, dan enkripsi data-in-transit, yang mengamankan data saat sedang dikirimkan.

Menggunakan protokol enkripsi yang kuat seperti AES (Advanced Encryption Standard) memastikan bahwa meskipun data dicegat, data tersebut tetap tidak dapat dibaca.

Untuk chatbot yang menangani informasi sensitif, enkripsi adalah perlindungan wajib untuk menjaga privasi pengguna dan mematuhi standar keamanan.

Pemantauan Berkelanjutan

Platform-as-a-Service kami menyarankan 3 tahap implementasi chatbot: membangun, menerapkan, dan memantau.

Pelanggan sering kali lupa tahap terakhir saat membuat rencana awal mereka, padahal pemantauan adalah langkah terpenting dari semuanya.

Ini mencakup:

- Melacak metrik performa

- Mengidentifikasi kerentanan

- Menangani masalah seperti halusinasi atau kebocoran data

Pembaruan dan pengujian rutin membantu memastikan chatbot Anda dapat beradaptasi dengan ancaman yang berkembang dan tetap patuh pada regulasi industri.

Tanpa pemantauan yang tepat, bahkan chatbot yang paling baik pun bisa menjadi risiko seiring waktu.

Kepatuhan

Jika chatbot Anda akan menangani data sensitif, Anda perlu memilih platform yang mematuhi kerangka kerja kepatuhan utama.

Kerangka kerja kepatuhan yang paling umum dan relevan meliputi:

- GDPR: General Data Protection Regulation

- CCPA: California Consumer Privacy Act

- HIPAA: Health insurance Portability and Accountability Act

- SOC 2: System and Organization Controls 2

Jika Anda akan memproses data dari individu di Uni Eropa, Anda perlu memiliki chatbot yang patuh GDPR.

Untuk benar-benar patuh, diperlukan a) platform yang mengikuti langkah-langkah kepatuhan yang tepat dan b) beberapa tindakan dari pembuat chatbot Anda (misalnya cara Anda menangani data setelah diterima oleh chatbot).

Edukasi Pengguna

Terkadang bukan teknologinya yang salah – melainkan kurangnya pemahaman dari penggunanya.

Bagian penting dari penerapan teknologi chatbot adalah mempersiapkan karyawan Anda dengan baik terhadap risiko dan tantangan baru (serta berbagai manfaatnya).

Edukasi karyawan Anda tentang cara mengintegrasikan chatbot ke dalam pekerjaan mereka tanpa membahayakan reputasi perusahaan. Idealnya, chatbot Anda akan dibangun dengan perlindungan yang cukup sehingga hampir tidak mungkin untuk disalahgunakan.

Luncurkan Chatbot Paling Aman di Pasar

Keamanan harus menjadi prioritas utama dalam investasi chatbot perusahaan Anda.

Botpress adalah platform agen AI dan chatbot yang digunakan oleh 35% perusahaan Fortune 500. Paket keamanan mutakhir kami memungkinkan kontrol maksimal atas alat AI Anda.

Gateway LLM privat kami, pelindung privasi, agen keamanan bawaan, dan kerangka perlindungan merek memastikan klien kami mendapatkan pengalaman chatbot paling aman di pasar.

Mulai membangun hari ini. Gratis.

Atau jadwalkan panggilan dengan tim kami untuk memulai.

FAQ

1. Bagaimana chatbot menyimpan data?

Chatbot menyimpan data di basis data yang aman – biasanya berbasis cloud – dengan enkripsi baik saat disimpan maupun saat dikirim. Data yang disimpan dapat mencakup log percakapan dan metadata, serta sering diatur untuk mendukung personalisasi atau kepatuhan regulasi.

2. Bagaimana saya bisa memastikan chatbot yang aman?

Untuk chatbot yang aman, terapkan HTTPS untuk semua komunikasi, enkripsi data yang disimpan, autentikasi panggilan API, dan batasi akses menggunakan izin berbasis peran. Anda juga harus secara rutin mengaudit sistem dan mematuhi undang-undang privasi data seperti GDPR atau HIPAA.

3. Apa itu keamanan chatbot?

Keamanan chatbot adalah serangkaian praktik yang melindungi pengguna dan sistem dari risiko seperti pelanggaran data, misinformasi, serangan rekayasa sosial, atau interaksi yang bersifat kasar. Ini mencakup penerapan filter konten, pengamanan saluran data, validasi input, dan menyediakan opsi eskalasi ke manusia jika diperlukan.

4. Apa chatbot yang paling aman?

Chatbot paling aman adalah yang diterapkan dengan enkripsi end-to-end, kontrol akses yang ketat, pilihan on-premise atau cloud privat, serta mematuhi sertifikasi seperti SOC 2, ISO 27001, atau HIPAA.