AI kini menjadi perbualan ramai. Dan ia sering menimbulkan persoalan susulan: sejauh mana selamatnya alat AI baharu ini?

Jika anda berminat untuk melaksanakan chatbot untuk syarikat, keselamatan chatbot perlu menjadi keutamaan.

Dalam artikel ini, saya akan terangkan semua risiko utama keselamatan chatbot, serta langkah berjaga-jaga yang perlu diambil oleh organisasi anda apabila melaksanakan AI chatbot atau AI agent.

Adakah chatbot selamat?

Tidak semua chatbot selamat – anda tidak tahu langkah keselamatan apa yang telah diambil semasa pembangunannya. Namun, adalah mungkin untuk membina dan melancarkan chatbot yang selamat dengan alat yang betul.

Keselamatan chatbot adalah topik yang luas, kerana terdapat pelbagai cara untuk membina chatbot atau AI agent, serta pelbagai kegunaan. Setiap perbezaan ini membawa aspek keselamatan tersendiri yang perlu dipertimbangkan.

Apa yang boleh saya lakukan untuk mengelakkan risiko chatbot?

Keselamatan adalah bahagian penting dalam projek chatbot anda – strategi keselamatan anda tidak boleh dibuat sambil lewa.

Jika anda rasa kurang berpengalaman, dapatkan bantuan pakar. Kebanyakan organisasi yang membina dan melancarkan chatbot dibimbing oleh rakan AI: organisasi yang pakar dalam jenis projek AI tertentu. Jika anda ingin membina chatbot, anda boleh lihat senarai pakar bertauliah kami, iaitu senarai freelancer dan agensi yang berpengalaman dalam membina, melancarkan, dan memantau chatbot yang selamat.

Jika tidak, tingkatkan pengetahuan anda tentang risiko yang berkaitan dengan chatbot anda dan ambil semua langkah yang perlu untuk mencegah hasil yang tidak diingini.

Saya telah memudahkan tugas anda dengan menyenaraikan risiko keselamatan chatbot yang paling biasa dan memberikan maklumat tentang cara menanganinya.

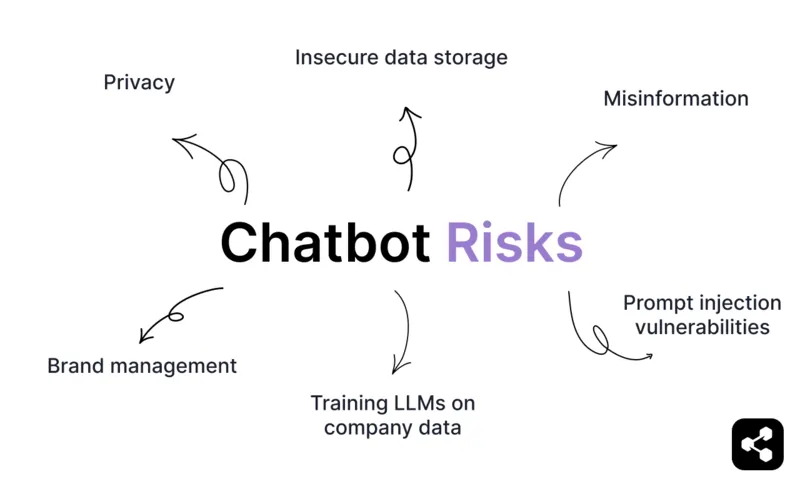

Risiko Chatbot

Privasi & Maklumat Sulit

Chatbot sering mengendalikan data peribadi, seperti nama, alamat emel, atau maklumat kewangan. Ini bermakna ia menjadi risiko privasi jika mengendalikan data sensitif pengguna tanpa perlindungan yang kukuh.

Ini sangat penting untuk chatbot perubatan, chatbot yang memproses pembayaran, chatbot kewangan, chatbot perbankan, atau mana-mana chatbot perusahaan yang mengendalikan data sensitif.

Jika data ini disimpan tanpa selamat atau dihantar tanpa penyulitan, ia menjadi terdedah kepada pencerobohan – sekali gus mendedahkan perniagaan kepada risiko undang-undang, kewangan, dan reputasi yang besar.

Maklumat Palsu dan Halusinasi

Chatbot yang dikuasakan oleh LLM – jika dibina secara tidak betul – berisiko menyebarkan maklumat palsu.

Lihat sahaja insiden chatbot Air Canada yang terkenal. Seorang penumpang dimaklumkan oleh chatbot laman web syarikat bahawa dia boleh memohon kadar bersempena kematian selepas neneknya meninggal dunia.

Selepas menghubungi untuk mendapatkan bayaran balik, pelanggan diberitahu bahawa polisi itu hanya tidak terpakai untuk perjalanan yang telah selesai. Syarikat mengakui chatbot telah menggunakan 'kata-kata mengelirukan', dan kes ini dibawa ke mahkamah.

Halusinasi seperti ini bukan sahaja memalukan jenama – ia juga merugikan mereka.

Namun, adalah mungkin untuk membina chatbot yang kekal fokus dan selari dengan jenama. Salah satu pelanggan kami, sebuah platform bimbingan kesihatan, berjaya mengurangkan sokongan tiket manual sebanyak 65% dengan chatbot. Sepanjang 100,000 perbualan, syarikat mendapati tiada halusinasi berlaku.

Bagaimana? Retrieval-augmented generation (RAG) memainkan peranan penting dalam kebanyakan chatbot perusahaan. Daripada menjana jawapan secara bebas, RAG menggabungkan keupayaan generatif chatbot dengan pangkalan data maklumat yang disahkan dan terkini. Ini memastikan jawapan yang diberikan adalah berdasarkan fakta, bukan andaian atau tekaan.

Chatbot perusahaan juga mempunyai langkah perlindungan keselamatan lain yang perlu sebelum dilancarkan secara umum – kita akan bincangkan selepas ini.

Penyimpanan Data Tidak Selamat

Jika chatbot anda menyimpan data di pelayan atau persekitaran awan, protokol keselamatan yang lemah boleh menyebabkan ia terdedah kepada pencerobohan.

Perisian yang lapuk, pelayan yang salah konfigurasi, atau data yang tidak disulitkan boleh dieksploitasi oleh penyerang untuk mendapatkan maklumat sensitif pengguna.

Sebagai contoh, sesetengah chatbot menyimpan sandaran data tanpa penyulitan yang betul, menjadikannya mudah dipintas semasa pemindahan atau diakses tanpa kebenaran.

Kerentanan Suntikan Prompt & Output Berbahaya

Jika anda melancarkan chatbot yang lemah, ia mungkin mudah terdedah kepada prompt yang merosakkan.

Sebagai contoh, jika chatbot anda membantu menjual kenderaan di pengedar anda, anda tidak mahu ia menjual trak dengan harga $1. (Lihat insiden Chevy Tahoe yang terkenal.)

Chatbot boleh menghasilkan jawapan yang berbahaya atau tidak masuk akal jika outputnya tidak dikawal dengan baik. Kesilapan ini boleh berlaku akibat langkah perlindungan yang tidak mencukupi, tiada semakan pengesahan, atau manipulasi oleh pengguna.

Namun, ini adalah antara risiko keselamatan yang paling mudah dielakkan. Chatbot yang kukuh akan menggunakan langkah perlindungan perbualan untuk menghalang perbualan di luar topik atau di luar jenama sebelum ia berlaku.

Latihan LLM dengan Data Syarikat

Melatih chatbot menggunakan data syarikat boleh menimbulkan risiko privasi dan keselamatan, terutamanya dengan platform umum seperti ChatGPT. Apabila menggunakan maklumat syarikat dengan chatbot umum, sentiasa ada risiko kebocoran data.

Chatbot khusus, sebaliknya, lebih mudah untuk melindungi data anda. Platform chatbot bertaraf perusahaan biasanya direka dengan pengasingan data dan keselamatan sebagai keutamaan. Chatbot ini dilatih dalam persekitaran terkawal, sekali gus mengurangkan risiko kebocoran data.

Pengurusan Jenama

Kebanyakan insiden chatbot yang mendapat perhatian umum berkaitan dengan pengurusan jenama. Sejauh mana chatbot anda mewakili jenama anda? Inilah inti keselamatan chatbot.

Chatbot sering menjadi titik sentuhan pertama pelanggan dengan perniagaan anda, dan jika jawapan mereka tidak tepat, tidak sesuai, atau tidak selari dengan nada jenama, ia boleh menjejaskan reputasi perniagaan anda.

Sekali lagi, risiko ini boleh dielakkan dengan langkah perlindungan perbualan dan reka bentuk perbualan yang baik.

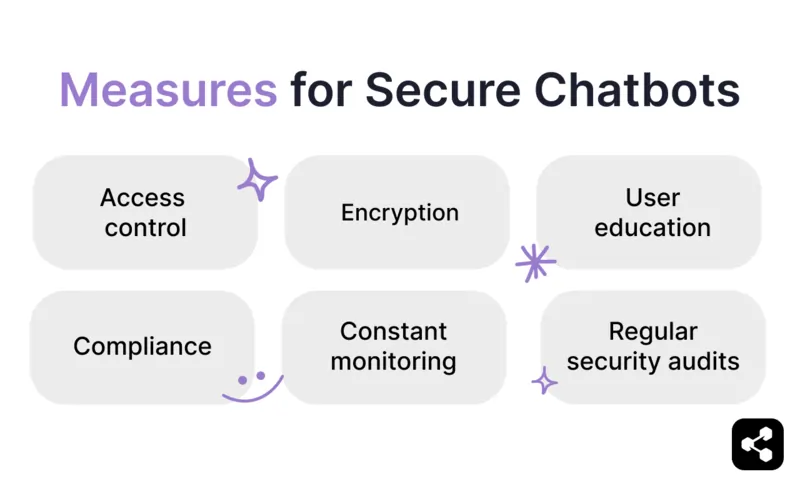

Langkah Keselamatan Penting untuk Chatbot Selamat

Kawalan Akses & Akses Pengguna Selamat

Jika ia adalah alat untuk orang ramai, anda tidak mahu semua orang mempunyai tahap akses yang sama.

Pengesahan mengesahkan identiti pengguna — memastikan hanya pengguna yang sah boleh log masuk. Selepas disahkan, kebenaran menentukan apa yang boleh dilakukan oleh setiap pengguna, berdasarkan peranan atau keizinan mereka.

Bahagian penting dalam hal ini ialah kawalan akses berasaskan peranan (RBAC), yang memastikan pengguna hanya mengakses maklumat dan ciri yang diperlukan untuk tugas mereka. Ini bermaksud:

- Menghadkan akses data sensitif kepada kakitangan yang diberi kuasa.

- Mengehadkan keupayaan mengedit chatbot kepada pentadbir sahaja.

- Menetapkan peranan pengguna dengan keizinan yang jelas dan boleh dikuatkuasakan.

Dengan melaksanakan RBAC bersama protokol pengesahan dan kebenaran yang selamat, anda boleh meminimumkan risiko seperti akses tanpa kebenaran, kebocoran data, dan penyalahgunaan secara tidak sengaja. Ia adalah langkah perlindungan asas tetapi penting untuk pelancaran chatbot yang selamat.

Audit Keselamatan Berkala

Seperti perisian berprestasi tinggi yang lain, perisian chatbot juga perlu menjalani audit keselamatan secara berkala.

Audit keselamatan berkala ialah semakan menyeluruh ke atas senibina, konfigurasi, dan proses chatbot anda untuk memastikan ia mematuhi piawaian keselamatan dan amalan terbaik industri.

Audit ini biasanya melibatkan ujian kerentanan – seperti protokol pengesahan yang lemah, pelayan yang salah konfigurasi, atau API yang terdedah – serta menilai keberkesanan langkah keselamatan sedia ada seperti penyulitan dan kawalan akses.

Audit juga menilai pematuhan terhadap peraturan perlindungan data, memastikan chatbot anda mematuhi kerangka seperti GDPR atau SOC 2.

Proses ini selalunya merangkumi:

- Ujian penembusan untuk mensimulasikan serangan yang berpotensi

- Semakan kod untuk mengesan kelemahan tersembunyi

- Pemantauan aktiviti luar biasa

Audit keselamatan ialah langkah proaktif untuk menilai ketahanan chatbot anda terhadap ancaman dan memastikan ia mampu mengendalikan maklumat sensitif dengan selamat.

Penyulitan

Penyulitan ialah proses menukar data kepada format yang selamat untuk mengelakkan akses tanpa kebenaran. Untuk data sensitif, ini merangkumi dua jenis utama: penyulitan data semasa disimpan, yang melindungi maklumat yang disimpan, dan penyulitan data semasa penghantaran, yang melindungi data ketika ia sedang dihantar.

Menggunakan protokol penyulitan yang kukuh seperti AES (Advanced Encryption Standard) memastikan bahawa walaupun data dipintas, ia tetap tidak dapat dibaca.

Bagi chatbot yang mengendalikan maklumat sensitif, penyulitan adalah langkah wajib untuk melindungi privasi pengguna dan mematuhi piawaian keselamatan.

Pemantauan Berterusan

Platform-as-a-Service kami mencadangkan 3 peringkat pelaksanaan chatbot: membina, melancar, dan memantau.

Pelanggan sering terlupa peringkat terakhir semasa merancang, tetapi pemantauan adalah langkah yang paling penting sekali.

Ini merangkumi:

- Menjejak metrik prestasi

- Mengenal pasti kelemahan

- Menangani isu seperti halusinasi atau kebocoran data

Kemas kini dan ujian berkala membantu memastikan chatbot anda menyesuaikan diri dengan ancaman yang berubah dan kekal mematuhi peraturan industri.

Tanpa pemantauan yang betul, walaupun chatbot yang dibina dengan baik boleh menjadi liabiliti dari masa ke masa.

Pematuhan

Jika chatbot anda akan mengendalikan data sensitif, anda perlu memilih platform yang mematuhi rangka kerja pematuhan utama.

Rangka kerja pematuhan yang paling biasa dan relevan termasuk:

- GDPR: Peraturan Perlindungan Data Umum

- CCPA: Akta Privasi Pengguna California

- HIPAA: Akta Kebolehpindahan dan Akauntabiliti Insurans Kesihatan

- SOC 2: Kawalan Sistem dan Organisasi 2

Jika anda akan memproses data daripada individu di EU, anda perlu mempunyai chatbot yang mematuhi GDPR.

Untuk mematuhi sepenuhnya, ia memerlukan a) platform yang mengikut langkah pematuhan yang betul dan b) sedikit usaha daripada pembina chatbot anda (seperti cara anda mengendalikan data selepas diterima oleh chatbot anda).

Pendidikan Pengguna

Kadang-kadang, bukan salah teknologi – ia adalah kekurangan pemahaman daripada penggunanya.

Bahagian penting dalam memperkenalkan teknologi chatbot ialah memastikan pekerja anda bersedia menghadapi risiko dan cabaran baharu (selain pelbagai manfaatnya).

Didik pekerja anda tentang cara mengintegrasikan chatbot ke dalam kerja mereka tanpa menjejaskan reputasi syarikat anda. Sebaiknya, chatbot anda dibina dengan kawalan keselamatan yang mencukupi supaya hampir mustahil untuk disalahgunakan.

Lancar Chatbot Paling Selamat di Pasaran

Keselamatan harus menjadi keutamaan utama dalam pelaburan chatbot syarikat anda.

Botpress ialah platform ejen AI dan chatbot yang digunakan oleh 35% syarikat Fortune 500. Suite keselamatan canggih kami membolehkan kawalan maksimum ke atas alat AI anda.

Gerbang LLM peribadi kami, pelindung privasi, ejen keselamatan terbina dalam, dan rangka kerja perlindungan jenama memastikan pelanggan kami menikmati pengalaman chatbot paling selamat di pasaran.

Mula membina hari ini. Ia percuma.

Atau tempah panggilan dengan pasukan kami untuk bermula.

Soalan Lazim

1. Bagaimana chatbot menyimpan data?

Chatbot menyimpan data dalam pangkalan data yang selamat – biasanya berasaskan awan – menggunakan penyulitan semasa disimpan dan semasa penghantaran. Data yang disimpan mungkin termasuk log perbualan dan metadata, dan sering distrukturkan untuk menyokong pemperibadian atau pematuhan peraturan.

2. Bagaimana saya boleh memastikan chatbot yang selamat?

Untuk chatbot yang selamat, gunakan HTTPS untuk semua komunikasi, enkripsi data yang disimpan, sahkan panggilan API, dan hadkan akses menggunakan kebenaran berasaskan peranan. Anda juga perlu mengaudit sistem secara berkala dan mematuhi undang-undang privasi data seperti GDPR atau HIPAA.

3. Apakah keselamatan chatbot?

Keselamatan chatbot ialah amalan yang melindungi pengguna dan sistem daripada risiko seperti pencerobohan data, maklumat palsu, serangan kejuruteraan sosial, atau interaksi yang kasar. Ia merangkumi penguatkuasaan penapis kandungan, melindungi saluran data, mengesahkan input, dan membolehkan sokongan manusia jika perlu.

4. Apakah chatbot yang paling selamat?

Chatbot yang paling selamat ialah yang dilancarkan dengan penyulitan hujung ke hujung, kawalan akses yang ketat, pilihan awan peribadi atau di premis, dan mematuhi pensijilan seperti SOC 2, ISO 27001, atau HIPAA.