AI đang là chủ đề được quan tâm của mọi người. Và nó luôn dẫn đến một câu hỏi tiếp theo: Công cụ AI mới này an toàn đến mức nào?

Nếu bạn đang cân nhắc triển khai chatbot cho doanh nghiệp, thì bảo mật chatbot nên là ưu tiên hàng đầu.

Trong bài viết này, tôi sẽ hướng dẫn bạn qua tất cả các rủi ro bảo mật chính của chatbot, cũng như các biện pháp phòng ngừa mà tổ chức của bạn cần thực hiện khi triển khai AI chatbot hoặc AI agent.

Chatbot có an toàn không?

Không phải tất cả chatbot đều an toàn – bạn không thể biết được các biện pháp bảo vệ nào đã được áp dụng khi phát triển chúng. Tuy nhiên, hoàn toàn có thể xây dựng và triển khai một chatbot an toàn nếu sử dụng đúng công cụ.

Bảo mật chatbot là một chủ đề rộng lớn, vì có rất nhiều cách để xây dựng chatbot hoặc AI agent, cũng như vô số trường hợp sử dụng. Mỗi điểm khác biệt này sẽ mang đến một khía cạnh bảo mật riêng mà bạn cần cân nhắc.

Tôi có thể làm gì để tránh rủi ro với chatbot?

Bảo mật là phần quan trọng trong dự án chatbot của bạn – chiến lược an toàn không thể làm nửa vời.

Nếu bạn cảm thấy vượt quá khả năng, hãy tìm đến chuyên gia. Hầu hết các tổ chức xây dựng và triển khai chatbot đều được các đối tác AI hướng dẫn: các tổ chức có chuyên môn về một loại dự án AI cụ thể. Nếu bạn đang xây dựng chatbot, bạn có thể xem danh sách chuyên gia được chứng nhận của chúng tôi – danh sách các freelancer và agency có kinh nghiệm xây dựng, triển khai và giám sát chatbot an toàn.

Ngoài ra, hãy tìm hiểu kỹ về các rủi ro liên quan đến chatbot của bạn và thực hiện mọi bước cần thiết để ngăn chặn các hậu quả không mong muốn.

Tôi đã giúp bạn dễ dàng hơn bằng cách tổng hợp các rủi ro bảo mật phổ biến nhất của chatbot và cung cấp thông tin về cách phòng tránh từng rủi ro.

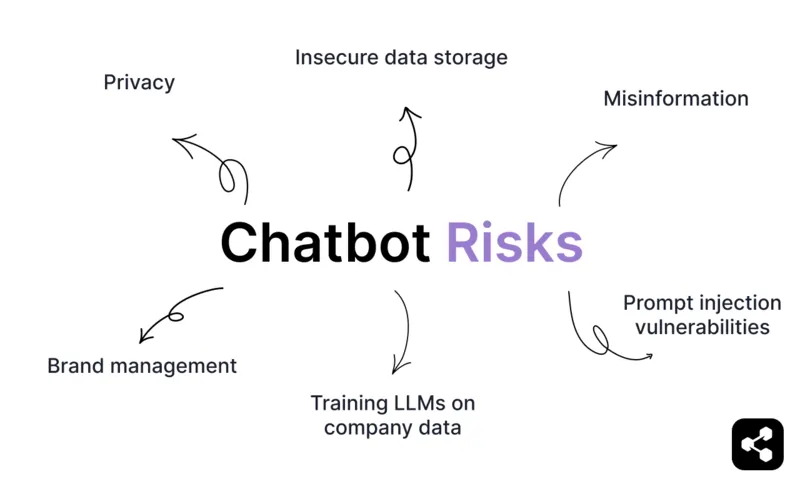

Các rủi ro của Chatbot

Quyền riêng tư & Thông tin bảo mật

Chatbot thường xử lý dữ liệu cá nhân như tên, địa chỉ email hoặc thông tin tài chính. Điều này có nghĩa chúng trở thành rủi ro về quyền riêng tư nếu xử lý dữ liệu nhạy cảm của người dùng mà không có biện pháp bảo vệ chắc chắn.

Điều này đặc biệt quan trọng với chatbot y tế, chatbot xử lý thanh toán, chatbot tài chính, chatbot ngân hàng hoặc bất kỳ chatbot doanh nghiệp nào xử lý dữ liệu nhạy cảm.

Nếu dữ liệu này được lưu trữ không an toàn hoặc truyền đi mà không mã hóa, nó sẽ dễ bị rò rỉ – khiến doanh nghiệp đối mặt với rủi ro pháp lý, tài chính và uy tín nghiêm trọng.

Thông tin sai lệch và ảo giác

Chatbot sử dụng LLM – nếu xây dựng không đúng cách – có nguy cơ lan truyền thông tin sai lệch.

Hãy lấy ví dụ về sự cố chatbot tai tiếng của Air Canada. Một hành khách được chatbot trên website của hãng thông báo rằng anh ấy có thể xin mức giá ưu đãi dành cho trường hợp có tang sau khi bà của mình qua đời.

Sau khi liên hệ để nhận hoàn tiền, khách hàng được thông báo chính sách chỉ áp dụng cho chuyến đi chưa hoàn thành. Công ty thừa nhận chatbot đã dùng 'từ ngữ gây hiểu lầm' và vụ việc đã phải đưa ra tòa.

Những kiểu ảo giác này không chỉ khiến thương hiệu xấu hổ – mà còn gây thiệt hại tài chính.

Tuy nhiên, hoàn toàn có thể xây dựng chatbot luôn trả lời đúng chủ đề và đúng phong cách thương hiệu. Một khách hàng của chúng tôi, nền tảng huấn luyện sức khỏe, đã giảm 65% số lượng yêu cầu hỗ trợ thủ công nhờ chatbot. Trong 100.000 cuộc hội thoại, công ty không ghi nhận trường hợp ảo giác nào.

Làm thế nào? Retrieval-augmented generation (RAG) đóng vai trò quan trọng trong hầu hết các chatbot doanh nghiệp. Thay vì tạo câu trả lời tự do, RAG kết hợp khả năng tạo nội dung của chatbot với cơ sở dữ liệu thông tin đã xác minh, luôn cập nhật. Điều này đảm bảo câu trả lời dựa trên thực tế, không phải phỏng đoán.

Chatbot doanh nghiệp còn có các biện pháp bảo vệ khác cần thiết trước khi triển khai công khai – chúng ta sẽ nói đến ở phần dưới.

Lưu trữ dữ liệu không an toàn

Nếu chatbot của bạn lưu trữ dữ liệu trên máy chủ hoặc môi trường đám mây, các giao thức bảo mật không đầy đủ có thể khiến dữ liệu bị lộ.

Phần mềm lỗi thời, máy chủ cấu hình sai hoặc dữ liệu không mã hóa có thể bị kẻ tấn công khai thác để truy cập thông tin nhạy cảm của người dùng.

Ví dụ, một số chatbot lưu trữ bản sao lưu dữ liệu mà không mã hóa đúng cách, khiến chúng dễ bị chặn khi truyền hoặc truy cập trái phép.

Lỗ hổng Prompt Injection & Đầu ra độc hại

Nếu bạn triển khai một chatbot yếu, nó có thể dễ bị ảnh hưởng bởi các prompt phá hoại.

Ví dụ, nếu chatbot của bạn hỗ trợ bán xe cho đại lý, bạn không muốn nó bán một chiếc xe tải với giá 1 đô la. (Xem sự cố Chevy Tahoe nổi tiếng.)

Chatbot có thể tạo ra các phản hồi gây hại hoặc vô nghĩa nếu đầu ra không được kiểm soát chặt chẽ. Những lỗi này có thể xuất phát từ việc thiếu biện pháp bảo vệ, thiếu kiểm tra xác thực hoặc bị người dùng thao túng.

Tuy nhiên, đây là một trong những rủi ro bảo mật dễ phòng tránh nhất. Chatbot mạnh sẽ sử dụng biện pháp bảo vệ hội thoại để ngăn chặn các cuộc trò chuyện lệch chủ đề hoặc sai phong cách thương hiệu ngay từ đầu.

Huấn luyện LLM bằng dữ liệu công ty

Huấn luyện chatbot bằng dữ liệu công ty có thể gây ra rủi ro về quyền riêng tư và bảo mật, đặc biệt với các nền tảng đa năng như ChatGPT. Khi sử dụng thông tin công ty với các chatbot đa năng, luôn tồn tại nguy cơ rò rỉ dữ liệu.

Ngược lại, chatbot tùy chỉnh giúp bảo vệ dữ liệu dễ dàng hơn nhiều. Các nền tảng chatbot dành cho doanh nghiệp thường được thiết kế với mục tiêu cách ly và bảo mật dữ liệu. Những chatbot này được huấn luyện trong môi trường kiểm soát, giảm đáng kể nguy cơ rò rỉ dữ liệu.

Quản lý thương hiệu

Những sự cố chatbot lớn nhất đều liên quan đến quản lý thương hiệu. Chatbot của bạn đại diện cho thương hiệu tốt đến đâu? Đây là trọng tâm của bảo mật chatbot.

Chatbot thường là điểm tiếp xúc đầu tiên của khách hàng với doanh nghiệp bạn, và nếu phản hồi của chúng không chính xác, không phù hợp hoặc sai tông, chúng có thể làm tổn hại đến uy tín thương hiệu.

Một lần nữa, đây là rủi ro có thể tránh được nhờ các biện pháp bảo vệ hội thoại và thiết kế hội thoại.

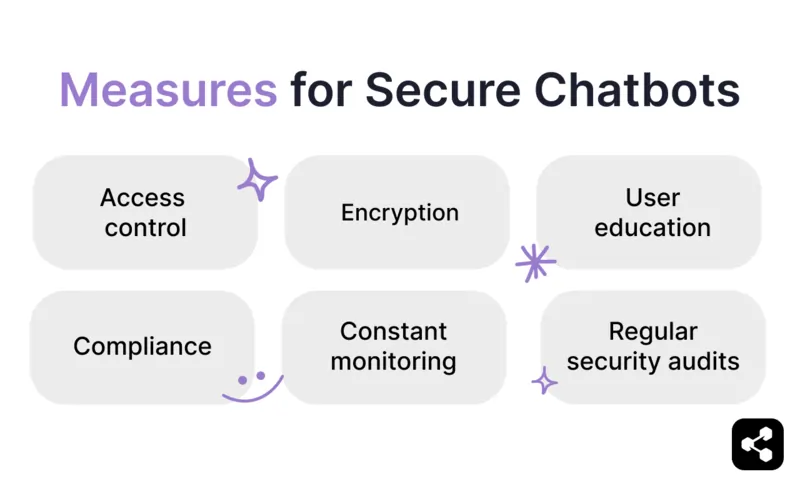

Các biện pháp an toàn cần thiết cho chatbot an toàn

Kiểm soát truy cập & Truy cập người dùng an toàn

Nếu đây là một công cụ được nhiều người sử dụng, bạn không muốn ai cũng có cùng mức truy cập.

Xác thực giúp xác minh danh tính người dùng — đảm bảo chỉ người dùng hợp lệ mới đăng nhập được. Sau khi xác thực, phân quyền xác định mỗi người dùng được phép làm gì, dựa trên vai trò hoặc quyền hạn của họ.

Một phần quan trọng là kiểm soát truy cập dựa trên vai trò (RBAC), đảm bảo người dùng chỉ truy cập thông tin và tính năng cần thiết cho công việc của họ. Điều này có nghĩa là:

- Chỉ cho phép nhân sự được ủy quyền truy cập dữ liệu nhạy cảm.

- Chỉ cho phép quản trị viên chỉnh sửa chatbot.

- Xác định vai trò người dùng với quyền hạn rõ ràng, có thể thực thi.

Bằng cách triển khai RBAC cùng các giao thức xác thực và phân quyền an toàn, bạn có thể giảm thiểu rủi ro như truy cập trái phép, rò rỉ dữ liệu và sử dụng sai mục đích. Đây là biện pháp bảo vệ đơn giản nhưng thiết yếu khi triển khai chatbot an toàn.

Kiểm tra bảo mật định kỳ

Giống như bất kỳ phần mềm hiệu suất cao nào khác, phần mềm chatbot cũng cần được kiểm tra bảo mật định kỳ.

Kiểm tra bảo mật định kỳ là quá trình rà soát toàn diện kiến trúc, cấu hình và quy trình của chatbot để đảm bảo đáp ứng các tiêu chuẩn bảo mật và thực hành tốt nhất trong ngành.

Các kiểm tra này thường bao gồm việc kiểm tra lỗ hổng – như giao thức xác thực yếu, máy chủ cấu hình sai hoặc API bị lộ – cũng như đánh giá hiệu quả của các biện pháp bảo mật hiện có như mã hóa và kiểm soát truy cập.

Kiểm tra cũng đánh giá mức độ tuân thủ các quy định bảo vệ dữ liệu, đảm bảo chatbot của bạn tuân thủ các khung pháp lý như GDPR hoặc SOC 2.

Quy trình này thường bao gồm:

- Kiểm thử xâm nhập để mô phỏng các cuộc tấn công tiềm ẩn

- Rà soát mã nguồn để phát hiện lỗi tiềm ẩn

- Giám sát các hoạt động bất thường

Kiểm tra bảo mật là biện pháp chủ động để đánh giá khả năng chống chịu của chatbot trước các mối đe dọa và xác minh khả năng xử lý thông tin nhạy cảm một cách an toàn.

Mã hóa

Mã hóa là quá trình chuyển đổi dữ liệu sang định dạng an toàn để ngăn chặn truy cập trái phép. Đối với dữ liệu nhạy cảm, có hai loại chính: mã hóa dữ liệu khi lưu trữ, bảo vệ thông tin đã lưu, và mã hóa dữ liệu khi truyền tải, bảo vệ dữ liệu trong quá trình truyền đi.

Sử dụng các giao thức mã hóa mạnh như AES (Tiêu chuẩn Mã hóa Nâng cao) đảm bảo rằng ngay cả khi dữ liệu bị chặn, nó vẫn không thể đọc được.

Đối với chatbot xử lý thông tin nhạy cảm, mã hóa là biện pháp bắt buộc để bảo vệ quyền riêng tư của người dùng và tuân thủ các tiêu chuẩn bảo mật.

Giám sát liên tục

Nền tảng Dịch vụ của chúng tôi đề xuất 3 giai đoạn triển khai chatbot: xây dựng, triển khai và giám sát liên tục.

Khách hàng thường quên giai đoạn cuối cùng khi lập kế hoạch ban đầu, nhưng giám sát lại là bước quan trọng nhất.

Điều này bao gồm:

- Theo dõi các chỉ số hiệu suất

- Phát hiện các lỗ hổng

- Xử lý các vấn đề như ảo giác hoặc rò rỉ dữ liệu

Cập nhật và kiểm tra thường xuyên giúp chatbot của bạn thích ứng với các mối đe dọa mới và duy trì tuân thủ các quy định ngành.

Nếu không được giám sát đúng cách, ngay cả chatbot được xây dựng tốt nhất cũng có thể trở thành rủi ro theo thời gian.

Tuân thủ

Nếu chatbot của bạn sẽ xử lý dữ liệu nhạy cảm, bạn cần chọn nền tảng đáp ứng các khung tuân thủ quan trọng.

Các khung tuân thủ phổ biến và liên quan nhất bao gồm:

- GDPR: Quy định Bảo vệ Dữ liệu Chung

- CCPA: Đạo luật Quyền riêng tư Người tiêu dùng California

- HIPAA: Đạo luật Di động và Trách nhiệm Giải trình Bảo hiểm Y tế

- SOC 2: Kiểm soát Hệ thống và Tổ chức 2

Nếu bạn sẽ xử lý dữ liệu của cá nhân tại EU, bạn cần có một chatbot tuân thủ GDPR.

Để tuân thủ đầy đủ, bạn cần a) một nền tảng thực hiện đúng các biện pháp tuân thủ và b) một số thao tác từ phía người xây dựng chatbot (như cách bạn xử lý dữ liệu sau khi chatbot nhận được).

Đào tạo người dùng

Đôi khi vấn đề không nằm ở công nghệ mà là do người dùng chưa hiểu rõ.

Một phần quan trọng khi triển khai công nghệ chatbot là chuẩn bị kỹ lưỡng cho nhân viên về các rủi ro và thách thức mới (bên cạnh nhiều lợi ích).

Hãy hướng dẫn nhân viên cách tích hợp chatbot vào công việc mà không gây rủi ro cho uy tín công ty. Lý tưởng nhất, chatbot của bạn sẽ được xây dựng với các biện pháp bảo vệ đủ mạnh để gần như không thể bị lạm dụng.

Triển khai chatbot an toàn nhất trên thị trường

Bảo mật nên là ưu tiên hàng đầu khi đầu tư vào chatbot cho công ty bạn.

Botpress là nền tảng AI agent và chatbot được 35% các công ty Fortune 500 sử dụng. Bộ giải pháp bảo mật tiên tiến của chúng tôi cho phép kiểm soát tối đa các công cụ AI của bạn.

Cổng LLM riêng, lá chắn bảo mật, agent an toàn tích hợp và khung bảo vệ thương hiệu của chúng tôi đảm bảo khách hàng có trải nghiệm chatbot an toàn nhất trên thị trường.

Bắt đầu xây dựng ngay hôm nay. Miễn phí.

Hoặc đặt lịch hẹn với đội ngũ của chúng tôi để bắt đầu.

Câu hỏi thường gặp

1. Chatbot lưu trữ dữ liệu như thế nào?

Chatbot lưu trữ dữ liệu trong các cơ sở dữ liệu an toàn – thường là trên nền tảng đám mây – sử dụng mã hóa cả khi lưu trữ và khi truyền tải. Dữ liệu lưu trữ có thể bao gồm nhật ký hội thoại và siêu dữ liệu, thường được cấu trúc để hỗ trợ cá nhân hóa hoặc tuân thủ quy định.

2. Làm thế nào để đảm bảo chatbot an toàn?

Để đảm bảo chatbot an toàn, hãy triển khai HTTPS cho mọi giao tiếp, mã hóa dữ liệu lưu trữ, xác thực các cuộc gọi API và giới hạn truy cập bằng phân quyền vai trò. Bạn cũng nên kiểm tra hệ thống thường xuyên và tuân thủ các luật bảo mật dữ liệu như GDPR hoặc HIPAA.

3. An toàn chatbot là gì?

An toàn chatbot là tập hợp các biện pháp bảo vệ người dùng và hệ thống khỏi các rủi ro như rò rỉ dữ liệu, thông tin sai lệch, tấn công lừa đảo xã hội hoặc tương tác lạm dụng. Điều này bao gồm áp dụng bộ lọc nội dung, bảo mật kênh dữ liệu, xác thực đầu vào và cho phép chuyển sang người thật khi cần thiết.

4. Chatbot nào an toàn nhất?

Chatbot an toàn nhất là chatbot được triển khai với mã hóa đầu-cuối, kiểm soát truy cập nghiêm ngặt, tùy chọn triển khai tại chỗ hoặc đám mây riêng, và tuân thủ các chứng nhận như SOC 2, ISO 27001 hoặc HIPAA.