La IA está en boca de todos. Y siempre surge la pregunta: ¿qué tan seguro es esta nueva herramienta de IA?

Si estás pensando en implementar un chatbot para una empresa, la seguridad del chatbot debe ser una prioridad.

En este artículo, te explicaré los principales riesgos de seguridad de los chatbots y las precauciones que tu organización debe tomar al implementar un chatbot de IA o un agente de IA.

¿Son seguros los chatbots?

No todos los chatbots son seguros; nunca sabes qué medidas de seguridad se aplicaron en su desarrollo. Sin embargo, es posible crear y desplegar un chatbot seguro con las herramientas adecuadas.

La seguridad de los chatbots es un tema amplio, ya que existen muchas formas de construir chatbots o agentes de IA, así como infinidad de casos de uso. Cada diferencia implica un aspecto de seguridad único que debes considerar.

¿Qué puedo hacer para evitar los riesgos de los chatbots?

La seguridad es una parte importante de tu proyecto de chatbot; tu estrategia de seguridad no puede ser improvisada.

Si no tienes suficiente experiencia, busca la ayuda de un experto. La mayoría de las organizaciones que crean y lanzan chatbots cuentan con el apoyo de socios de IA: empresas especializadas en proyectos de IA. Si vas a crear un chatbot, puedes consultar nuestra lista de expertos certificados, que incluye freelancers y agencias con experiencia en crear, desplegar y monitorear chatbots seguros.

De lo contrario, infórmate sobre los riesgos relevantes para tu chatbot y toma todas las medidas necesarias para evitar resultados no deseados.

Para facilitarte el trabajo, he recopilado los riesgos de seguridad más comunes en chatbots y te explico cómo enfrentarlos.

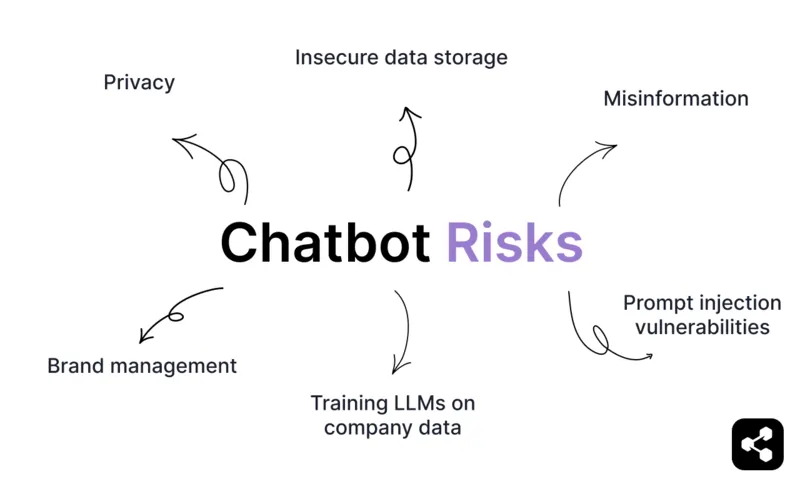

Riesgos de los chatbots

Privacidad e información confidencial

Los chatbots suelen manejar datos personales, como nombres, correos electrónicos o información financiera. Por eso, representan un riesgo de privacidad si gestionan datos sensibles sin protecciones sólidas.

Esto es especialmente importante en chatbots médicos, chatbots que procesan pagos, chatbots financieros, chatbots bancarios o cualquier chatbot empresarial que maneje datos sensibles.

Si estos datos se almacenan de forma insegura o se transmiten sin cifrado, quedan expuestos a brechas de seguridad, lo que puede generar riesgos legales, financieros y de reputación para las empresas.

Desinformación y alucinaciones

Los chatbots impulsados por LLM, si no están bien diseñados, pueden difundir información errónea.

Por ejemplo, el famoso caso del chatbot de Air Canada. Un pasajero recibió información de un chatbot en el sitio web de la compañía que le indicaba que podía solicitar tarifas por duelo tras el fallecimiento de su abuela.

Al solicitar el reembolso, le informaron que la política no aplicaba para viajes ya realizados. La empresa admitió que el chatbot había utilizado 'palabras engañosas' y el caso llegó a los tribunales.

Este tipo de alucinaciones no solo avergüenzan a las marcas, también les cuestan dinero.

Pero es posible crear chatbots que se mantengan en el tema y alineados con la marca. Uno de nuestros clientes, una plataforma de coaching de salud, logró reducir en un 65% los tickets de soporte manual con un chatbot. En sus 100,000 conversaciones, la empresa no detectó ninguna alucinación.

¿Cómo? La generación aumentada por recuperación (RAG) es clave en la mayoría de los chatbots empresariales. En lugar de generar respuestas libres, RAG combina la capacidad generativa del chatbot con una base de datos de información verificada y actualizada. Así, las respuestas se basan en hechos, no en suposiciones.

Los chatbots empresariales incluyen otras medidas de seguridad necesarias antes de su lanzamiento público; las veremos más adelante.

Almacenamiento de datos inseguro

Si tu chatbot almacena datos en servidores o en la nube, protocolos de seguridad inadecuados pueden dejarlo expuesto a brechas.

Software desactualizado, servidores mal configurados o datos sin cifrar pueden ser aprovechados por atacantes para acceder a información sensible de los usuarios.

Por ejemplo, algunos chatbots almacenan copias de seguridad de datos sin el cifrado adecuado, lo que los hace vulnerables a interceptaciones durante la transferencia o accesos no autorizados.

Vulnerabilidades de inyección de prompts y salidas maliciosas

Si lanzas un chatbot débil, puede ser susceptible a prompts destructivos.

Por ejemplo, si tu chatbot ayuda a vender vehículos en tu concesionario, no querrás que venda una camioneta por 1 dólar. (Ver el famoso caso del Chevy Tahoe.)

Los chatbots pueden generar respuestas dañinas o sin sentido si no se controlan adecuadamente sus salidas. Estos errores pueden deberse a la falta de medidas de protección, ausencia de validaciones o manipulación por parte de los usuarios.

Sin embargo, este es uno de los riesgos de seguridad más fáciles de evitar. Los chatbots robustos utilizan medidas de protección en la conversación para evitar conversaciones fuera de tema o que no representen la marca antes de que ocurran.

Entrenamiento de LLMs con datos de la empresa

Entrenar chatbots con datos de la empresa puede suponer riesgos de privacidad y seguridad, especialmente en plataformas de uso general como ChatGPT. Al usar información de la empresa en chatbots generales, siempre existe el riesgo de filtración de datos.

En cambio, los chatbots personalizados facilitan mucho la protección de tus datos. Las plataformas de chatbots de nivel empresarial suelen estar diseñadas para aislar y proteger los datos. Estos chatbots se entrenan en entornos controlados, lo que reduce significativamente el riesgo de fugas de información.

Gestión de marca

Los mayores escándalos públicos de chatbots han girado en torno a la gestión de marca. ¿Qué tan bien representa tu chatbot a tu marca? Este es un aspecto clave de la seguridad de los chatbots.

Los chatbots suelen ser el primer punto de contacto de los clientes con tu empresa, y si sus respuestas son inexactas, inapropiadas o fuera de tono, pueden dañar la reputación de tu marca.

Nuevamente, este riesgo se puede evitar con medidas de protección en la conversación y un buen diseño conversacional.

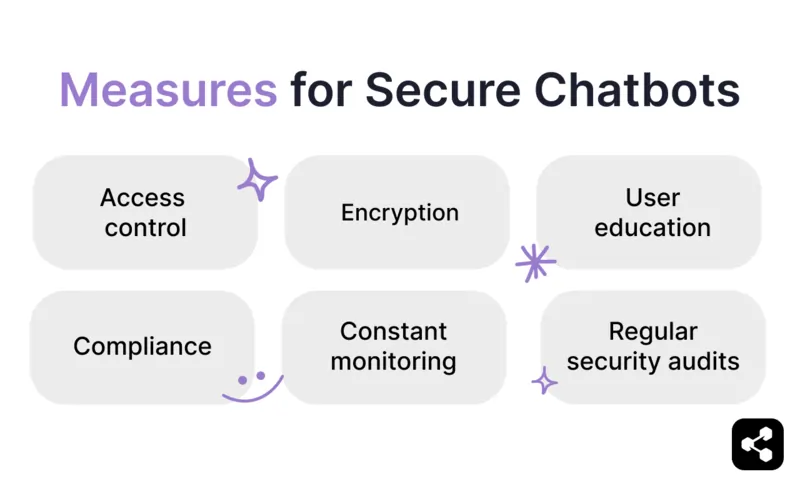

Medidas de seguridad necesarias para chatbots seguros

Control de acceso y acceso seguro de usuarios

Si es una herramienta de uso masivo, no siempre querrás que todos tengan el mismo nivel de acceso.

La autenticación verifica la identidad del usuario, asegurando que solo los usuarios legítimos puedan iniciar sesión. Una vez autenticado, la autorización determina qué puede hacer cada usuario según su rol o permisos.

Una parte clave de esto es el control de acceso basado en roles (RBAC), que garantiza que los usuarios solo accedan a la información y funciones necesarias para su trabajo. Esto implica:

- Limitar el acceso a datos sensibles solo al personal autorizado.

- Restringir la edición del chatbot solo a los administradores.

- Definir roles de usuario con permisos claros y aplicables.

Al implementar RBAC junto con protocolos seguros de autenticación y autorización, puedes minimizar riesgos como accesos no autorizados, filtraciones de datos y usos indebidos accidentales. Es una medida sencilla pero esencial para el despliegue seguro de chatbots.

Auditorías de seguridad periódicas

Como cualquier otro software de alto rendimiento, el software de chatbots debe someterse a auditorías de seguridad periódicas.

Las auditorías de seguridad periódicas son revisiones completas de la arquitectura, configuraciones y procesos de tu chatbot para asegurar que cumplen con los estándares de seguridad y las mejores prácticas del sector.

Estas auditorías suelen incluir pruebas de vulnerabilidades, como protocolos de autenticación débiles, servidores mal configurados o APIs expuestas, además de evaluar la eficacia de las medidas de seguridad existentes como el cifrado y los controles de acceso.

Las auditorías también verifican el cumplimiento de normativas de protección de datos, asegurando que tu chatbot respete marcos como GDPR o SOC 2.

Este proceso suele incluir:

- Pruebas de penetración para simular posibles ataques

- Revisiones de código para detectar fallos ocultos

- Monitoreo de actividades inusuales

Las auditorías de seguridad son una medida proactiva para evaluar la resistencia de tu chatbot frente a amenazas y comprobar su capacidad para manejar información sensible de forma segura.

Cifrado

El cifrado es el proceso de convertir datos en un formato seguro para evitar accesos no autorizados. Para datos sensibles, esto incluye dos tipos principales: cifrado de datos en reposo, que protege la información almacenada, y cifrado de datos en tránsito, que protege los datos mientras se transmiten.

El uso de protocolos de cifrado robustos como AES (Estándar de Cifrado Avanzado) garantiza que, incluso si los datos son interceptados, permanezcan ilegibles.

Para los chatbots que manejan información sensible, el cifrado es una medida imprescindible para proteger la privacidad de los usuarios y cumplir con los estándares de seguridad.

Supervisión constante

Nuestra plataforma como servicio sugiere 3 etapas para la implementación de chatbots: creación, despliegue y monitoreo.

Los clientes suelen olvidar la última etapa al planificar inicialmente, pero el monitoreo es el paso más importante de todos.

Esto incluye:

- Seguimiento de métricas de rendimiento

- Identificación de vulnerabilidades

- Resolución de problemas como alucinaciones o filtraciones de datos

Las actualizaciones y pruebas periódicas ayudan a asegurar que tu chatbot se adapte a nuevas amenazas y siga cumpliendo con las regulaciones del sector.

Sin un monitoreo adecuado, incluso el chatbot mejor construido puede convertirse en un riesgo con el tiempo.

Cumplimiento

Si tu chatbot va a manejar datos sensibles, debes elegir una plataforma que cumpla con los principales marcos de cumplimiento.

Los marcos de cumplimiento más comunes y relevantes incluyen:

- GDPR: Reglamento General de Protección de Datos

- CCPA: Ley de Privacidad del Consumidor de California

- HIPAA: Ley de Portabilidad y Responsabilidad de Seguros de Salud

- SOC 2: Controles de Sistemas y Organizaciones 2

Si vas a procesar datos de personas en la UE, necesitarás un chatbot que cumpla con GDPR.

Para cumplir completamente, se requiere tanto a) una plataforma que siga las medidas de cumplimiento adecuadas como b) ciertas acciones por parte de los creadores del chatbot (como la gestión de los datos una vez recibidos por el chatbot).

Formación de usuarios

A veces, el problema no es la tecnología, sino la falta de comprensión de los usuarios.

Una parte fundamental de la implementación de la tecnología de chatbots es preparar adecuadamente a tus empleados para los nuevos riesgos y desafíos (junto con la gran cantidad de beneficios).

Forma a tus empleados sobre cómo incorporar el chatbot en su trabajo sin poner en riesgo la reputación de la empresa. Lo ideal es que tu chatbot cuente con suficientes medidas de protección para que sea prácticamente imposible hacer un mal uso de él.

Despliega el chatbot más seguro del mercado

La seguridad debe ser una prioridad en la inversión de tu empresa en chatbots.

Botpress es una plataforma de agentes de IA y chatbots utilizada por el 35% de las empresas Fortune 500. Nuestra suite de seguridad de última generación permite el máximo control sobre tus herramientas de IA.

Nuestra pasarela privada LLM, escudo de privacidad, agente de seguridad integrado y marco de protección de marca garantizan que nuestros clientes disfruten de la experiencia de chatbot más segura del mercado.

Empieza a construir hoy. Es gratis.

O agenda una llamada con nuestro equipo para comenzar.

Preguntas frecuentes

1. ¿Cómo almacenan datos los chatbots?

Los chatbots almacenan datos en bases de datos seguras, normalmente en la nube, utilizando cifrado tanto en reposo como en tránsito. Los datos almacenados pueden incluir registros de conversaciones y metadatos, y suelen estructurarse para permitir la personalización o el cumplimiento normativo.

2. ¿Cómo puedo asegurar un chatbot?

Para un chatbot seguro, implementa HTTPS en todas las comunicaciones, cifra los datos almacenados, autentica las llamadas a la API y restringe el acceso mediante permisos basados en roles. También debes auditar el sistema regularmente y cumplir con leyes de privacidad de datos como GDPR o HIPAA.

3. ¿Qué es la seguridad en chatbots?

La seguridad en chatbots es el conjunto de prácticas que protegen a usuarios y sistemas frente a riesgos como filtraciones de datos, desinformación, ataques de ingeniería social o interacciones abusivas. Incluye la aplicación de filtros de contenido, la protección de los canales de datos, la validación de entradas y la posibilidad de recurrir a intervención humana cuando sea necesario.

4. ¿Cuál es el chatbot más seguro?

El chatbot más seguro es aquel que se despliega con cifrado de extremo a extremo, controles de acceso estrictos, opciones de nube privada o local, y que cumple con certificaciones como SOC 2, ISO 27001 o HIPAA.