- Chain-of-thought prompting ช่วยให้ AI คิดเป็นขั้นตอนทีละลำดับ ทำให้แก้ปัญหาซับซ้อนได้แม่นยำกว่าการเดาคำถัดไปเพียงอย่างเดียว

- เหมาะกับปัญหาหลายขั้นตอน เช่น คณิตศาสตร์ ปริศนาเชิงตรรกะ หรือกระบวนการที่มีขั้นตอน แต่ไม่จำเป็นสำหรับคำถามข้อเท็จจริงหรือคำถามที่ตอบได้ในขั้นตอนเดียว

- Prompt chaining แตกต่างจาก chain-of-thought ตรงที่แบ่งงานออกเป็นหลาย prompt แยกกัน ในขณะที่ chain-of-thought จะอยู่ใน prompt เดียวและตอบต่อเนื่อง

ถ้าคุณเคยใช้ GPT แชทบอท อย่าง ChatGPT คุณคงสังเกตได้ว่าคุณภาพของผลลัพธ์แตกต่างกันมาก

บางครั้งมันก็ให้คำตอบที่คุณต้องการเป๊ะ ๆ แต่บางครั้งคุณก็อดสงสัยไม่ได้ว่า ‘ความฉลาด’ ใน AI นั้นอาจจะเกินจริงไปหน่อย

คุณสามารถยกระดับการใช้ ChatGPT ได้ด้วยการปรับวิธีการตั้งคำถาม Chain-of-thought prompting กระตุ้นให้ LLM agents คิดทีละขั้นตอน ก่อนจะตอบกลับ

โมเดล AI และฟีเจอร์ใหม่ ๆ เริ่มนำ chain-of-thought reasoning มาใช้โดยตรง ทำให้โมเดลคิดแก้ปัญหาเป็นขั้นตอนโดยอัตโนมัติโดยไม่ต้องมีพรอมต์เพิ่ม

Chain-of-thought prompting คืออะไร?

Chain-of-thought prompting คือเทคนิคการออกแบบพรอมต์ใน AI ที่สั่งให้โมเดลแยกงานซับซ้อนเป็นขั้นตอน และให้เหตุผลทีละขั้นก่อนตอบกลับ

คุณอาจได้ยินคำว่า ‘chain-of-thought reasoning’ ด้วย หมายถึงกระบวนการทีละขั้นที่โมเดลจะใช้ในการคิดแก้ปัญหาต่าง ๆ

โมเดล OpenAI o1 ไม่ต้องใช้ chain-of-thought prompting เพราะมีเหตุผลแบบ chain-of-thought อยู่แล้ว แต่คุณก็ยังใช้ chain-of-thought prompting กับแชทบอทที่ขับเคลื่อนด้วย LLM ได้

การให้เหตุผลแบบ chain-of-thought ทำงานอย่างไร?

การให้เหตุผลแบบ Chain-of-thought คือการแบ่งปัญหาออกเป็นขั้นตอนย่อย ๆ ที่มีเหตุผล เพื่อให้ AI chatbot แก้ไขทีละลำดับ

ขั้นแรก AI จะระบุส่วนสำคัญของปัญหา จากนั้นจะประมวลผลแต่ละส่วนตามลำดับ โดยพิจารณาว่าขั้นตอนไหนนำไปสู่ขั้นตอนถัดไป ทุกขั้นตอนจะต่อยอดจากขั้นก่อนหน้า ทำให้ AI เดินหน้าสู่ข้อสรุปอย่างมีเหตุผล

ตัวอย่างของ chain-of-thought prompting

‘strawberry’ prompt อันโด่งดัง

ChatGPT และ LLM อื่น ๆ มีจุดอ่อนที่เป็นที่รู้จักดี หนึ่งในนั้นคือไม่สามารถบอกจำนวน 'R' ในคำว่า ‘strawberry’ ได้ถูกต้อง (ซึ่งน่าจะเป็นที่มาของชื่อรุ่น o1: Strawberry)

ChatGPT-4o ไม่ใช้เหตุผลแบบ chain-of-thought แต่จะอ้างอิงข้อมูลที่ฝึกมาและสร้างคำตอบตามความน่าจะเป็นของแต่ละคำ แม้จะฟังดูถูกต้องบ่อยครั้ง แต่มันแค่เลียนแบบภาษามนุษย์ ไม่ได้ใช้เหตุผลหรือค้นคว้าจริง

เมื่อคุณถาม ChatGPT-4o ด้วยคำถามสตรอว์เบอร์รี่ที่โด่งดัง มันไม่สามารถให้คำตอบที่ถูกต้องได้:

อย่างไรก็ตาม คุณสามารถใช้เทคนิคการกระตุ้นแบบลำดับความคิดเพื่อช่วยให้แชทบอทที่ขับเคลื่อนด้วย LLM หาคำตอบที่ถูกต้องได้

เวอร์ชันล่าสุดของ ChatGPT ที่ขับเคลื่อนด้วย OpenAI o1-preview เป็น LLM ตัวแรกที่ใช้การให้เหตุผลแบบ chain-of-thought ได้โดยไม่ต้องมีพรอมต์เพิ่มเติม

มันตอบถูกตั้งแต่ครั้งแรก เพราะถูกสั่งให้ทำตามขั้นตอนเดียวกับพรอมต์ที่สองของ ChatGPT-4o ข้างบน ความแตกต่างเดียวคือมันทำขั้นตอนนี้โดยอัตโนมัติโดยไม่ต้องมีพรอมต์เพิ่ม

คณิตศาสตร์

ถ้าคุณถาม ChatGPT เวอร์ชันเก่าคำถามคณิตศาสตร์จากหนังสือเรียนประถม มันอาจจะตอบผิดได้

โจทย์คณิตศาสตร์หลายขั้นตอนต้องใช้การให้เหตุผล ซึ่ง LLM รุ่นก่อนยังไม่มี คุณอาจจะแบ่งโจทย์เป็นแต่ละขั้นได้ แต่ถ้าไม่รู้ขั้นตอนที่ถูกต้อง LLM ก็ช่วยไม่ได้

ChatGPT-4o สามารถใช้เหตุผลเพื่อหาคำตอบของคำถามนี้ได้โดยแยกขั้นตอนของปัญหาออกมา

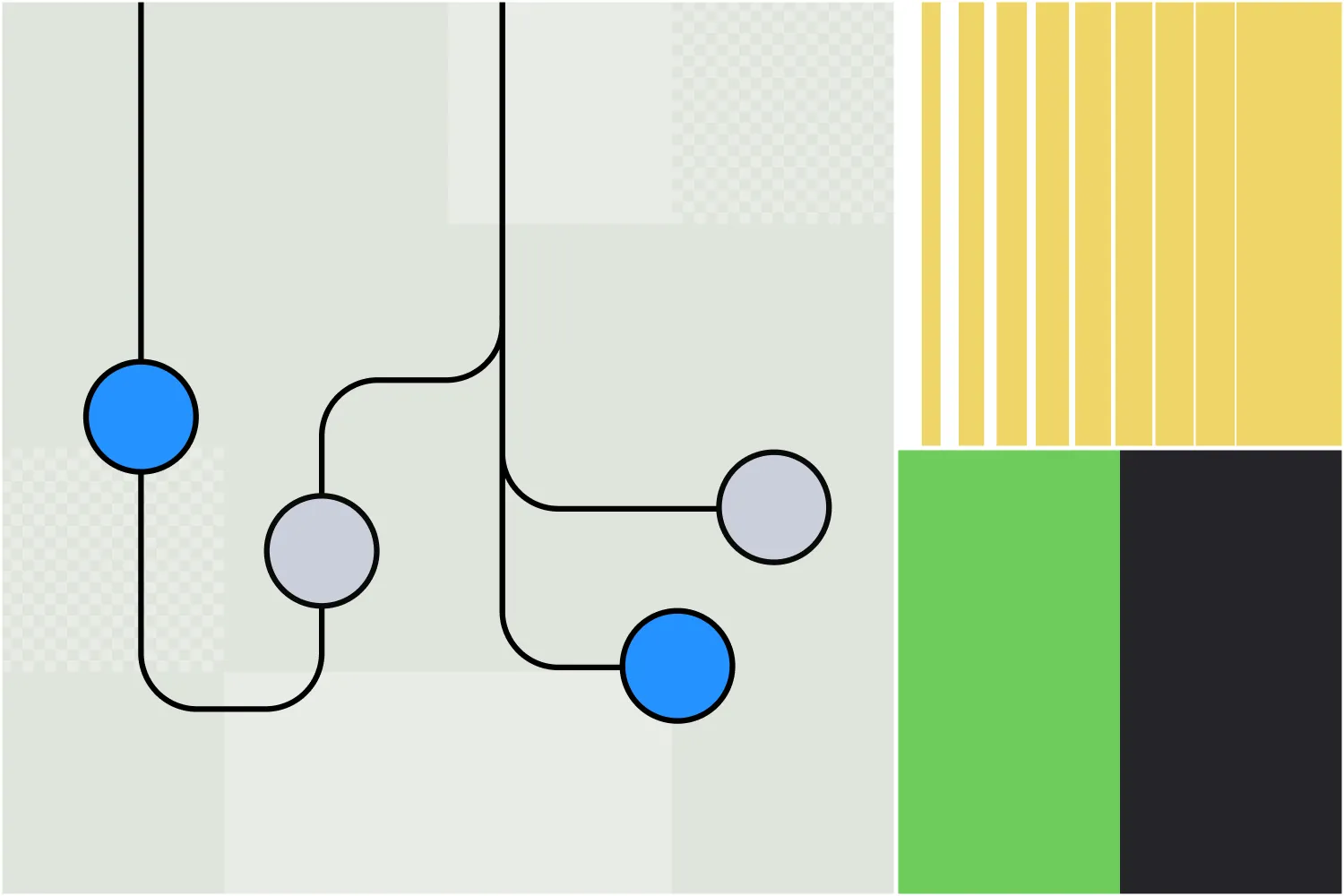

AI Agents ที่เชื่อมต่อกับ Hubspot

สำหรับตัวอย่างการใช้งานจริง ลองดู AI agent ที่ขับเคลื่อนด้วย LLM ซึ่งเชื่อมต่อกับ Hubspot ทีมขายใช้ AI agent นี้เพื่อจัดการลีดใหม่ที่เข้ามาจากหลายช่องทาง

สถานการณ์

เซลส์ส่งลีดใหม่ให้เอเจนต์ AI และขอให้ลงทะเบียนใน Hubspot พร้อมส่งอีเมลติดต่อครั้งแรก แต่ไม่ต้องกรอกถ้าลีดนั้นทำงานในบริษัทที่เป็นลูกค้าเป้าหมายอยู่แล้ว

LLM ที่ไม่มีการให้เหตุผลแบบ chain-of-thought

เอเจนต์ AI ที่ขับเคลื่อนด้วย LLM จะลงทะเบียนลีดและส่งอีเมลโดยไม่ตรวจสอบว่าบริษัทนั้นเป็นลูกค้าเป้าหมายอยู่แล้วหรือไม่ ซึ่งทำให้พลาดเงื่อนไขสำคัญไป

LLM ที่มีเหตุผลแบบ chain-of-thought

AI agent ที่ขับเคลื่อนด้วย LLM จะตรวจสอบว่าบริษัทนั้นเป็นลูกค้าเป้าหมายอยู่แล้วหรือไม่ ถ้าใช่ จะข้ามขั้นตอนการลงทะเบียนและส่งอีเมล ถ้าไม่ใช่ จะลงทะเบียนลีดและส่งอีเมลตามคำแนะนำของเซลส์อย่างถูกต้อง

ควรใช้ chain of thought prompting เมื่อไร?

Chain-of-thought prompting เหมาะกับสถานการณ์ที่ต้องใช้เหตุผลทีละขั้นตอน

งานที่เหมาะสมคือ งานที่ต้องใช้ตรรกะ คำนวณเลข งานตามขั้นตอน หรือสถานการณ์ที่ต้องตอบหลายขั้นตอน

แต่เดี๋ยวก่อน: การให้เหตุผลฟังดูดี—แล้วทำไมไม่ใช้ตลอดเวลา?

เป็นคำถามที่ดี ไม่ใช่ทุกคำถามที่ต้องใช้เหตุผล ตัวอย่างเช่น:

- คำถามข้อเท็จจริงง่าย ๆ เช่น ‘เมืองหลวงของแคนาดาคืออะไร?’

- ปัญหาแบบขั้นตอนเดียว เช่น ‘145 + 37 เท่ากับเท่าไร?’

- งานสร้างเนื้อหา เช่น 'เขียนอีเมลสุภาพ 3 ประโยคเพื่อถามเพื่อนร่วมงานว่างานเสร็จหรือยัง'

การเปลี่ยนแปลง prompt กับการใช้ chain-of-thought prompting

แม้ชื่อจะคล้ายกัน แต่ prompt chaining และ chain-of-thought prompting เป็นกลยุทธ์การตั้งคำสั่งที่ต่างกันเพื่อปรับปรุงผลลัพธ์ของ AI เชิงสร้างสรรค์

Chain-of-thought prompting

ด้วย chain-of-thought prompting ผู้ใช้จะชี้นำให้ AI อธิบายเหตุผลเบื้องหลังคำตอบในข้อความเดียว ซึ่งจะกระตุ้นให้ AI เดินผ่านแต่ละขั้นตอนของกระบวนการแก้ปัญหา แต่ทั้งหมดนี้เกิดขึ้นใน prompt และคำตอบเดียว

ตัวอย่างเช่น chain-of-thought prompt สามารถทำได้ในข้อความเดียว:

"ทีม HR ต้องตรวจสอบการประเมินผลงานพนักงาน 5 คน ใช้เวลาคนละ 30 นาที และต้องเตรียมตัวล่วงหน้า 15 นาที การประเมินระดับอาวุโสใช้เวลาเพิ่มอีก 10 นาทีต่อคน จะใช้เวลาทั้งหมดเท่าไรหากต้องประเมินอาวุโส 5 คนและจูเนียร์ 25 คน? กรุณาอธิบายเหตุผลทีละขั้น"

Prompt chaining

สำหรับ prompt chaining งานจะถูกแบ่งเป็นหลายขั้นตอน โดยแต่ละ prompt จะต่อยอดจากผลลัพธ์ก่อนหน้า ช่วยจัดโครงสร้างและนำทาง AI ให้ทำงานซับซ้อนที่ต้องใช้เหตุผล

Prompt แรกอาจเป็นแบบนี้:

Prompt 1: ระบุความท้าทายหลักที่บริษัทอาจเจอเมื่อเปลี่ยนไปทำงานแบบรีโมท

ผลลัพธ์:

- ช่องว่างในการสื่อสาร

- การรักษาประสิทธิภาพการทำงาน

- โครงสร้างพื้นฐานด้านเทคโนโลยี

- การมีส่วนร่วมของพนักงาน

Prompt ถัดไปอาจเจาะลึกในแต่ละประเด็น เช่น:

พรอมต์ 2: กรุณาบอกวิธีที่บริษัทจะหาทางแก้ไขช่องว่างในการสื่อสารเมื่อต้องเปลี่ยนไปทำงานทางไกล

หลังจากได้ผลลัพธ์รอบถัดไป prompt ถัดไปใน chain อาจเป็น:

Prompt 3: ความท้าทายที่บริษัทมักเจอเมื่อใช้โซลูชันเหล่านี้คืออะไรบ้าง?

ดังนั้น แม้ทั้งสองจะคล้ายกัน แต่แนวทางการดึงเนื้อหาลึกและเกี่ยวข้องจาก generative AI จะต่างกัน

Chain-of-thought prompting บน Botpress

ผู้ใช้ Botpress คุ้นเคยกับฟีเจอร์ที่ใช้การให้เหตุผลแบบ chain-of-thought อยู่แล้ว

Autonomous Node เปิดตัวครั้งแรกในเดือนกรกฎาคม 2024 บน Botpress ซึ่งเป็นแพลตฟอร์มสำหรับสร้าง AI agent โดย Autonomous Node สามารถทำงานเวิร์กโฟลว์หลายขั้นตอนและตัดสินใจได้โดยอัตโนมัติ

คุณสามารถสร้าง Autonomous Node ได้ง่าย ๆ ด้วยข้อความสั้น ๆ เช่น ‘หน้าที่ของคุณคือสร้างลีดที่มีคุณภาพ สร้างลีดใน Salesforce เมื่อผู้ใช้แสดงความสนใจจะซื้อ’

AI agent ที่คุณสร้างด้วย Autonomous Node นี้จะดำเนินการหลากหลายเพื่อบรรลุเป้าหมายได้เอง โดยไม่ต้องอาศัยเวิร์กโฟลว์ที่มนุษย์ออกแบบไว้ และยังสามารถสลับไปใช้ LLM ที่ต่างกันได้ตามความเหมาะสม เช่น เลือกความเร็วหรือประสิทธิภาพเป็นหลัก

สร้างเอเจนต์อัตโนมัติแบบกำหนดเอง

Botpress คือแพลตฟอร์ม AI agent เดียวที่ให้คุณสร้าง agent อัตโนมัติอย่างแท้จริง

Botpress Studio ที่เปิดกว้างและยืดหยุ่นรองรับการใช้งานหลากหลายอุตสาหกรรม ตั้งแต่ HR ถึงการสร้างลูกค้าใหม่ ด้วยไลบรารีอินทิเกรตสำเร็จรูปและคู่มือมากมาย ผู้ใช้สามารถสร้าง AI agent ได้เองอย่างง่ายดาย

หรือ ติดต่อทีมขายของเรา

คำถามที่พบบ่อย

1. การใช้ chain-of-thought prompting มีประโยชน์เฉพาะกับโมเดล AI หรือสะท้อนวิธีแก้ปัญหาของมนุษย์ด้วย?

Chain-of-thought prompting มีประโยชน์ทั้งกับโมเดล AI และสะท้อนวิธีแก้ปัญหาของมนุษย์ เพราะเลียนแบบการคิดทีละขั้นตอนในการแก้ปัญหาซับซ้อน

2. การใช้เหตุผลแบบ chain-of-thought แตกต่างจากการคิดทีละขั้นตอนอย่างไร?

แม้ว่า “คิดทีละขั้น” จะเป็นแนวทางทั่วไป แต่การให้เหตุผลแบบ chain-of-thought จะมีโครงสร้างและตั้งใจมากกว่า โดยกระตุ้นให้โมเดล AI อธิบายขั้นตอนการคิดกลางทางอย่างชัดเจน แทนที่จะข้ามไปที่ข้อสรุปทันที

3. ทำไม LLM บางตัวถึงไม่ได้ใช้การให้เหตุผลแบบลำดับความคิดโดยอัตโนมัติ?

LLM บางตัว โดยเฉพาะรุ่นเก่าหรือขนาดเล็ก มักไม่ใช้การให้เหตุผลแบบ chain-of-thought โดยอัตโนมัติ เพราะไม่ได้ถูกฝึกให้สร้างคำตอบหลายขั้นตอน แต่จะเน้นทายคำตอบที่น่าจะเป็นไปได้จากรูปแบบข้อมูลที่ฝึกมาแทน

4. การใช้ chain-of-thought prompting ถือเป็นการ “ฝึก” โมเดลระหว่างการประมวลผลหรือไม่?

ไม่ใช่, chain-of-thought prompting ไม่ใช่การฝึกโมเดล มันไม่เปลี่ยนน้ำหนักหรือความรู้ของโมเดล แต่เป็นการชี้นำพฤติกรรมการตอบของโมเดลขณะใช้งานจริง ด้วยการกระตุ้นให้เหตุผลอย่างมีโครงสร้างผ่าน prompt

5. chain-of-thought prompting ช่วยเพิ่มความแม่นยำเสมอไปหรือไม่?

Chain-of-thought prompting ไม่ได้ช่วยเพิ่มความแม่นยำเสมอไป มักจะเหมาะกับงานที่ต้องใช้เหตุผลหลายขั้นตอน แต่ถ้าเป็นงานง่าย ๆ อาจทำให้ซับซ้อนเกินจำเป็นและประสิทธิภาพลดลง