- Botpress offre prezzi trasparenti senza costi AI nascosti, così i tuoi costi AI riflettono solo l’uso reale.

- Memorizzare in cache le risposte dell’IA può ridurre i costi delle query di circa il 30% senza compromettere l’esperienza utente.

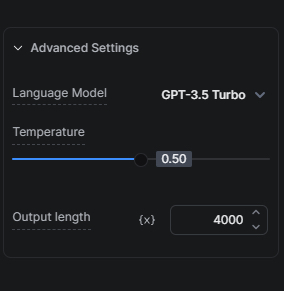

- Scegliere il modello IA giusto, ad esempio iniziando con GPT-3.5 Turbo invece di GPT-4, è fondamentale per bilanciare costi e qualità.

Molte aziende si trovano a dover sfruttare il potenziale dell’IA senza sforare il budget. Sappiamo quanto sia importante questo equilibrio e ci impegniamo a offrire soluzioni che consentano ai nostri utenti di sfruttare l’IA in modo conveniente.

Il nostro approccio ai costi dell’IA

Per prima cosa, è importante comprendere due componenti fondamentali di come riduciamo i costi legati all’AI per i nostri utenti, offrendo comunque tutti i vantaggi delle capacità AI.

Prezzi trasparenti: nessun costo nascosto

Non aggiungiamo alcun margine sulle attività legate all’AI. Questo significa che il costo AI Spend è direttamente collegato al tuo utilizzo effettivo, senza costi aggiuntivi da parte nostra.

Caching delle risposte AI

La cache è una delle strategie più efficaci per ridurre i costi AI dei bot. Memorizzando le risposte dell’IA, riduciamo il numero di richieste al fornitore LLM, abbattendo il costo delle query di circa il 30% e risparmiando senza compromettere la qualità delle interazioni tra il bot e gli utenti.

Consigli per ottimizzare i costi dell’AI

Ora che abbiamo visto due dei metodi che adottiamo per ridurre l’AI Spend dei nostri utenti, vediamo alcuni consigli che puoi seguire durante la creazione del tuo bot per abbassare ulteriormente i costi dell’IA.

Ottimizza le tue knowledge bases

Ottimizzare le tue Knowledge Base (KB) può influire notevolmente sulla tua AI Spend, dato che le KB sono spesso la principale voce di costo IA in un progetto Botpress.

Suggerimento 1: Scegli il modello IA giusto

La scelta di un modello AI incide notevolmente sui costi. Poiché GPT-3.5 Turbo è più veloce ed economico di GPT-4 Turbo, consigliamo di testare a fondo la tua configurazione con GPT-3.5 Turbo prima di valutare l’aggiornamento a versioni più avanzate.

La nostra modalità ibrida KB Agent offre un ottimo compromesso: inizialmente usiamo GPT-3.5 Turbo per rispondere a una richiesta e passiamo a GPT-4 Turbo solo se necessario.

Suggerimento 2: Proteggi la tua KB

Puoi ridurre la tua spesa AI proteggendo la tua KB dalle FAQ tipiche che non necessitano di AI o risposte intelligenti usando una scheda Trova Record. Funziona così: se sai che gli utenti fanno spesso una domanda e abbiamo 50 domande note con le loro risposte, possiamo aggiungerle a una tabella e interrogarla con una scheda Trova Record. Se non troviamo una risposta, solo allora cerchiamo nella KB.

Suggerimento 3: Definisci correttamente i tuoi KB

A seconda del tipo e della quantità di informazioni che vuoi aggiungere a una KB, di solito è buona pratica fare due cose in parallelo per ridurre i costi dell'AI. Primo, organizza le informazioni in KB più piccole, ognuna dedicata a un prodotto/funzione/argomento specifico. Secondo, guida l'utente attraverso un flusso con più domande per restringere la ricerca a una KB specifica; questo non solo ridurrà i costi, ma produrrà anche risultati migliori.

Suggerimento 4: Fonte dati KB del sito web vs Fonte dati KB Ricerca sul Web

Se utilizzi un sito web come fonte dati KB ma non apporti modifiche costanti che devono essere riflesse in tempo reale nel tuo bot, un’alternativa economica è usare la ricerca web come fonte KB invece della fonte KB Sito Web. Prima di effettuare questa transizione, assicurati di testare che le prestazioni sulle domande che prevedi non peggiorino con questo cambiamento.

Suggerimento 5: Interroga le Tabelle con la scheda Trova Record o Esegui Codice

Se hai una Tabella con dati da interrogare, considera di usare la scheda Trova Record invece di inserire la Tabella in una KB. Per chi ha competenze tecniche, eseguire codice può essere un metodo ancora più efficiente per interrogare una Tabella. Puoi farlo interrogando direttamente la Tabella dalla scheda Esegui Codice e salvando il risultato in una variabile del flusso da utilizzare successivamente.

Suggerimento 6: Controlla i blocchi di testo

Per chunk intendo il numero di porzioni che verranno recuperate dalla Knowledge Base per generare una risposta. In generale, più chunk vengono recuperati, più la risposta sarà accurata – ma ci vorrà più tempo e costerà più token IA. Sperimenta con la dimensione dei chunk per trovare la quantità minima che garantisce comunque risposte precise.

Usa la scheda Esegui codice per ridurre i costi dell’AI

La scheda Esegui Codice può essere una valida e conveniente alternativa ad alcune schede AI. Ecco alcuni scenari in cui puoi considerare di usarla:

Alternative più intelligenti ai messaggi

Se vuoi che il tuo bot invii una risposta IA diversa per la stessa domanda ogni volta, devi impedire la memorizzazione nella cache (vedi l’Appendice per sapere come fare). Ci sono scenari in cui l’aumento della spesa per l’IA può essere giustificato dal miglioramento dell’esperienza conversazionale. Ma non è sempre così.

Pensa a un semplice saluto generato con LLM. Ogni saluto comporta un costo aggiuntivo di AI Spend. Ne vale la pena? Probabilmente no. Fortunatamente, c’è una soluzione più economica: usa un array con più risposte e una semplice funzione per selezionarne una a caso e mostrarla.

A seconda del volume delle conversazioni, il risparmio ottenuto implementando questo metodo può valere lo sforzo.

Puoi trovare maggiori dettagli su come implementare messaggi alternativi qui.

Esecuzione di codice per compiti semplici

Per compiti semplici, come la riformattazione dei dati o l’estrazione di informazioni da dati strutturati, l’utilizzo della scheda Esegui Codice può essere più efficiente, economico e veloce rispetto all’affidarsi a un LLM.

Alternative all’agente di sintesi

Puoi usare le carte Execute Code per creare la tua trascrizione. Inserisci una carta Execute Code dove vuoi tracciare i messaggi di utenti e bot in una variabile array. Successivamente, puoi usare quell’array come contesto per la tua KB.

Semplifica quando possibile

Scegli il metodo di interazione più semplice che raggiunge lo stesso obiettivo senza peggiorare l’esperienza utente. Ad esempio, se vuoi raccogliere feedback dagli utenti, un semplice sistema di valutazione a stelle con commenti sarà più economico rispetto all’uso dell’IA per raccogliere le stesse informazioni.

Consigli per Attività AI, Generazione Testo AI e Traduzioni

Scegli il modello AI giusto

Sì, scegliere il modello AI giusto è così importante che vale la pena ripeterlo. Come per le KB, la scelta del modello AI incide notevolmente sui costi delle attività AI. Scegli GPT-3.5 Turbo per istruzioni meno complesse. Prima di passare a versioni più avanzate, testa a fondo la tua configurazione con questo modello. Ricorda che GPT-4 Turbo costa 20 volte più di GPT-3.5 Turbo. A meno che i risultati non siano nettamente migliori, scegli GPT–3.5 Turbo.

Oltre a quanto sopra, puoi anche risparmiare sull’uso dell’IA riducendo il numero di token consumati in ogni esecuzione di un’attività IA.

Il mio consiglio è di prestare attenzione a ridurre questo numero perché comporterà il troncamento di eventuali token aggiuntivi. Ad esempio, se limiti la lunghezza a 2000 token e il tuo prompt più l’output supera i 2000 token, il tuo input verrà troncato di conseguenza.

AI Task vs AI Genera Testo

Per semplici risposte testuali, la scheda AI Generate Text utilizza meno token ed è più facile da configurare rispetto alla scheda AI Task. Per attività che richiedono l'analisi di informazioni, la scheda AI Task offre prestazioni migliori rispetto ad AI Generate Text.

Pertanto, consiglio di usare la scheda AI Task quando vuoi che l’IA elabori informazioni (ad esempio per rilevare l’intenzione dell’utente o analizzare l’input). Se invece vuoi sfruttare l’IA per generare testo, usa la scheda AI Generate Text (ad esempio per espandere una risposta della KB o generare una domanda in modo creativo).

Per approfondire le differenze tra la scheda AI Task e la scheda AI Generate Text, scopri di più qui.

Traduzioni

Se il tuo bot dovrà gestire un elevato numero di conversazioni multilingue, valuta l’integrazione di hook con servizi di traduzione esterni per una soluzione più conveniente.

Puoi trovare ulteriori informazioni sugli hook qui.

Conclusione

Con queste strategie e suggerimenti, potrai ottimizzare la tua spesa AI in Botpress. Comprendere le implicazioni di costo delle diverse attività e scegliere i metodi più efficienti per le tue esigenze ridurrà le spese legate all'AI senza compromettere le prestazioni.

Il nostro team è qui per aiutarti a orientarti tra queste opzioni e garantire che il tuo bot offra la migliore esperienza possibile agli utenti al costo più efficiente. Visita la nostra pagina dei prezzi per maggiori informazioni o unisciti al nostro server Discord per assistenza.

Appendice

Come prevenire la memorizzazione nella cache

Se vuoi superare la cache per ottenere sempre risultati aggiornati, puoi scegliere una delle seguenti opzioni:

- Per prevenire la memorizzazione nella cache in modo permanente: aggiungi `And discard:{{Date.now()}}` in tutte le tue schede AI (ad esempio, nei prompt AI Task, nel contesto KB, ecc.).

- Per evitare la memorizzazione temporanea in cache: pubblica il tuo bot e testalo da una finestra in incognito.

Nota: a parità di condizioni, rimuovendo questo livello di cache e senza apportare altre modifiche al bot, il costo AI Spend aumenterà.

Corsi consigliati

- ChatGPT Prompt Engineering per sviluppatori (anche se il titolo dice per sviluppatori, anche i non sviluppatori ne trarranno beneficio!)

- Costruire sistemi con l’API ChatGPT