- Botpress biedt transparante prijzen zonder verborgen AI-kosten, zodat je AI-uitgaven alleen je daadwerkelijke gebruik weerspiegelen.

- Het cachen van AI-antwoorden kan de kosten per query met ongeveer 30% verlagen zonder dat de gebruikerservaring hieronder lijdt.

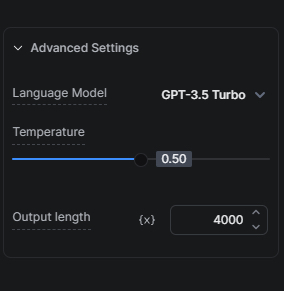

- Het kiezen van het juiste AI-model, zoals beginnen met GPT-3.5 Turbo in plaats van GPT-4, is essentieel om kosten en kwaliteit in balans te houden.

Veel bedrijven staan voor de uitdaging om het potentieel van AI-technologieën te benutten zonder te veel uit te geven. Wij begrijpen het belang van deze balans en zetten ons in om oplossingen te bieden waarmee onze gebruikers AI kostenefficiënt kunnen inzetten.

Onze aanpak van AI-kosten

Allereerst is het belangrijk om twee belangrijke onderdelen te begrijpen van hoe wij AI-gerelateerde kosten voor onze gebruikers verlagen, terwijl we toch de voordelen van AI bieden.

Transparante prijzen: geen verborgen kosten

Wij rekenen geen extra marge op AI-gerelateerde taken. Dit betekent dat je AI-kosten direct gekoppeld zijn aan je daadwerkelijke gebruik, zonder extra AI-kosten van onze kant.

Cachen van AI-antwoorden

Cachen is een van onze meest effectieve strategieën om de AI-kosten van bots te verlagen. Door AI-antwoorden te cachen, verminderen we het aantal verzoeken aan de LLM-provider, wat de kosten per query met ongeveer 30% kan verlagen. Zo bespaar je geld zonder dat de kwaliteit van de interacties tussen de bot en je gebruikers achteruitgaat.

Tips om AI-kosten te optimaliseren

Nu we twee van onze aanpakken om AI-kosten te verlagen hebben besproken, volgen hier tips die je kunt toepassen tijdens het bouwen van je bot om de AI-kosten verder te verlagen.

Optimaliseer je Knowledge Bases

Het optimaliseren van je Knowledge Bases (KB’s) kan een grote invloed hebben op je AI-kosten, omdat KB’s meestal de grootste kostenpost zijn in een Botpress-project.

Tip 1: Kies het juiste AI-model

De keuze van een AI-model heeft veel invloed op de kosten. Omdat GPT-3.5 Turbo sneller en goedkoper is dan GPT-4 Turbo, raden we aan om je setup grondig te testen met GPT-3.5 Turbo voordat je overstapt op geavanceerdere versies.

Onze KB Agent-hybride modus biedt een uitstekend compromis: we proberen eerst een antwoord te geven met GPT-3.5 Turbo en schakelen alleen over naar GPT-4 Turbo als dat nodig is.

Tip 2: Bescherm je KB

Je kunt je AI-kosten verlagen door je KB te beschermen tegen onnodige standaardvragen die geen AI of slimme beantwoording vereisen, met behulp van een Find Records-kaart. Zo werkt het: als je weet dat gebruikers vaak dezelfde vraag stellen en je hebt 50 veelgestelde vragen met hun antwoorden, kun je deze in een tabel zetten en die tabel raadplegen met een Find Records-kaart. Alleen als er geen antwoord wordt gevonden, wordt de KB geraadpleegd.

Tip 3: Scope je KB’s goed af

Afhankelijk van het type en de hoeveelheid informatie die je aan een KB wilt toevoegen, is het meestal het beste om twee dingen tegelijk te doen om AI-kosten te besparen. Organiseer je informatie in kleinere KB’s, elk gericht op een specifiek product/onderdeel/onderwerp. Leid de gebruiker vervolgens via een workflow met meerdere vragen naar de juiste KB; dit verlaagt niet alleen de kosten, maar levert ook betere resultaten op.

Tip 4: Website KB Data Source versus Search the Web KB Data Source

Als je een website gebruikt als KB-bron, maar niet voortdurend wijzigingen aanbrengt die direct zichtbaar moeten zijn in je bot, is het vaak voordeliger om Search The Web als KB-bron te gebruiken in plaats van de Website KB-bron. Test wel eerst of de prestaties op de verwachte vragen niet achteruitgaan door deze overstap.

Tip 5: Query tabellen met Find Records of Execute Code-kaart

Als je een tabel hebt met data die je wilt raadplegen, gebruik dan de Find Records-kaart in plaats van de tabel in een KB te zetten. Voor technisch onderlegde gebruikers kan het direct uitvoeren van code nog efficiënter zijn: raadpleeg de tabel rechtstreeks vanuit de Execute Code-kaart en sla het resultaat op in een workflowvariabele die je later kunt gebruiken.

Tip 6: Beheer de chunks

Met chunks bedoel ik het aantal stukken informatie dat uit de Knowledge Base wordt gehaald om een antwoord te genereren. Hoe meer chunks, hoe nauwkeuriger het antwoord meestal is – maar het duurt langer en kost meer AI-tokens. Experimenteer met de chunk-grootte om het laagste aantal te vinden dat nog steeds tot goede antwoorden leidt.

Gebruik de Execute Code-kaart om AI-kosten te verlagen

De Execute Code-kaart kan in sommige gevallen een geschikte, voordelige vervanging zijn voor bepaalde AI-kaarten. Hier zijn enkele scenario’s waarin je deze kunt overwegen:

Slimmere alternatieven voor berichten

Als je wilt dat je bot elke keer een ander AI-antwoord geeft op dezelfde vraag, moet je caching voorkomen (zie de bijlage voor instructies). Soms is een hogere AI-kost te rechtvaardigen door een betere gesprekservaring, maar dat is niet altijd zo.

Denk bijvoorbeeld aan een simpele begroeting die door een LLM wordt gegenereerd. Elke begroeting brengt extra AI-kosten met zich mee. Is dat de moeite waard? Waarschijnlijk niet. Gelukkig is er een voordelige oplossing: gebruik een array met meerdere antwoorden en een eenvoudige functie om willekeurig een antwoord te kiezen en te tonen.

Afhankelijk van het gespreksvolume kan de besparing door deze methode de moeite waard zijn.

Meer informatie over hoe je alternatieve berichten implementeert vind je hier.

Code uitvoeren voor eenvoudige taken

Voor eenvoudige taken, zoals het herformatteren van data of het extraheren van informatie uit gestructureerde data, is het gebruik van de Execute Code-kaart vaak efficiënter, goedkoper en sneller dan een LLM gebruiken.

Alternatieven voor de Summary Agent

Je kunt Execute Code-kaarten gebruiken om je eigen transcript te maken. Plaats een Execute Code-kaart op elke plek waar je het bericht van de gebruiker of de bot wilt opslaan in een array-variabele. Daarna kun je deze array als context aan je KB meegeven.

Vereenvoudig waar mogelijk

Kies de eenvoudigste interactiemethode die hetzelfde doel bereikt zonder de gebruikerservaring te verslechteren. Wil je bijvoorbeeld feedback verzamelen, dan is een simpel beoordelingssysteem met sterren en opmerkingen vaak goedkoper dan AI inzetten om dezelfde informatie te verzamelen.

Tips voor AI-taken, AI Generate Text en vertalingen

Kies het juiste AI-model

Ja, het kiezen van het juiste AI-model is zo belangrijk dat het twee keer genoemd wordt. Net als bij KB’s heeft de keuze van een AI-model veel invloed op de kosten van AI-taken. Gebruik GPT-3.5 Turbo voor minder complexe instructies. Test je setup grondig met dit model voordat je overstapt op een geavanceerdere versie. Onthoud: GPT-4 Turbo is 20 keer duurder dan GPT-3.5 Turbo. Tenzij de resultaten veel beter zijn, kies je dus voor GPT-3.5 Turbo.

Daarnaast kun je AI-kosten besparen door het aantal tokens per AI-taak te verminderen.

Mijn advies is om hier bewust mee om te gaan, want extra tokens worden dan afgekapt. Stel dat je de lengte beperkt tot 2000 tokens en je prompt plus output zijn samen meer dan 2000 tokens, dan wordt je input dienovereenkomstig ingekort.

AI Task versus AI Generate Text

Voor eenvoudige tekstuitvoer gebruikt de AI Generate Text-kaart minder tokens en is deze makkelijker in te stellen dan de AI Task-kaart. Voor taken waarbij informatie geanalyseerd moet worden, presteert de AI Task-kaart beter dan de AI Generate Text-kaart.

Mijn advies: gebruik de AI Task-kaart als je AI wilt inzetten om informatie te verwerken (bijvoorbeeld om de intentie van de gebruiker te detecteren of input te analyseren). Wil je AI gebruiken om tekst te genereren, gebruik dan de AI Generate Text-kaart (bijvoorbeeld om een KB-antwoord uit te breiden of creatief een vraag te genereren).

Voor meer informatie over de verschillen tussen de AI Task-kaart en de AI Generate Text-kaart, lees hier verder.

Vertalingen

Als je bot veel meertalige gesprekken moet verwerken, overweeg dan om hooks te integreren met externe vertaaldiensten voor een voordeligere oplossing.

Meer informatie over hooks vind je hier.

Afsluiting

Met deze strategieën en tips kun je je AI-kosten in Botpress optimaliseren. Door de kosten van verschillende taken te begrijpen en de meest efficiënte methoden te kiezen, verlaag je je AI-uitgaven zonder in te leveren op prestaties.

Ons team staat klaar om je te helpen bij het kiezen van de juiste opties, zodat jouw bot de best mogelijke ervaring biedt aan je gebruikers tegen de meest efficiënte kosten. Bezoek onze Prijspagina voor meer informatie of ga naar onze Discord-server voor hulp.

Bijlage

Hoe caching te voorkomen

Als je caching wilt omzeilen om altijd live resultaten te krijgen, kun je een van de volgende opties gebruiken:

- Voor permanente voorkoming van caching: voeg `And discard:{{Date.now()}}` toe aan al je AI-gerelateerde kaarten (bijvoorbeeld in AI Task-prompts, in de KB-context, enzovoort).

- Voor tijdelijke voorkoming van caching: publiceer je bot en test deze in een incognitovenster.

Aanbevolen cursussen

- ChatGPT Prompt Engineering voor Ontwikkelaars (ook al staat er in de titel 'voor ontwikkelaars', niet-ontwikkelaars zullen er ook baat bij hebben!)

- Systemen bouwen met de ChatGPT API