- Botpress menawarkan harga yang transparan tanpa biaya AI tersembunyi, sehingga biaya AI Anda hanya mencerminkan penggunaan nyata Anda.

- Caching respons AI dapat memangkas biaya query sekitar 30% tanpa mengurangi pengalaman pengguna.

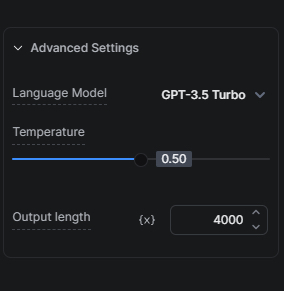

- Memilih model AI yang tepat, seperti memulai dengan GPT-3.5 Turbo daripada GPT-4, sangat penting untuk menyeimbangkan biaya dan kualitas.

Banyak bisnis menghadapi tantangan memanfaatkan teknologi AI tanpa mengeluarkan biaya berlebihan. Kami memahami pentingnya keseimbangan ini dan berkomitmen menyediakan solusi agar pengguna dapat memanfaatkan AI secara efisien dan hemat biaya.

Pendekatan Kami terhadap Biaya AI

Pertama, penting untuk memahami dua komponen utama bagaimana kami menurunkan biaya terkait AI bagi pengguna sambil tetap memberikan manfaat kemampuan AI.

Harga Transparan: Tanpa Biaya Tersembunyi

Kami tidak menambahkan margin apa pun pada tugas-tugas terkait AI. Artinya, biaya AI Spend Anda langsung berkaitan dengan penggunaan aktual tanpa biaya tambahan dari kami.

Menyimpan Respons AI (Caching)

Caching adalah salah satu strategi paling efektif kami untuk memangkas biaya AI bot. Dengan menyimpan respons AI, kami mengurangi jumlah permintaan ke penyedia LLM yang dapat menurunkan biaya query sekitar 30% sehingga Anda bisa berhemat tanpa mengorbankan kualitas interaksi bot dengan pengguna.

Tips Mengoptimalkan Biaya AI

Setelah melihat dua pendekatan yang kami gunakan untuk menurunkan AI Spend pengguna, berikut tips yang bisa Anda terapkan saat membangun bot untuk menekan biaya AI lebih lanjut.

Optimalkan Knowledge Base Anda

Mengoptimalkan Knowledge Base (KB) Anda dapat sangat memengaruhi AI Spend karena KB biasanya menjadi penyumbang biaya AI terbesar dalam proyek Botpress.

Tips 1: Pilih Model AI yang Tepat

Pilihan model AI sangat memengaruhi biaya. Karena GPT-3.5 Turbo lebih cepat & murah dibanding GPT-4 Turbo, kami sarankan untuk menguji pengaturan Anda secara menyeluruh dengan GPT-3.5 Turbo sebelum mempertimbangkan upgrade ke versi yang lebih canggih.

Mode hybrid KB Agent kami menawarkan solusi tengah yang baik, karena awalnya menggunakan GPT-3.5 Turbo untuk mencoba menjawab pertanyaan dan hanya naik ke GPT-4 Turbo jika diperlukan.

Tips 2: Lindungi KB Anda

Anda dapat mengurangi AI Spend dengan melindungi KB dari FAQ umum yang tidak memerlukan AI atau jawaban cerdas menggunakan kartu Find Records. Caranya: jika Anda tahu pengguna sering menanyakan satu pertanyaan dan ada 50 pertanyaan umum beserta jawabannya, Anda bisa menambahkannya ke tabel dan melakukan query ke tabel tersebut dengan kartu Find Records. Jika tidak ditemukan jawaban, barulah mencari di KB.

Tips 3: Tentukan Ruang Lingkup KB dengan Tepat

Tergantung pada jenis dan jumlah informasi yang ingin Anda tambahkan ke KB, biasanya praktik terbaik adalah melakukan dua hal secara paralel untuk menekan biaya AI Spend. Pertama, atur informasi ke dalam KB yang lebih kecil, masing-masing dengan ruang lingkup produk/fitur/topik tertentu. Kedua, arahkan pengguna melalui alur kerja dengan beberapa pertanyaan untuk mempersempit pencarian ke KB tertentu; ini tidak hanya menurunkan biaya, tapi juga memberikan hasil yang lebih baik.

Tips 4: Sumber Data KB Website vs Sumber Data KB Search the Web

Jika Anda menggunakan website sebagai sumber data KB namun tidak sering mengubah website yang perlu langsung tercermin di bot, alternatif hemat biaya adalah menggunakan Search The Web sebagai sumber data KB, bukan Website KB. Sebelum beralih, pastikan performa pada pertanyaan yang diperkirakan tidak menurun dengan perubahan ini.

Tips 5: Query Tabel dengan Find Records atau Kartu Execute Code

Jika Anda memiliki Tabel dengan data yang ingin di-query, pertimbangkan menggunakan kartu Find Records daripada menggunakan Tabel di KB. Untuk yang memiliki keahlian teknis, menjalankan kode bisa menjadi cara query Tabel yang lebih efisien dan hemat biaya. Caranya dengan query langsung dari kartu Execute Code dan menyimpan output ke variabel workflow yang bisa digunakan nanti.

Tip 6: Kontrol Chunk

Yang dimaksud chunk di sini adalah jumlah potongan data yang diambil dari Knowledge Base untuk menghasilkan jawaban. Umumnya, semakin banyak chunk yang diambil, jawabannya makin akurat – tapi prosesnya lebih lama dan biaya token AI lebih besar. Cobalah berbagai ukuran chunk untuk menemukan jumlah minimum yang tetap menghasilkan jawaban akurat.

Gunakan Kartu Execute Code untuk Menurunkan Biaya AI Spend

Kartu Execute Code bisa menjadi pengganti yang sesuai dan hemat biaya untuk beberapa kartu AI. Berikut beberapa skenario di mana Anda bisa mempertimbangkannya:

Alternatif Pesan yang Lebih Cerdas

Jika Anda ingin bot mengirim respons AI berbeda untuk pertanyaan yang sama setiap kali, Anda harus mencegah caching (lihat Lampiran untuk caranya). Ada skenario di mana peningkatan AI Spend sepadan dengan peningkatan pengalaman percakapan. Namun, tidak selalu demikian.

Contohnya salam sederhana yang dihasilkan LLM. Setiap salam akan menambah biaya AI Spend. Apakah layak? Mungkin tidak. Untungnya, ada solusi hemat biaya: gunakan array berisi beberapa respons dan fungsi sederhana untuk mengambil salah satu secara acak dan menampilkannya.

Tergantung volume percakapan, jumlah penghematan dari metode ini bisa sangat signifikan.

Anda bisa menemukan detail lebih lanjut tentang cara membuat pesan alternatif di sini.

Eksekusi Kode untuk Tugas Sederhana

Untuk tugas sederhana seperti memformat ulang data atau mengekstrak informasi dari data terstruktur, menggunakan kartu Execute Code bisa lebih efisien, murah, dan cepat dibanding mengandalkan LLM.

Alternatif untuk Summary Agent

Anda dapat menggunakan kartu Execute Code untuk membuat transkrip sendiri. Tempatkan kartu Execute Code di mana pun Anda ingin merekam pesan pengguna dan bot ke dalam variabel array. Setelah itu, array ini bisa digunakan sebagai konteks untuk KB Anda.

Sederhanakan Jika Memungkinkan

Pilih metode interaksi yang lebih sederhana selama tujuannya tercapai tanpa mengurangi pengalaman pengguna. Misalnya, untuk mengumpulkan feedback pengguna, sistem rating bintang sederhana dengan komentar akan lebih hemat biaya dibanding menggunakan AI untuk mengumpulkan informasi yang sama.

Tips untuk AI Tasks, AI Generate Text, dan Terjemahan

Pilih Model AI yang Tepat

Ya, memilih model AI yang tepat sangat penting hingga perlu disebutkan dua kali. Seperti pada KB, pilihan model AI sangat memengaruhi biaya pada AI Tasks. Pilih GPT-3.5 Turbo untuk instruksi yang tidak rumit. Sebelum upgrade ke versi lebih canggih, uji pengaturan Anda secara menyeluruh dengan model ini. Ingat, GPT-4 Turbo biayanya 20x lebih mahal dari GPT-3.5 Turbo. Kecuali hasilnya jauh lebih baik, pilih GPT-3.5 Turbo.

Selain itu, Anda juga bisa menghemat AI Spend dengan mengurangi jumlah token yang digunakan di setiap eksekusi AI Task.

Saran saya, perhatikan saat mengurangi jumlah token karena token tambahan akan terpotong. Misal, jika Anda membatasi panjang ke 2000 token dan prompt plus output Anda lebih dari 2000 token, maka input Anda akan dipotong sesuai batas tersebut.

AI Task vs AI Generate Text

Untuk output teks sederhana, kartu AI Generate Text menggunakan lebih sedikit token dan lebih mudah diatur dibanding kartu AI Task. Untuk tugas yang membutuhkan parsing informasi, kartu AI Task lebih unggul dibanding AI Generate Text.

Jadi, rekomendasi saya gunakan kartu AI Task jika ingin AI memproses informasi (misal, mendeteksi maksud pengguna atau menganalisis input). Namun, jika ingin AI menghasilkan teks, gunakan kartu AI Generate Text (misal, memperluas jawaban KB atau membuat pertanyaan secara kreatif).

Untuk penjelasan lebih lanjut tentang perbedaan kartu AI Task dan AI Generate Text, pelajari di sini.

Terjemahan

Jika bot Anda akan menangani banyak percakapan multibahasa, pertimbangkan mengintegrasikan hooks dengan layanan terjemahan eksternal sebagai opsi yang lebih hemat biaya.

Anda dapat menemukan informasi lebih lanjut tentang hooks di sini.

Penutup

Dengan strategi dan tips ini, Anda dapat mengoptimalkan AI Spend di Botpress. Memahami implikasi biaya dari berbagai tugas dan memilih metode paling efisien sesuai kebutuhan akan menurunkan pengeluaran terkait AI tanpa mengorbankan performa.

Tim kami siap membantu Anda menavigasi pilihan-pilihan ini dan memastikan bot Anda memberikan pengalaman terbaik bagi pengguna dengan biaya yang paling efisien. Kunjungi Pricing page kami untuk informasi lebih lanjut atau kunjungi server Discord kami untuk bantuan.

Lampiran

Cara Mencegah Cache

Jika Anda ingin mengatasi cache agar selalu mendapatkan hasil terbaru, Anda dapat melakukan salah satu dari opsi berikut:

- Untuk mencegah cache secara permanen: tambahkan `And discard:{{Date.now()}}` di semua kartu yang berhubungan dengan AI (misalnya, pada prompt Tugas AI, di konteks KB, dan sebagainya).

- Untuk mencegah cache sementara: publikasikan bot Anda dan uji dari jendela penyamaran.

Kursus yang Direkomendasikan

- Rekayasa Prompt ChatGPT untuk Pengembang (meskipun judulnya ditujukan untuk pengembang, non-pengembang juga akan mendapatkan manfaat!)

- Membangun Sistem dengan ChatGPT API