- Botpressは、隠れたAI手数料のない透明な料金体系を提供しており、AIコストは実際の利用分のみが反映されます。

- AIの応答をキャッシュすることで、ユーザー体験を損なうことなくクエリコストを約30%削減できます。

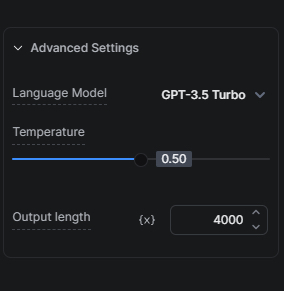

- GPT-4ではなくGPT-3.5 Turboから始めるなど、適切なAIモデルを選ぶことがコストと品質のバランスに重要です。

多くの企業は、AI技術の可能性を活用しつつ、コストのかかりすぎを避ける課題に直面しています。私たちはこのバランスの重要性を理解し、ユーザーがコスト効率よくAIを活用できるようなソリューションを提供することに努めています。

AIコストへの取り組み

まず、AIの利点を維持しながら、どのようにしてユーザーのAI関連コストを削減しているか、その2つの重要な要素を理解することが大切です。

透明な料金体系:隠れた手数料なし

AI関連のタスクに追加のマージンは一切加えていません。つまり、AIコストは実際の利用分にのみ直接関連し、当社から追加のAI手数料は発生しません。

AI応答のキャッシュ

キャッシュは、ボットのAIコストを削減するための最も効果的な戦略のひとつです。AIの応答をキャッシュすることで、LLMプロバイダーへのリクエスト数を減らし、クエリコストを約30%削減できます。これにより、ユーザーとのやり取りの品質を損なうことなくコストを抑えられます。

AIコストを最適化するためのヒント

ここまででAIコスト削減のための2つのアプローチを紹介しましたが、ここからはボット構築時にさらにコストを下げるためのヒントを紹介します。

ナレッジベースの最適化

ナレッジベース(KB)の最適化は、AIコストに大きく影響します。KBはBotpressプロジェクトにおける最大のAIコスト要因となることが多いからです。

ヒント1:適切なAIモデルを選ぶ

AIモデルの選択はコストに大きく影響します。GPT-3.5 TurboはGPT-4 Turboよりも高速かつ低コストなため、まずはGPT-3.5 Turboで十分にテストし、必要に応じて上位モデルへのアップグレードを検討することをおすすめします。

KBエージェントのハイブリッドモードは、まずGPT-3.5 Turboで応答を試み、必要な場合のみGPT-4 Turboに切り替えるため、コストと品質のバランスが取れた方法です。

ヒント2:KBを保護する

Find Recordsカードを使って、AIや高度な応答が不要なよくあるFAQからKBを保護することで、AIコストを削減できます。たとえば、よくある50の質問とその回答をテーブルにまとめ、Find Recordsカードでそのテーブルを検索します。見つからなかった場合のみKBを参照するようにできます。

ヒント3:KBの範囲を適切に設定する

KBに追加したい情報の種類や量によっては、AIコスト削減のために2つのことを並行して行うのが一般的です。まず、情報を小さなKBに分け、それぞれを特定の製品・機能・トピックに絞ります。次に、複数の質問を通じてユーザーを誘導し、検索範囲を特定のKBに絞り込みます。これによりコスト削減だけでなく、より良い結果も得られます。

ヒント4:Website KBデータソースとSearch the Web KBデータソースの使い分け

ウェブサイトをKBデータソースとして使っていて、リアルタイムで反映させる必要がない場合は、Website KBデータソースの代わりにSearch The Web KBデータソースを使うのがコスト効率の良い選択肢です。切り替える前に、想定される質問でパフォーマンスが低下しないか必ずテストしてください。

ヒント5:Find RecordsまたはExecute Codeカードでテーブルを検索する

テーブルのデータを検索したい場合は、KB内のテーブルを使うよりもFind Recordsカードの利用を検討してください。技術的な知識がある場合は、Execute Codeカードから直接テーブルを検索し、その出力をワークフロー変数に保存することで、さらにコスト効率よく処理できます。

ヒント6:チャンク数を調整する

ここでいうチャンクとは、回答を生成するためにナレッジベースから取得するチャンクの数です。一般的に、取得するチャンクが多いほど回答の精度は上がりますが、生成に時間がかかりAIトークンの消費も増えます。最小限のチャンク数で正確な回答が得られるように調整しましょう。

Execute CodeカードでAIコストを抑える

Execute Codeカードは、一部のAIカードの代替としてコスト効率よく利用できます。以下のような場面で活用を検討してください。

より賢いメッセージの代替案

同じ質問に対して毎回異なるAI応答を返したい場合は、キャッシュを無効にする必要があります(方法は付録参照)。会話体験の向上によってAIコスト増加が正当化される場合もありますが、常にそうとは限りません。

例えば、LLMで生成される単純な挨拶の場合、毎回追加のAIコストが発生します。それだけの価値があるかというと、おそらく違うでしょう。コスト効率の良い方法として、複数の応答を配列に用意し、ランダムに選んで表示する関数を使う方法があります。

会話量によっては、この方法を導入することで大きなコスト削減につながります。

代替メッセージの実装方法はこちらで詳しく解説しています。

単純な処理のためのコード実行

データの再フォーマットや構造化データからの情報抽出など、単純な処理にはLLMに頼るよりもExecute Codeカードを使う方が効率的で安価、かつ高速です。

Summary Agentの代替案

Execute Codeカードを使って独自の会話記録を作成できます。ユーザーやボットのメッセージを配列変数に記録したい場所にExecute Codeカードを配置し、その配列をKBのコンテキストとして利用できます。

可能な限りシンプルにする

同じ目的を達成できるなら、ユーザー体験を損なわない範囲でよりシンプルな方法を選びましょう。例えば、ユーザーのフィードバック収集には、AIを使うよりも星評価とコメントのシンプルな仕組みの方がコスト効率が良いです。

AIタスク、AIテキスト生成、翻訳のヒント

適切なAIモデルを選ぶ

AIモデルの選択は非常に重要なので、繰り返し強調します。KBと同様に、AIタスクでもモデル選択がコストに大きく影響します。複雑でない指示にはGPT-3.5 Turboを選びましょう。より高度なバージョンへのアップグレードを検討する前に、このモデルで十分にテストしてください。GPT-4 TurboはGPT-3.5 Turboの20倍のコストがかかります。結果が大幅に良くない限り、GPT-3.5 Turboを選ぶのが賢明です。

さらに、各AIタスク実行時に消費されるトークン数を減らすことでAIコストを抑えることもできます。

ただし、この数値を減らしすぎると追加のトークンが切り捨てられるので注意が必要です。例えば、トークン数を2000に制限し、プロンプトと出力の合計が2000を超える場合、入力が切り捨てられます。

AIタスクとAIテキスト生成の使い分け

単純なテキスト出力には、AI Generate Textカードの方がAIタスクカードよりもトークン消費が少なく、設定も簡単です。情報の解析が必要な場合は、AIタスクカードの方が優れています。

したがって、AIで情報を処理したい場合(例:ユーザーの意図を検出したい、入力を分析したい場合)はAIタスクカードを、テキスト生成を目的とする場合(例:KBの回答を拡張したい、創造的な質問を生成したい場合)はAI Generate Textカードを使うことをおすすめします。

AIタスクカードとAI Generate Textカードの違いについて詳しくは、こちらをご覧ください。

翻訳

ボットが多言語で大量の会話を処理する場合は、外部の翻訳サービスと連携するフックを導入することで、よりコスト効率の良い運用が可能です。

フックについての詳細はこちらでご確認いただけます。

まとめ

これらの戦略やヒントを活用することで、BotpressでのAIコストを最適化できます。各タスクのコスト影響を理解し、最適な方法を選択することで、パフォーマンスを損なうことなくAI関連の費用を削減できます。

私たちのチームは、これらの選択肢についてご案内し、最も効率的なコストでユーザーに最高の体験を提供できるようサポートします。詳細は料金ページをご覧いただくか、サポートが必要な場合はDiscordサーバーにご参加ください。

付録

キャッシュを防ぐ方法

常に最新の結果を取得するためにキャッシュを回避したい場合、次のいずれかの方法をお試しください。

- より恒久的にキャッシュを防ぐには、すべてのAI関連カード(例:AIタスクのプロンプトやKBコンテキストなど)に `And discard:{{Date.now()}}` を追加してください。

- 一時的にキャッシュを防ぎたい場合は、ボットを公開し、シークレットウィンドウからテストしてください。

おすすめコース

- ChatGPTプロンプトエンジニアリング(開発者向け)(タイトルは開発者向けですが、非開発者にも役立ちます!)

- ChatGPT APIでシステムを構築する